【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

MULTILEGALPILE

收藏arXiv2024-05-19 更新2024-06-21 收录

下载链接:

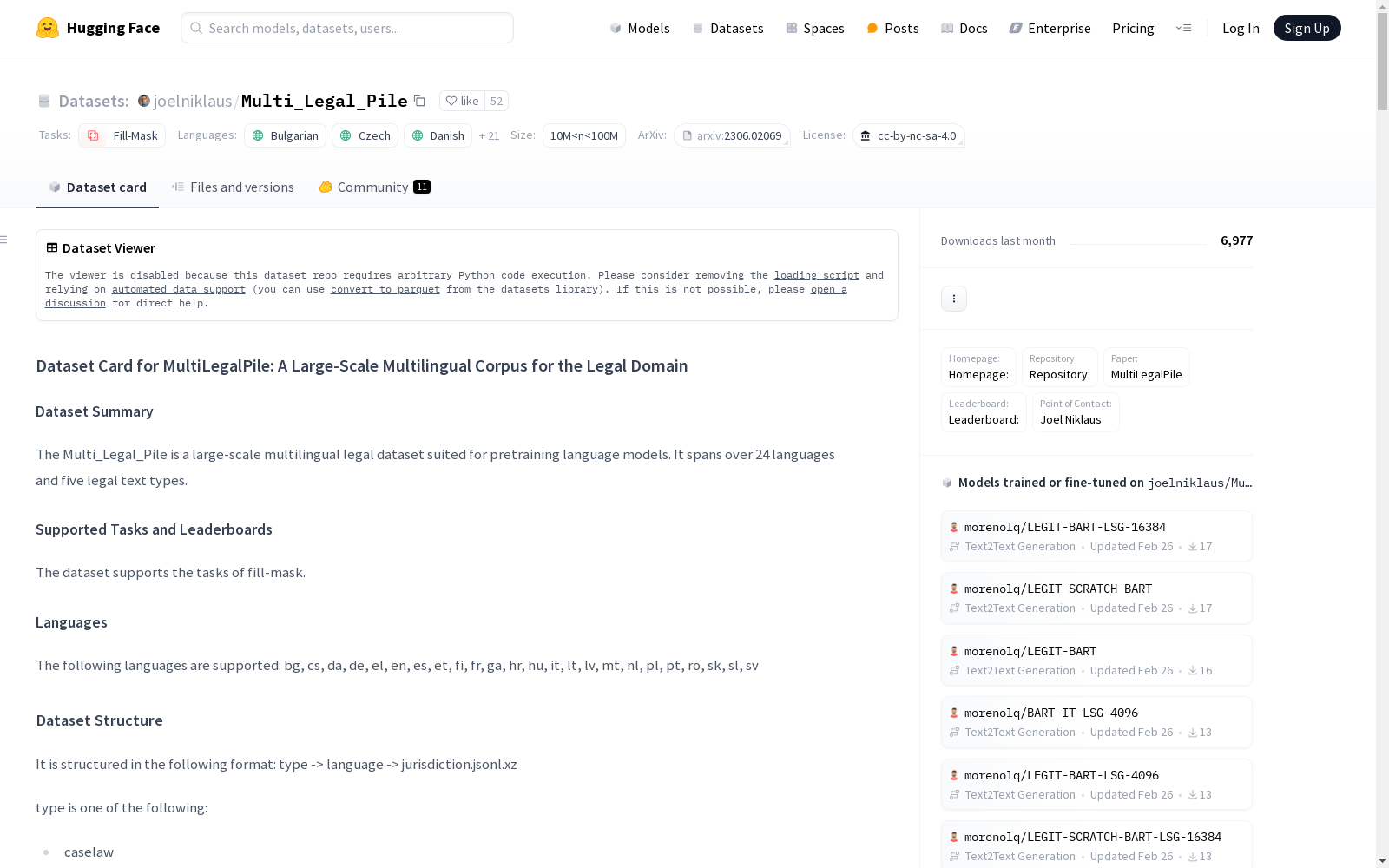

https://huggingface.co/datasets/joelniklaus/Multi_Legal_Pile

下载链接

链接失效反馈官方服务:

资源简介:

MULTILEGALPILE是一个包含24种语言和17个司法管辖区的689GB大规模多语言法律语料库。该数据集由伯尔尼大学等机构创建,涵盖了多种法律数据源,支持在公平使用原则下预训练NLP模型。数据集主要采用宽松许可,适用于法律领域的文本分析和理解。MULTILEGALPILE的应用领域包括法律文本的预训练模型开发,旨在提高法律语言处理的准确性和效率,特别是在多语言和跨司法管辖区的法律文本分析中。

MULTILEGALPILE is a 689 GB large-scale multilingual legal corpus encompassing 24 languages and 17 jurisdictions. Developed by institutions including the University of Bern, this dataset covers diverse legal data sources and supports pre-training of NLP models under the fair use principle. It primarily adopts permissive licenses and is applicable to text analysis and understanding tasks in the legal domain. The application scenarios of MULTILEGALPILE include the development of pre-trained models for legal texts, aiming to improve the accuracy and efficiency of legal language processing, especially in multilingual and cross-jurisdictional legal text analysis.

提供机构:

伯尔尼大学

创建时间:

2023-06-03

搜集汇总

数据集介绍

构建方式

MULTILEGALPILE数据集的构建,旨在解决当前大型语言模型在法律等关键专业领域训练数据不足的问题。研究者们从17个司法管辖区搜集了涵盖24种语言的689GB法律文本,其中包括法律条文、案例法和其他法律数据来源。为了确保数据集的质量和专业性,研究人员使用了正则表达式和人工审核的方法从大型多语言网络爬取语料库mC4中筛选出法律相关内容,并通过多次迭代改进筛选算法。此外,还从多个来源直接抓取了法律文本数据,包括Eurlex资源、Pile of Law等。所有数据被转换成xz压缩的JSON Lines (JSONL)格式,以便高效地处理和读取大型数据集。

特点

MULTILEGALPILE数据集的主要特点包括其多语言性和多样性。数据集包含了来自不同法律体系和语言的丰富法律文本,为训练能够理解和处理多种法律语言的语言模型提供了宝贵的资源。此外,数据集的大部分内容都拥有宽松的许可,允许在公平使用的原则下进行NLP模型的预训练。在模型预训练方面,研究者们基于XLM-R模型进行了多语言和多语言模型预训练,并在LEXTREME和LexGLUE等法律基准测试中取得了最先进的性能。数据集还包含了24种语言的单一语言模型,其中一些模型在某些语言上达到了最先进的性能。

使用方法

MULTILEGALPILE数据集的使用方法主要涉及NLP模型的预训练。研究者们使用XLM-R模型作为基础模型,并在MULTILEGALPILE数据集上进行预训练。预训练过程中,研究者们采用了多种最佳实践,包括从原始XLM-R检查点中启动模型、使用新的分词器、在训练数据集上进行多次迭代等。此外,还使用了Longformer模型进行长文本的预训练,以提高模型在处理法律文本时的性能。预训练完成后,模型在LEXTREME和LexGLUE等法律基准测试中进行了评估,结果显示,MULTILEGALPILE数据集预训练的模型在多个任务和语言上取得了最先进的性能。

背景与挑战

背景概述

在自然语言处理(NLP)领域,大型、高质量的数据集对于训练大型语言模型(LLMs)至关重要。然而,在诸如法律等特定关键领域,大型数据集的可用性相对较低,且现有数据集往往规模较小且仅限于英语。为了填补这一空白,Joel Niklaus、Veton Matoshi、Matthias Stürmer、Ilias Chalkidis和Daniel E. Ho等研究人员共同创建并发布了MULTILEGALPILE数据集。该数据集包含来自17个司法管辖区、覆盖24种语言的689GB多语言法律语料库。MULTILEGALPILE数据集的发布为法律文本分析、理解和LLMs的训练提供了宝贵的资源,对相关领域产生了深远的影响。

当前挑战

MULTILEGALPILE数据集面临的主要挑战包括:

1) 法律领域的特殊性:法律文本通常包含大量的专业术语和复杂的句子结构,这给NLP模型的训练和理解带来了挑战。

2) 多语言处理:由于涉及多种语言,需要考虑不同语言之间的差异和相互影响,以及如何有效地利用多语言数据进行训练。

3) 数据质量:尽管MULTILEGALPILE数据集规模庞大,但仍需确保数据的质量和准确性,以避免引入噪声或错误。

4) 版权问题:在处理公共机构(如法院和行政部门)产生的法律文本时,可能涉及版权问题,需要谨慎处理。

常用场景

经典使用场景

在法律领域,MULTILEGALPILE数据集被广泛应用于预训练大型语言模型(LLMs),以提升模型在处理法律文本时的性能。该数据集的多语言特性使得模型能够更好地理解和生成不同法律体系的文本。此外,MULTILEGALPILE也被用于法律文本的分类、实体识别和预测判决等任务,为法律专业人士提供智能化辅助。

解决学术问题

MULTILEGALPILE数据集解决了法律领域缺乏大规模预训练语料库的问题。现有的法律数据集往往规模较小,且仅限于英语。MULTILEGALPILE包含了来自17个司法管辖区、24种语言的689GB法律文本,填补了这一空白。此外,该数据集的开放许可使得研究人员可以自由地使用和分享数据,推动了法律文本分析领域的研究和发展。

衍生相关工作

基于MULTILEGALPILE数据集,研究人员开发了多个预训练语言模型,如Legal-XLM-R和Legal-mono-R。这些模型在多个法律基准测试中取得了最先进的性能,为法律文本分析领域的研究提供了重要的工具和资源。此外,MULTILEGALPILE的开放许可也促进了其他相关数据集和模型的开发,如LexFiles和LegalLlama。

以上内容由遇见数据集搜集并总结生成