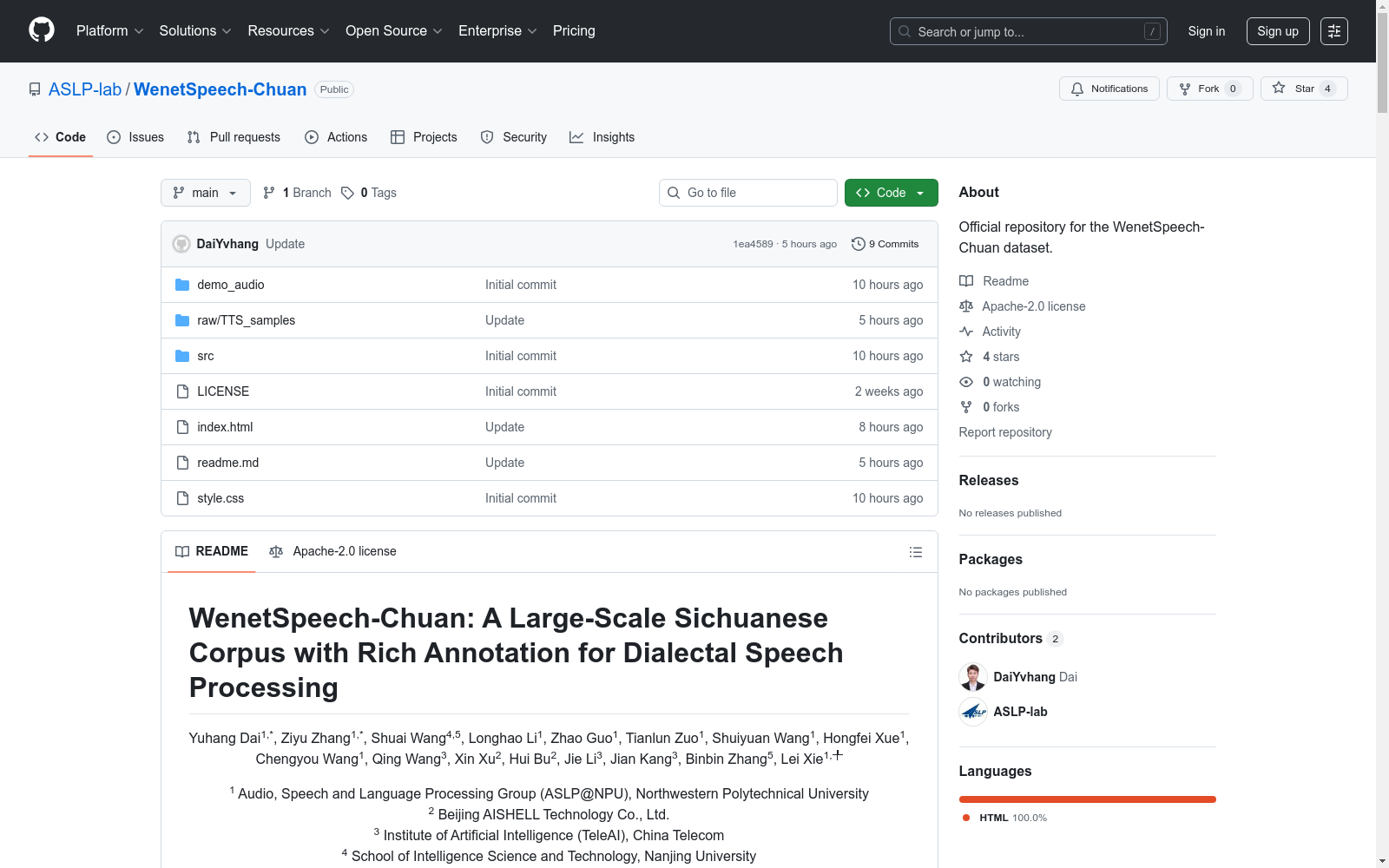

WenetSpeech-Chuan

收藏github2025-09-21 更新2025-09-22 收录

下载链接:

https://github.com/ASLP-lab/WenetSpeech-Chuan

下载链接

链接失效反馈官方服务:

资源简介:

WenetSpeech-Chuan是一个大规模四川话语料库,具有丰富标注,用于方言语音处理

WenetSpeech-Chuan is a large-scale Sichuan dialect speech corpus with rich annotations, designed for dialect speech processing.

创建时间:

2025-09-21

原始信息汇总

WenetSpeech-Chuan 数据集概述

数据集基本信息

- 名称:WenetSpeech-Chuan

- 描述:大规模四川方言语料库,包含丰富标注,用于方言语音处理

- 规模:10,000小时

- 语言:四川方言(川渝方言)

- 状态:开源

数据内容

- 标注信息:音频路径、时长、文本置信度、说话人身份、信噪比、DNSMOS、年龄、性别、字符级时间戳

- 覆盖领域:短视频、娱乐、直播、纪录片、有声书、戏剧、访谈、新闻等十个领域

- 数据格式:元数据存储在单一JSON文件中

基准测试

自动语音识别(ASR)基准

- 名称:WSC-Eval-ASR

- 标注内容:文本转录、情绪、年龄、性别标签

- 子集划分:

- Easy子集:有声书、朗读领域,8.55小时

- Hard子集:短视频、娱乐、戏剧领域,1.15小时

文本转语音(TTS)基准

- 名称:WSChuan-TTS-eval

- 子集划分:

- WSC-Eval-TTS-easy:包含方言词汇的句子,覆盖多个领域

- WSC-Eval-TTS-hard:包含长句和多样化风格的句子(如绕口令、民间说法、情感语音)

数据处理流程

- 音频采集:从多领域收集大规模野外语音录音

- 说话人属性标注:使用pyannote进行说话人日记化,Vox-Profile进行年龄和性别估计

- 语音质量标注:使用Brouhaha评估信噪比,DNSMOS评估感知质量,带宽检测频谱覆盖

- 自动语音识别:使用SenseVoice、TeleASR和FireRed-ASR三个系统进行多系统标注

- 错误校正:采用LLM生成式错误校正基于ROVER(LLM-GER)框架提升转录准确性

数据获取

- 训练数据集:https://huggingface.co/datasets/ASLP-lab/WSChuan-Train

- 评估基准:

- ASR评估:https://huggingface.co/datasets/ASLP-lab/WSChuan-Eval

- TTS评估:https://huggingface.co/datasets/ASLP-lab/WSChuan-Eval

- 预训练模型:

- ASR模型:https://huggingface.co/ASLP-lab/WSChuan-ASR

- TTS模型:https://huggingface.co/ASLP-lab/WSChuan-TTS

贡献机构

- 西北工业大学音频、语音与语言处理组(ASLP@NPU)

- 北京希尔贝壳科技有限公司

- 中国电信人工智能研究院(TeleAI)

- 南京大学智能科学与技术学院

- WeNet开源社区

联系方式

- 邮箱:yhdai@mail.nwpu.edu.cn 或 ziyu_zhang@mail.nwpu.edu.cn

- 微信讨论群:可通过扫描二维码加入

搜集汇总

数据集介绍

构建方式

在方言语音处理领域,大规模高质量数据集的构建是推动技术发展的关键。WenetSpeech-Chuan通过系统化的数据采集流程,从短视频、娱乐直播、纪录片等十个领域收集原始音频,并经过语音活动检测分割为 utterance 级别片段。采用多系统自动语音识别技术生成初始转录,再结合大语言模型驱动的生成式错误校正框架(LLM-GER)进行转录优化与融合,显著提升了标注准确性。每个音频片段还通过自动化工具链标注了说话人属性、信噪比、语音质量分数及字符级时间戳,形成了兼具规模与精细度的多模态标注体系。

特点

作为目前最大的开源川渝方言语音语料库,WenetSpeech-Chuan的核心特点体现在其万小时级的规模与多维度的丰富标注。该数据集不仅涵盖十个差异显著的语音领域,还提供了说话人年龄、性别、情感标签以及音频质量指标(DNSMOS、SNR)等结构化元数据。特别设计的分级评测集(WSC-Eval-ASR/TTS)包含易难度划分的语音样本与多样化文本风格,有效支撑了方言语音识别与合成任务的系统性评估。其字符级时间戳和高质量转录文本进一步为语音对齐、口音分析等细分研究提供了可能。

使用方法

研究者可通过Hugging Face平台获取数据集的元数据文件及对应的音频资源,利用提供的统一JSON格式元数据快速定位所需语音样本及其多维度属性。对于自动语音识别任务,可基于WSC-Eval-ASR评测集验证模型在方言环境下的性能;文本到语音任务则可使用WSChuan-TTS-eval中的平衡说话人样本进行合成质量评估。数据集配套发布了基于该语料训练的预训练模型(ASR/TTS),用户既可将其作为基础模型进行微调,也可直接用于方言语音处理应用的部署与测试。

背景与挑战

背景概述

WenetSpeech-Chuan数据集由西北工业大学音频、语音与语言处理组联合多家机构于2024年共同构建,旨在填补四川方言语音处理领域大规模标注数据的空白。该数据集包含一万小时的高质量四川方言语音,覆盖短视频、娱乐、直播等十类领域,并配备多维度标注信息,包括说话人属性、信号质量指标及字符级时间戳,为方言语音识别与合成研究提供了重要基础资源。

当前挑战

该数据集核心挑战在于解决方言语音识别中音系变异与词汇差异导致的模型泛化难题,同时需应对非标准语法结构对语义理解的干扰。构建过程中面临方言数据稀缺性、多系统自动标注的一致性优化,以及基于大语言模型的错误修正机制设计等关键技术瓶颈,需通过多模态质量评估与生成式纠错策略提升标注可靠性。

常用场景

经典使用场景

在方言语音处理领域,WenetSpeech-Chuan数据集为四川话自动语音识别(ASR)和文本转语音(TTS)任务提供了大规模标注资源。该数据集涵盖短视频、娱乐、直播、纪录片等十个领域,共计一万小时的语音数据,支持多说话人建模和风格可控的语音合成研究。其经典使用场景包括方言语音识别系统的训练与评估,以及方言语音合成模型的开发与优化,为方言语音技术的标准化测试提供了重要基础。

衍生相关工作

围绕WenetSpeech-Chuan数据集,衍生了一系列经典研究工作,包括基于LLM-GER框架的多系统语音转录融合技术、方言语音质量评估的自动化流水线(Chuan-Pipe),以及针对四川话的端到端语音识别与合成模型(如Paraformer和Qwen2.5-omni的方言优化版本)。这些工作不仅提升了方言语音处理的性能,还推动了多模态语音数据处理、低资源语音技术迁移等方向的发展,为后续方言语音数据集的构建与算法设计提供了重要参考。

数据集最近研究

最新研究方向

在方言语音处理领域,WenetSpeech-Chuan数据集的推出显著推动了四川方言语音技术的前沿探索。当前研究聚焦于融合大语言模型的智能纠错机制,通过LLM-GER框架整合多系统语音识别结果,有效提升了方言语音转写的准确性与鲁棒性。该数据集支撑的语音合成与识别评测基准,正促进多模态方言计算模型的创新发展,对方言文化遗产的数字化保护与智能语音技术普惠具有深远意义。

以上内容由遇见数据集搜集并总结生成