垂直领域的数据集及评测基准

收藏github2023-12-26 更新2024-05-31 收录

下载链接:

https://github.com/luban-agi/Awesome-Domain-LLM

下载链接

链接失效反馈资源简介:

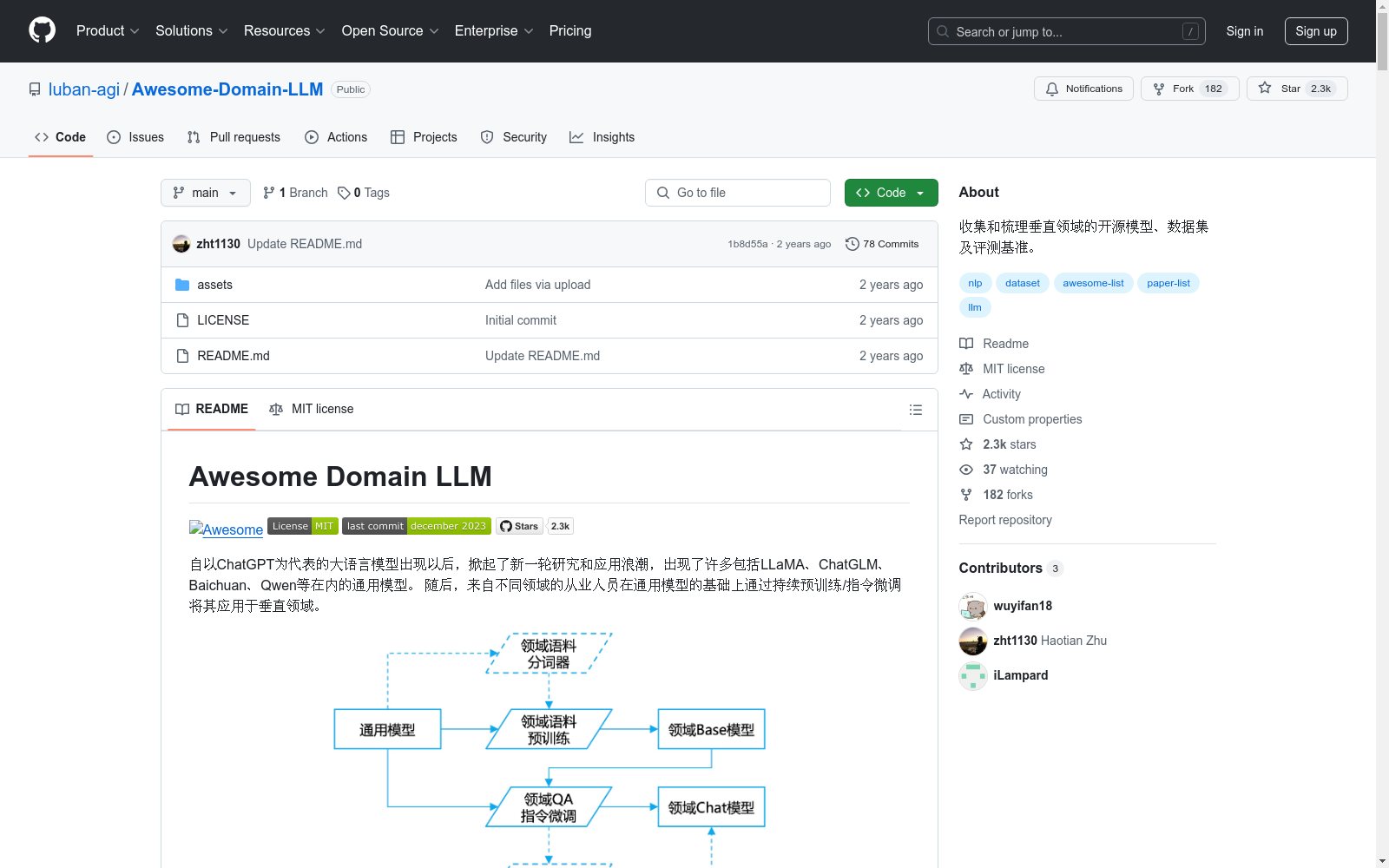

收集和梳理垂直领域的开源模型、数据集及评测基准。

Collection and organization of open-source models, datasets, and evaluation benchmarks in vertical domains.

创建时间:

2023-09-05

原始信息汇总

数据集概述

本项目旨在收集和梳理垂直领域的开源模型、数据集及评测基准。以下是数据集相关信息:

📚 数据集

-

医疗领域:

- ChiMed-GPT:基于Ziya-v2的中文医疗大模型。

- AlpaCare:医学大模型,基于LLaMA微调。

- Taiyi (太一):中英双语生物医学大模型。

- MentalLLaMA:心理大模型,用于社交媒体上可解释的心理健康分析。

- WiNGPT2:基于GPT的医疗垂直领域大模型。

- ChatPsychiatrist:心理大模型,基于LLaMA-7B微调。

- Zhongjing-LLaMA (仲景):包含预训练、有监督微调和RLHF完整训练流程的中文医学大模型。

- DoctorGLM:基于ChatGLM-6B的中文问诊模型。

- BenTsao (本草):经过中文医学指令微调的大语言模型集。

- Med-ChatGLM:经过中文医学指令微调的ChatGLM-6B模型。

- BianQue (扁鹊):生活空间健康大模型。

- HuatuoGPT (华佗):医疗大模型,包括HuatuoGPT-7B和HuatuoGPT-13B。

- QiZhenGPT:利用启真医学知识库构建的中文医学指令数据集。

- ChatMed:中文医疗大模型ChatMed-Consult。

- ShenNong-TCM-LLM (神农):中文中医药大模型。

- XrayGLM:中文多模态医学数据集及模型。

- MedicalGPT:医疗大模型,实现了增量预训练、有监督微调、RLHF和DPO。

- Sunsimiao (孙思邈):中文医疗大模型。

- CareGPT:医疗大模型,集合了数十个公开可用的医疗微调数据集和开放可用的医疗大语言模型。

- DISC-MedLLM:针对医疗健康对话式场景而设计的医疗领域大模型与数据集。

- PMC-LLaMA:医疗大模型,包括预训练版本的MedLLaMA_13B和指令微调版本的PMC_LLaMA_13B。

- ChatDoctor:医疗大模型,在LLaMA的基础上训练得到。

- MING (明医):医疗大模型,基于bloomz-7b指令微调得到MING-7B。

- IvyGPT:医疗大模型,在高质量的医学问答数据上进行了监督微调,并使用人类反馈的强化学习进行了训练。

- PULSE:中文医疗大模型,使用约4,000,000个中文医学领域和通用领域的指令微调数据进行微调。

- HuangDI (皇帝):中医大模型,首先在Ziya-LLaMA-13B-V1基座模型的基础上加入中医教材、中医各类网站数据等语料库。

- ZhongJing (仲景):中医大模型,旨在阐明中医博大精深之知识。

- TCMLLM:中医临床辅助诊疗大模型,目前针对中医临床智能诊疗问题中的处方推荐任务,发布了中医处方推荐大模型TCMLLM-PR。

- MeChat:中文心理健康支持对话大模型与数据集。

- SoulChat (灵心):心理健康大模型,以ChatGLM-6B作为初始化模型,经过百万规模心理咨询领域中文长文本指令与多轮共情对话数据联合指令微调得到。

- MindChat (漫谈):心理大模型,采用了经过人工清洗的约20万条的高质量多轮心理对话数据进行训练。

- QiaoBan (巧板):儿童情感对话大模型,基于开源通用大模型,使用通用域人机对话、单轮指令数据以及儿童情感陪伴对话数据进行指令微调。

-

法律领域:

- DISC-LawLLM:旨在为用户提供专业、智能、全面的法律服务的法律领域大模型。

- LawGPT_zh (獬豸):中文法律通用模型,由ChatGLM-6B LoRA 16-bit指令微调得到。

- LaWGPT:系列模型在通用中文基座模型(如Chinese-LLaMA、ChatGLM等)的基础上扩充法律领域专有词表、大规模中文法律语料预训练。

- LexiLaw:经过微调的中文法律大模型,基于ChatGLM-6B架构。

- Lawyer LLaMA:法律领域的指令微调数据和基于LLaMA训练的中文法律大模型。

- HanFei (韩非):全参数训练的法律大模型,参数量7b。

- ChatLaw:一系列法律大模型,包括基于姜子牙-13B、Anima-33B训练而来的ChatLaw-13B和ChatLaw-33B。

- Lychee (律知):中文司法领域大模型Law-GLM-10B。

- wisdomInterrogatory (智海-录问):法律大模型,基于Baichuan-7B进行了法律领域数据的二次预训练与指令微调。

- JurisLMs:基于中文法学语料训练了一系列语言模型。

- 夫子•明察:司法大模型,以 ChatGLM 为大模型底座,基于海量中文无监督司法语料与有监督司法微调数据训练。

-

金融领域:

- Tongyi-Finance-14B:针对金融行业推出的大语言模型。

- DISC-FinLLM:金融领域的大语言模型,由面向不同金融场景的4个模组构成的多专家智慧金融系统。

- InvestLM:基于LLaMA-65B微调得到的英文金融大模型。

- FinGLM:致力于构建一个开放的、公益的、持久的金融大模型项目。

- WeaverBird (织工鸟):金融领域对话大模型,可接入本地知识库以及网络搜索引擎。

- BBT-FinCUGE-Applications:中文金融领域语料库BBT-FinCorpus,知识增强型大模型BBT-FinT5及评测基准CFLEB。

- Cornucopia (聚宝盆):基于公开和爬取的中文金融领域问答数据构建指令数据集。

- XuanYuan (轩辕):国内首个开源的千亿级中文对话大模型,同时也是首个针对中文金融领域优化的千亿级开源对话大模型。

- PIXIU (貔貅):金融领域指令微调数据集FIT,大模型FinMA及评测基准FLARE。

- FinGPT:多个金融大模型,包括ChatGLM2-6B+LoRA和LLaMA2-7B+LoRA等。

- FLANG:金融大模型FLANG和评测基准FLUE。

-

教育领域:

- 桃李 (Taoli):适用于国际中文教育领域的大模型,基于目前国际中文教育领域流通的500余册国际中文教育教材与教辅书、汉语水平考试试题以及汉语学习者词典等。

- EduChat:教育领域的大模型,基于目前国际中文教育领域流通的500余册国际中文教育教材与教辅书、汉语水平考试试题以及汉语学习者词典等。

以上数据集和模型涵盖了医疗、法律、金融和教育等多个垂直领域,旨在推动大模型在各行各业的应用。

AI搜集汇总

数据集介绍

构建方式

该数据集的构建基于垂直领域的开源模型、数据集及评测基准的收集与梳理。通过整合来自不同领域的从业人员在通用大语言模型(如LLaMA、ChatGLM等)基础上进行持续预训练或指令微调的成果,涵盖了医疗、法律、金融、教育等多个垂直领域。数据集的构建过程注重开源性和多样性,鼓励社区贡献未收录的开源模型、数据集及评测基准,以推动大模型在各行业的应用与发展。

特点

该数据集的特点在于其广泛的领域覆盖和高质量的开源资源。它不仅包含了多个垂直领域的模型和数据集,还提供了相应的评测基准,确保了模型在不同领域中的性能评估。数据集中的模型经过持续预训练和指令微调,能够更好地适应特定领域的任务需求。此外,数据集的更新频率较高,确保了内容的时效性和前沿性,为研究人员和开发者提供了丰富的资源支持。

使用方法

该数据集的使用方法主要包括模型训练、性能评估和应用开发。研究人员可以通过下载数据集中的开源模型和数据集,进行进一步的微调和训练,以适应特定的垂直领域任务。评测基准则可用于评估模型在不同领域中的表现,帮助优化模型性能。开发者可以利用这些资源构建垂直领域的应用,如智能医疗诊断、法律咨询、金融分析等。数据集的开源性也为社区贡献提供了便利,用户可以通过提交新的模型、数据集或评测基准来丰富数据集内容。

背景与挑战

背景概述

随着以ChatGPT为代表的大语言模型的兴起,垂直领域的大模型应用逐渐成为研究热点。Awesome Domain LLM项目由luban-agi团队于2023年发起,旨在收集和梳理垂直领域的开源模型、数据集及评测基准。该项目涵盖了医疗、法律、金融、教育等多个领域,汇集了如ChiMed-GPT、DISC-LawLLM、Tongyi-Finance-14B等众多领域大模型。这些模型通过在通用模型基础上进行持续预训练或指令微调,显著提升了在特定领域的表现。该项目的推出为垂直领域的大模型研究提供了丰富的资源,推动了AI技术在各行业的深度应用。

当前挑战

垂直领域大模型的构建面临多重挑战。首先,领域数据的稀缺性和专业性使得数据收集与标注成本高昂,且需要领域专家的深度参与。其次,领域知识的复杂性和动态性要求模型具备强大的知识理解和更新能力,以确保输出的准确性和时效性。此外,领域模型的评测基准尚不完善,如何设计科学合理的评测体系以全面评估模型性能仍是一个亟待解决的问题。在构建过程中,如何平衡模型的通用性与领域特异性,以及如何有效利用有限的领域数据进行高效微调,也是研究者们需要克服的技术难题。

常用场景

经典使用场景

垂直领域的数据集及评测基准在自然语言处理领域中被广泛应用于特定领域的模型训练与评估。例如,医疗领域的ChiMed-GPT模型通过该数据集进行预训练和微调,显著提升了其在中文医疗问答中的表现。法律领域的DISC-LawLLM模型则利用该数据集进行法律文本的理解与生成,为法律从业者提供了智能化的法律咨询服务。金融领域的Tongyi-Finance-14B模型通过该数据集强化了金融知识的问答与推理能力,广泛应用于金融文本分析与决策支持。

衍生相关工作

该数据集衍生了许多经典的研究工作与应用模型。例如,ChiMed-GPT模型通过该数据集在中文医疗问答领域取得了显著成果,DISC-LawLLM模型则通过该数据集在法律文本生成与推理方面展现了强大的能力。此外,Tongyi-Finance-14B模型通过该数据集在金融领域的知识问答与逻辑推理中表现出色。这些模型不仅在学术研究中取得了重要突破,还在实际应用中推动了医疗、法律、金融等领域的智能化发展。

数据集最近研究

最新研究方向

随着大语言模型(LLM)在通用领域的广泛应用,垂直领域的模型定制化研究逐渐成为前沿热点。近年来,医疗、法律、金融等领域的垂直大模型研究取得了显著进展。例如,医疗领域的ChiMed-GPT和AlpaCare模型通过持续预训练和指令微调,显著提升了模型在医学问答和诊断支持中的表现。法律领域的DISC-LawLLM和LaWGPT模型则通过大规模法律语料的预训练和指令微调,增强了模型在法律咨询和案例分析中的专业性。金融领域的Tongyi-Finance-14B和DISC-FinLLM模型则专注于金融知识问答、文本分析和计算任务,展现了在复杂金融场景中的强大应用潜力。这些垂直领域大模型的研究不仅推动了行业智能化转型,也为大模型在特定领域的深度应用提供了新的研究方向。

以上内容由AI搜集并总结生成