Code_Alpaca_20K

收藏github2023-03-01 更新2025-02-07 收录

下载链接:

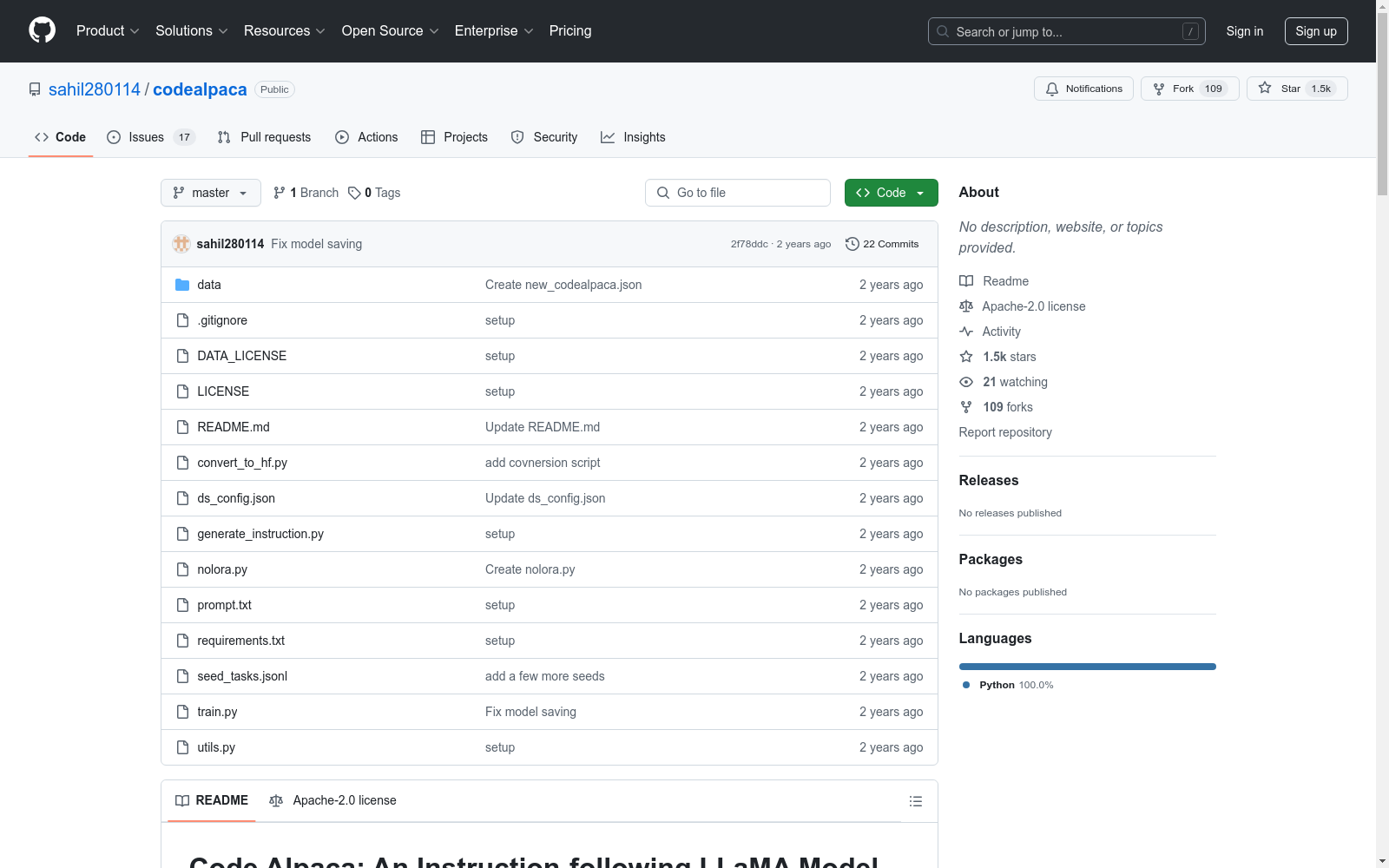

https://github.com/sahil280114/codealpaca

下载链接

链接失效反馈官方服务:

资源简介:

Code Alpaca 20K数据集是为微调Code Alpaca模型而设计的。该数据集的构建方法与Alpaca数据集相同,最终生成了20,000条指令。其优势在于提供了一个与代码相关的指令数据集。

The Code Alpaca 20K dataset is designed for fine-tuning the Code Alpaca model. The construction method of this dataset is identical to that of the Alpaca dataset, ultimately resulting in 20,000 instructions. Its advantage lies in providing a dataset of instructions related to code.

提供机构:

Sahil Chaudhary

创建时间:

2023-03-01

原始信息汇总

Code Alpaca 数据集概述

数据集基本信息

- 名称: Code Alpaca

- 类型: 代码生成指令数据集

- 数据量: 20K条指令数据

- 格式: JSON

- 文件路径:

data/code_alpaca_20k.json - 许可证: Apache 2.0

数据集内容

-

字段说明:

instruction: 描述模型应执行的任务(20K条唯一指令)input: 任务的可选上下文或输入(约40%示例包含此字段)output: 由text-davinci-003生成的指令答案

-

提示模板:

-

包含输入字段的示例:

Below is an instruction that describes a task, paired with an input that provides further context. Write a response that appropriately completes the request.

Instruction:

{instruction}

Input:

{input}

Response:

-

不包含输入字段的示例:

Below is an instruction that describes a task. Write a response that appropriately completes the request.

Instruction:

{instruction}

Response:

-

数据生成过程

- 方法: 基于Self-Instruct论文技术,修改为专注于代码生成/编辑/优化任务

- 成本: 低于200美元

- 种子任务: 仅与代码生成相关

- 包含子集: 2K样本数据集(用于降低风险和验证模型质量)

模型微调

-

基础模型: LLaMA 7B和13B

-

微调方法: Hugging Face训练代码+deepspeed

-

超参数:

参数 值 学习率 2e-5 训练轮数 3 最大长度 512 权重衰减 0 -

硬件要求: 8xA100 80GB(可调整配置以适应更低规格)

使用限制

- 模型权重未包含在发布中(因OpenAI TOS和LLaMA许可证限制)

- 模型未针对安全性和无害性进行微调,需谨慎使用

相关资源

- Demo: https://code-alpaca-demo.vercel.app/

- 基础模型论文: LLaMA论文[1]和Self-Instruct论文[2]

- 相关项目: Stanford Alpaca (https://github.com/tatsu-lab/stanford_alpaca)

引用

bibtex @misc{codealpaca, author = {Sahil Chaudhary}, title = {Code Alpaca: An Instruction-following LLaMA model for code generation}, year = {2023}, publisher = {GitHub}, journal = {GitHub repository}, howpublished = {https://github.com/sahil280114/codealpaca}, }

搜集汇总

数据集介绍

构建方式

Code_Alpaca_20K数据集的构建基于Self-Instruct技术,通过对20K条指令数据进行微调,生成适用于代码生成任务的模型。数据生成过程中,采用了修改后的提示模板,专注于代码生成、编辑和优化任务,而非通用任务。数据生成流程包括设置环境变量、安装依赖项并运行生成脚本,最终以较低成本生成了20K条指令数据。

特点

Code_Alpaca_20K数据集包含20K条独特的指令-输出对,每条数据由指令、输入(可选)和输出组成。其中约40%的示例包含输入字段,提供了任务所需的上下文信息。数据集的设计旨在支持代码生成任务,适用于微调LLaMA模型,使其能够根据指令生成高质量的代码。数据集的生成过程经过优化,确保了数据的多样性和任务相关性。

使用方法

使用Code_Alpaca_20K数据集时,首先需安装依赖项并配置环境变量。通过Hugging Face的transformers库和deepspeed工具,用户可以在多GPU环境下对LLaMA模型进行微调。微调过程中,需指定数据集路径、学习率、训练轮数等超参数。训练完成后,模型可用于代码生成任务,用户可通过提供的Web演示界面进行交互式测试。

背景与挑战

背景概述

Code_Alpaca_20K数据集由Sahil Chaudhary等人于2023年发布,旨在构建一个基于LLaMA模型的指令跟随代码生成模型。该数据集基于Stanford Alpaca项目,专注于代码生成任务,通过修改Self-Instruct论文中的技术生成20K条指令跟随数据。数据集的核心研究问题是如何通过指令微调提升模型在代码生成任务中的表现。该数据集的发布为代码生成领域的研究提供了新的基准,推动了自然语言处理与编程语言处理的交叉研究。

当前挑战

Code_Alpaca_20K数据集在构建和应用过程中面临多重挑战。首先,代码生成任务本身具有高度复杂性,模型需要理解自然语言指令并生成符合语法和语义的代码,这对模型的泛化能力提出了极高要求。其次,数据生成过程中需确保指令的多样性和任务的实用性,同时控制生成成本。此外,由于LLaMA模型的许可限制,模型权重未公开,这限制了数据集的广泛应用和复现。最后,模型在微调过程中需平衡计算资源与训练效率,尤其是在大规模数据集上的训练对硬件资源提出了较高要求。

常用场景

经典使用场景

Code_Alpaca_20K数据集在代码生成领域具有广泛的应用,尤其是在指令跟随模型的训练中。通过20K条指令数据,该数据集能够帮助模型理解和执行复杂的代码生成任务,如SQL查询优化、代码片段生成和代码修复等。这些任务通常需要模型具备高度的上下文理解能力和代码逻辑推理能力,而Code_Alpaca_20K通过其丰富的指令数据为模型提供了充分的训练素材。

解决学术问题

Code_Alpaca_20K数据集解决了代码生成领域中模型难以准确理解复杂指令的问题。通过提供大量多样化的指令数据,该数据集显著提升了模型在代码生成任务中的表现,尤其是在处理多语言代码、优化现有代码和生成新代码片段等方面。此外,该数据集还为研究人员提供了一个标准化的基准,用于评估和比较不同模型在代码生成任务中的性能,推动了该领域的学术研究进展。

衍生相关工作

Code_Alpaca_20K数据集衍生了一系列相关研究工作,特别是在基于LLaMA模型的代码生成领域。许多研究团队利用该数据集进一步优化了模型的指令跟随能力,开发出更高效的代码生成工具。例如,一些研究专注于提升模型在多语言代码生成中的表现,而另一些研究则探索了如何通过更复杂的指令数据提升模型的代码优化能力。这些工作不仅推动了代码生成技术的发展,也为未来的研究提供了新的方向。

以上内容由遇见数据集搜集并总结生成