ReMUD

收藏arXiv2025-06-09 更新2025-06-11 收录

下载链接:

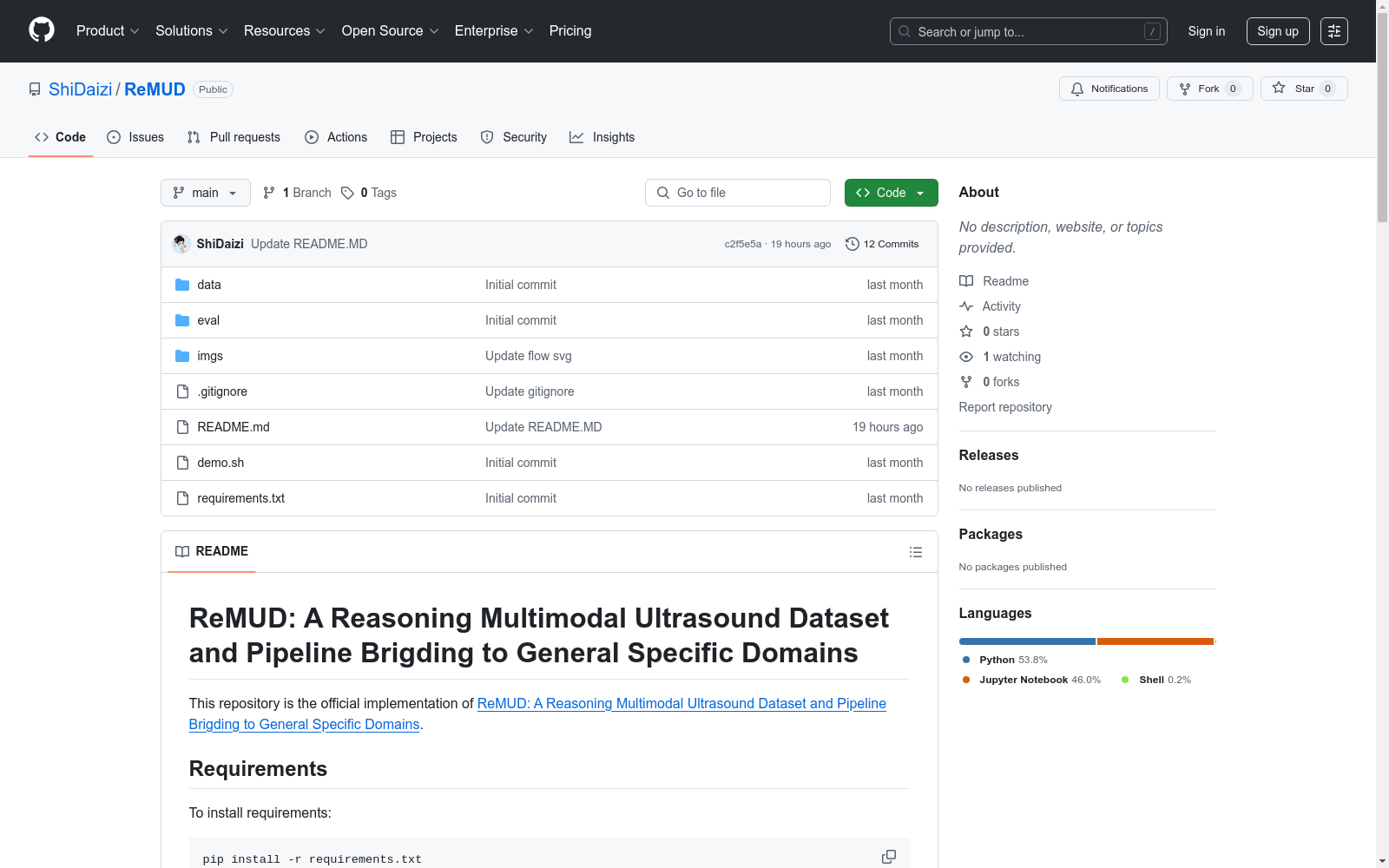

https://github.com/ShiDaizi/ReMUD

下载链接

链接失效反馈官方服务:

资源简介:

ReMUD数据集是由浙江大学数学科学学院的研究团队创建的,旨在解决医疗超声领域中多模态大数据的缺乏问题。数据集包含超过45,000条推理和非推理的监督微调问答数据,包括文本问答和视觉问答数据。ReMUD数据集的创建过程采用了自动化图像文本问答数据生成流程,从专业的医学超声书籍、临床超声指南和公共超声数据集中提取了丰富的图像和文本信息。该数据集主要包含中文内容,并包含少量英文数据。ReMUD数据集的应用领域是医疗超声领域,旨在提高多模态大型语言模型在特定领域的推理能力,以解决医疗超声领域中的问题。

The ReMUD dataset was developed by a research team from the School of Mathematical Sciences, Zhejiang University, to address the shortage of multimodal large-scale data in the medical ultrasound field. This dataset contains over 45,000 supervised fine-tuning question-answering (QA) entries, including both inferential and non-inferential samples, covering text-based QA and visual QA data. The creation of ReMUD adopted an automated image-text QA data generation pipeline, which extracts rich image and text information from professional medical ultrasound textbooks, clinical ultrasound guidelines, and public ultrasound datasets. The dataset primarily consists of Chinese-language content, with a small amount of English data included. Targeting the medical ultrasound domain, the ReMUD dataset aims to enhance the inferential capabilities of multimodal large language models (LLMs) in specialized fields to solve practical problems in the medical ultrasound sector.

提供机构:

浙江大学数学科学学院

创建时间:

2025-06-09

原始信息汇总

ReMUD数据集概述

数据集简介

- 名称:ReMUD (A Reasoning Multimodal Ultrasound Dataset)

- 类型:多模态超声数据集

- 用途:用于通用特定领域的推理任务

- 官方实现:ReMUD论文

数据处理流程

-

PDF转JPG

- 脚本:pdf2jpg.py

- 功能:将PDF文件转换为JPG图像

- 参数:

-f/--folder:PDF文件存储路径(默认:./pdf_files)-o/--output:输出图像存储路径(默认:./image)--height:输出图像高度(默认:1000)

-

边界框检测

- 脚本:QwenVLbbox.py

- 依赖:需要GPU运行Qwen2.5-VL-7B-Instruct模型

- 输出:

- 带边界框的原始图像

- 裁剪后的超声图像

- 边界框信息的JSON文件

- 参数:

-s/--start_page:起始页码-e/--end_page:结束页码-d/--device:运行设备(默认:cuda:0)-m/--model:模型路径(默认:Qwen/Qwen2.5-VL-7B-Instruct)

-

视觉问答生成

- 脚本:VQA.py

- 要求:需设置OpenAI API密钥和URL

- 参数:

--api_model:使用的OpenAI模型(默认:gpt-4o)--bbox_folder:边界框文件夹路径(默认:./save_bbox)--vqa_prompt:VQA任务提示词

预训练模型

- ReMUD-7B:基于ReMUD数据集训练的模型

实验结果

- 对比模型:Qwen2.5-VL-Ultra-7B表现优于其他多模态大语言模型

- 测试数据集:UVQA-Diagnosis(包含乳腺、肝脏和甲状腺三个超声部位)

- 备注:"w/o BF"表示未使用budget forcing技术

搜集汇总

数据集介绍

构建方式

在医学超声领域,专业知识的准确性和数据标准化程度直接影响多模态大语言模型的性能。ReMUD数据集通过创新的四元组(图像、问题、思维轨迹和答案)生成流程,从专业书籍、临床指南和公开数据中自动化构建。该流程利用Qwen2.5-VL的边界框功能定位PDF文档中的图像区域,结合GPT-4o等先进模型生成具有专业深度的视觉问答数据,并通过严格的提示工程确保知识可追溯性。数据清洗阶段采用三重过滤机制(质量、专业性和多样性),最终形成包含45,000余条数据的标准化集合。

特点

作为首个开源的医学超声多模态推理数据集,ReMUD展现出三大核心特征:其知识覆盖范围横跨心脏、肝脏等12个解剖区域,构成完整的专业图谱;数据类型兼具推理与非推理样本,其中17%的复杂推理问题包含显式思维链标注,有效支持模型因果推理能力;数据形式创新融合文本问答与视觉问答,46%的样本包含超声图像与专业描述的严格对齐,为多模态理解提供丰富素材。独特的生物结构分类体系与临床诊断场景的深度结合,使其成为领域内稀缺的基准资源。

使用方法

该数据集设计遵循模块化应用原则,研究者可通过分层采样策略实现灵活部署。对于基础能力训练,建议优先使用20,000条非推理QA数据建立知识基座;进阶微调阶段可引入7,600条带思维链的推理样本增强模型因果分析能力。视觉任务需配合原始图像路径与边界框坐标实现像素级对齐。评估环节推荐采用配套的USTQ-Knowledge文本测试集和UVQA-Diagnosis多模态测试集,通过pass@1指标量化模型在单选诊断问题上的表现。数据发布的JSON-LD格式确保与主流训练框架(如LLaMA-Factory)的无缝对接。

背景与挑战

背景概述

ReMUD(Reasoning Multimodal Ultrasound Dataset)是由浙江大学和德美医疗技术团队于2025年推出的医学超声领域多模态推理数据集。该数据集针对多模态大语言模型(MLLMs)在专业领域表现不足的问题,通过创新性的四元组(图像、问题、思维链、答案)生成管道,从超声教科书、临床指南等非结构化资料中构建了超过45,000条含推理与非推理的QA/VQA数据。作为首个开源的超声领域监督微调数据集,ReMUD显著提升了基础模型Qwen2.5-VL-7B在超声诊断任务中的表现,填补了专业领域多模态训练数据的空白,为医学影像与自然语言处理的交叉研究提供了重要基础设施。

当前挑战

构建ReMUD面临双重挑战:领域层面需解决医学超声图像与文本的复杂语义对齐问题,包括超声伪像识别、多模态临床知识融合等专业壁垒;技术实现上需克服PDF/图像等非结构化数据的自动化处理难题,如通过Qwen2.5-VL的边界框生成与GPT-4o的多模态理解能力实现图像-文本对的精确关联。此外,数据质量控制要求严格的专业验证流程,需结合OCR技术、专家审核和AI评分系统三重过滤机制,确保生成的4.5万条数据符合医学诊断的准确性标准。

常用场景

经典使用场景

在医学超声领域,ReMUD数据集通过其独特的图像-文本推理监督微调数据生成流程,为多模态大语言模型(MLLMs)提供了丰富的训练资源。该数据集包含超过45,000条推理和非推理的监督微调问答(QA)和视觉问答(VQA)数据,覆盖了乳腺、甲状腺、胎儿超声等多个子领域。研究者可以利用ReMUD数据集来训练和优化模型,使其在医学超声诊断和理解任务中表现出色。

衍生相关工作

ReMUD数据集的推出催生了一系列相关研究,特别是在医学多模态大语言模型领域。例如,基于ReMUD训练的ReMUD-7B模型在医学超声任务中表现优于通用领域的MLLMs。此外,该数据集的数据生成流程也被其他研究者借鉴,用于构建更多特定领域的多模态数据集,进一步推动了MLLMs在专业领域的应用。

数据集最近研究

最新研究方向

在医学超声领域,多模态大语言模型(MLLMs)的应用正逐渐成为研究热点。ReMUD数据集的推出填补了该领域高质量图像-文本对数据的空白,为模型训练提供了丰富的专业资源。前沿研究主要集中在如何通过自动化流程生成特定领域的四元组数据(图像、问题、思考轨迹和答案),以提升模型在专业场景下的推理能力。近期,结合边界框标注技术和先进MLLMs(如GPT-4o和Gemini-2.0)的数据生成管道成为关键突破点,显著降低了专业数据构建的人力成本。该方向与医疗AI的可解释性需求高度契合,尤其在超声诊断报告自动生成、病变推理等临床辅助场景展现出重要价值。

相关研究论文

- 1HAIBU-ReMUD: Reasoning Multimodal Ultrasound Dataset and Model Bridging to General Specific Domains浙江大学数学科学学院 · 2025年

以上内容由遇见数据集搜集并总结生成