laion/OIG

收藏Hugging Face2023-03-31 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/laion/OIG

下载链接

链接失效反馈资源简介:

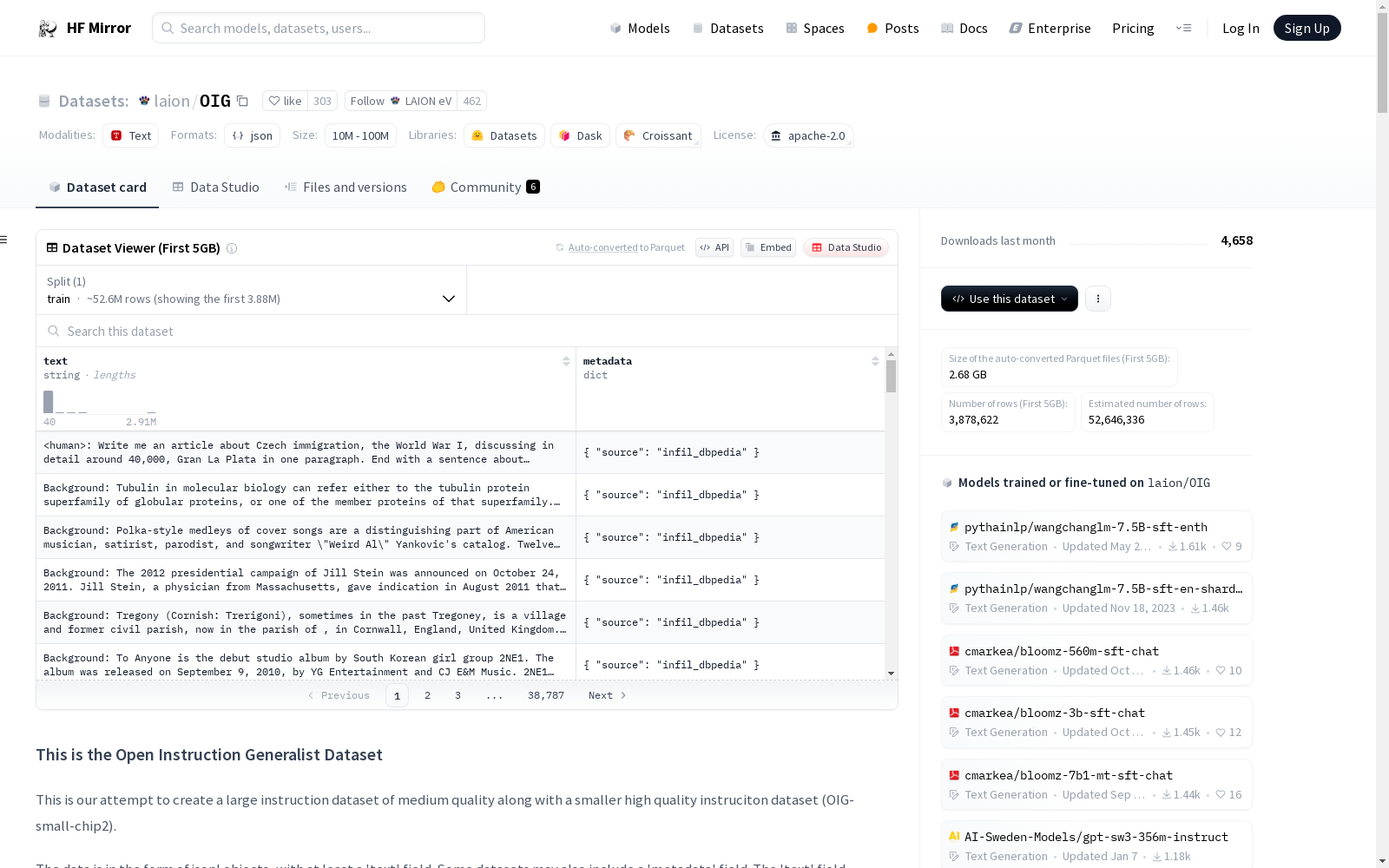

Open Instruction Generalist (OIG) 数据集是一个大规模的指令数据集,包含一个中等质量的大数据集和一个高质量的小数据集(OIG-small-chip2)。数据集以jsonl格式存储,包含至少一个text字段,可能还包括metadata字段。text字段包含一个或多个形式为<human>: instruction

<bot>: response的字符串。大数据集用于持续预训练,随后在小数据集上进行微调。小数据集OIG-small-chip2旨在通过少量额外计算将预训练的语言模型转换为指令跟随模型。数据集还包括多个子集,如unified_abstract_infill.jsonl、unified_basic.jsonl等,每个子集都有特定的来源和用途。

The Open Instruction Generalist (OIG) dataset is a large-scale instruction dataset comprising a medium-quality large dataset and a high-quality small dataset (OIG-small-chip2). It is stored in JSONL format, containing at least one `text` field, and may optionally include a `metadata` field. The `text` field holds one or more strings structured as `<human>: instruction

<bot>: response`. The large dataset is used for continuous pre-training, followed by fine-tuning on the small dataset. The small dataset OIG-small-chip2 aims to convert pre-trained language models into instruction-following models with minimal additional computational effort. The dataset also includes multiple subsets such as unified_abstract_infill.jsonl, unified_basic.jsonl, etc., each with specific sources and intended use cases.

提供机构:

laion

原始信息汇总

Open Instruction Generalist Dataset 概述

数据集描述

- 名称: Open Instruction Generalist Dataset

- 目的: 创建一个中等质量的大规模指令数据集,以及一个高质量的小型指令数据集(OIG-small-chip2)。

- 数据格式: JSONL 对象,包含至少一个 text 字段,部分数据集可能包含 metadata 字段。

- 数据内容示例:

- <human>: instruction <bot>: response

- <human>: instruction <bot>: response .. <human>: instruction <bot>: response

数据集组成部分

主要数据集

- unified_abstract_infill.jsonl: 约232000条记录,包含dbpedia和wikipedia片段及少量来自https://github.com/google-research/dialog-inpainting的数据。

- unified_basic.jsonl: 30条记录。

- unified_conv_finqa.jsonl: 约9000条记录,来自https://github.com/czyssrs/ConvFinQA。

- unified_cuad.jsonl: 约500条记录,来自https://www.atticusprojectai.org/cuad。

- unified_essays.jsonl: 约2000条记录,来自公开网络的论文。

- unified_grade_school_math_instructions.jsonl: 约9000条记录,来自https://github.com/openai/grade-school-math。

- unified_hc3_human.jsonl: 约58000条记录。

- unified_image_prompts_instructions.jsonl: 约15000条记录,来自LAION-400M的一个小部分。

- unified_joke_explanations.jsonl: 356条记录,从公开互联网爬取。

- unified_mathqa_flanv2_kojma_cot.jsonl: 约107000条记录,来自https://huggingface.co/datasets/math_qa。

- unified_merged_code_xp3.jsonl: 约67000条记录,来自https://huggingface.co/datasets/bigscience/xP3。

- unified_multi_news.jsonl: 约90000条记录,来自https://www.tensorflow.org/datasets/catalog/multi_news。

- unified_multi_sum.jsonl: 约1700000条记录。

- unified_nq.jsonl: 约307000条记录。

- unified_openai_summarize_tldr.jsonl: 约233000条记录,来自https://github.com/openai/summarize-from-feedback。

- unified_oscar_en_sample_dialog.jsonl: 约2670000条记录,来自https://oscar-project.org/和https://huggingface.co/datasets/TurkuNLP/register_oscar。

- unified_plot_screenplay_books_dialog.jsonl: 约8000条记录,来自https://github.com/markriedl/WikiPlots和https://huggingface.co/datasets/the_pile_books3。

- unified_sqlv1.jsonl: 约17000条记录,来自公共text2sql数据集。

- unified_sqlv2.jsonl: 约24000条记录,来自公共text2sql数据集。

- unified_squad_v2.jsonl: 约19000条记录,来自https://rajpurkar.github.io/SQuAD-explorer/。

- unified_squad_v2_more_neg.jsonl: 约19000条记录,来自https://rajpurkar.github.io/SQuAD-explorer/。

- unified_ul2_plus_oscar_en_sample_dialog.jsonl: 约2900000条记录,来自https://oscar-project.org/和https://huggingface.co/datasets/TurkuNLP/register_oscar。

- unified_unifiedskg_instructions.jsonl: 约223000条记录,来自https://github.com/HKUNLP/UnifiedSKG。

- unified_unnatural_instructions.jsonl: 约238000条记录,来自https://github.com/orhonovich/unnatural-instructions。

- unified_xp3_sample.jsonl: 约188000条记录,来自https://huggingface.co/datasets/bigscience/xP3。

- unified_canadian_parliament.jsonl: 约301000条记录,来自https://openparliament.ca/data-download/。

- unified_poetry_2_song.jsonl: 约12000条记录,来自https://huggingface.co/datasets/merve/poetry和https://huggingface.co/datasets/matthh/gutenberg-poetry-corpus。

- unified_flan.jsonl: 约2700000条记录,来自https://github.com/google-research/FLAN/tree/main/flan/v2。

- unified_ni.jsonl: 约256000条记录,来自https://github.com/allenai/natural-instructions。

- unified_p3.jsonl: 约31000000条记录,来自https://huggingface.co/datasets/bigscience/P3。

- unified_soda_dialog.jsonl: 约1200000条记录,来自https://huggingface.co/datasets/allenai/soda。

- unified_rallio_soda_upgraded_2048.jsonl: 约210000条记录,来自https://huggingface.co/datasets/allenai/soda,是unified_soda_dialog数据集的新版本。

- unified_rallio_safety_and_prosocial.jsonl: 约319000条记录,来自公开数据集和Wiki,包含https://huggingface.co/datasets/allenai/prosocial-dialog和https://huggingface.co/datasets/Anthropic/hh-rlhf。

OIG-small-chip2 数据集

- 目的: 用于将预训练的大型语言模型转换为遵循指令的模型,通过微调或软提示调整。

- 内容:

- Python Code Examples: 约6000条记录,包含用户请求代理生成Python函数的指令/响应对。

- Natural Instruction Examples: 约124000条记录,包含多样化的自然和事实问题及答案。

- Generic Harmless Instruction Examples: 约6500条记录,来自Anthropic redteam paper github。

- Instruction/Responses with Lists: 约14000条记录,包含响应中包含列表的指令/响应对。

- Follow-up questions: 约12500条记录,包含适当的响应是请求更多信息的指令和响应。

- Wikipedia Toxic Adversarial Questions: 约12000条记录,来自讨论潜在敏感话题的Wikipedia文章。

- Grade School Math GSM8K: 约9000条记录,来自https://github.com/openai/grade-school-math。

- Reasoning Instructions: 约4500条记录,来自Com2Sense和Strategy QA数据集。

- Character and Scene Descriptions: 约30000条记录,包含生成角色或场景描述的指令和响应。

数据集使用建议

- 建议直接下载所需的单个jsonl文件,而不是使用HF load_datasets。

许可证

- 数据集由LAION志愿者编写,根据Apache 2.0许可证发布。数据集还包括其他许可内容,如Wikipedia数据和网络爬虫数据。

搜集汇总

数据集介绍

构建方式

Open Instruction Generalist (OIG) 数据集的构建,是通过集成多样化的指令数据,涵盖从人类编写的数学问题到自然语言指令等众多领域。数据集采用了jsonl格式存储,每个条目至少包含一个'text'字段,部分条目还包括'metadata'字段。构建过程中,数据来源于多个子数据集,如dbpedia和wikipedia的片段、数学问题、对话数据等,经过整合和格式化处理后,形成了大规模的指令数据集,旨在为语言模型的预训练和微调提供丰富的资源。

使用方法

使用OIG数据集时,推荐直接下载所需的jsonl文件,而不是使用HF load_datasets方法。用户可以针对特定的预训练任务,选择合适的数据子集进行训练。数据集的目的是为了支持语言模型从大规模的预训练到最终的微调,以实现指令跟随模型的转换。同时,用户在使用时应当注意数据中可能包含的敏感内容,并进行适当的筛选和处理。

背景与挑战

背景概述

Open Instruction Generalist (OIG) 数据集,由LAION组织创建,旨在构建一个大规模的中等质量指令数据集以及一个更小规模的高质量指令数据集(OIG-small-chip2)。该数据集采用jsonl格式,包含至少一个'text'字段,某些数据集还包含'metadata'字段。OIG数据集的目的是为了继续进行预训练,随后在更小的优质数据集上进行微调。该数据集的创建时间为2023年3月,主要研究人员包括LAION组织的志愿者和贡献者。OIG数据集的研究背景是为了构建有帮助且非毒性的指令调整模型,并使其可供所有人使用。该数据集对自然语言处理和机器学习领域产生了显著影响,特别是在指令微调模型的发展上。

当前挑战

OIG数据集在构建过程中面临的挑战包括确保数据的质量和格式化,以及在数据集中融入多样化的指令。另一个挑战是,数据集包含了一些可能包含有害或敏感内容的数据,需要对其进行适当的检查和过滤。此外,为了构建1万亿个多样化指令的目标,数据集的规模不断扩大,这对数据的质量控制和处理提出了更高的要求。

常用场景

经典使用场景

在自然语言处理领域,指令微调是构建智能体的重要步骤。LAION/OIG 数据集为此提供了丰富的指令响应对,旨在通过预训练与微调相结合的方式,将通用预训练语言模型转化为遵循特定指令的模型。经典的使用场景包括使用该数据集对大型语言模型进行指令微调,进而使其能够理解和执行人类的复杂指令,如生成代码、解答数学问题、执行推理任务等。

解决学术问题

LAION/OIG 数据集解决了学术研究中如何有效微调大型语言模型以理解和执行复杂指令的问题。通过提供多样化的指令和响应对,该数据集使得研究人员能够在不同领域和任务中进行指令微调,从而提高语言模型在实际应用中的性能和准确性。这对于构建高效、可靠的人工智能系统具有重要意义。

实际应用

实际应用中,LAION/OIG 数据集可用于开发智能对话系统、自动化助手以及各类需要理解并执行人类指令的应用。例如,在客户服务、教育辅导、编程辅助等领域,基于该数据集微调的语言模型能够提供更加精准和个性化的响应,提升用户体验和服务效率。

数据集最近研究

最新研究方向

在自然语言处理领域,Open Instruction Generalist (OIG) 数据集的构建旨在推动指令微调技术的发展,特别是在生成具有高质量、多样化响应的预训练语言模型方面。该数据集通过整合和筛选大量的人类编写指令与响应对,为研究者提供了一个丰富的资源库,以继续预训练和微调语言模型。近期的研究方向主要集中在如何利用OIG数据集来提高模型在理解和执行复杂指令方面的能力,尤其是在多步推理和数学问题解决领域。此外,研究还关注如何通过微调来降低模型产生有害内容的风险,确保模型输出的安全性和有益性。这一研究方向对于提升人机交互的自然性和效率,以及构建更加可靠和安全的AI系统具有重要意义。

以上内容由遇见数据集搜集并总结生成