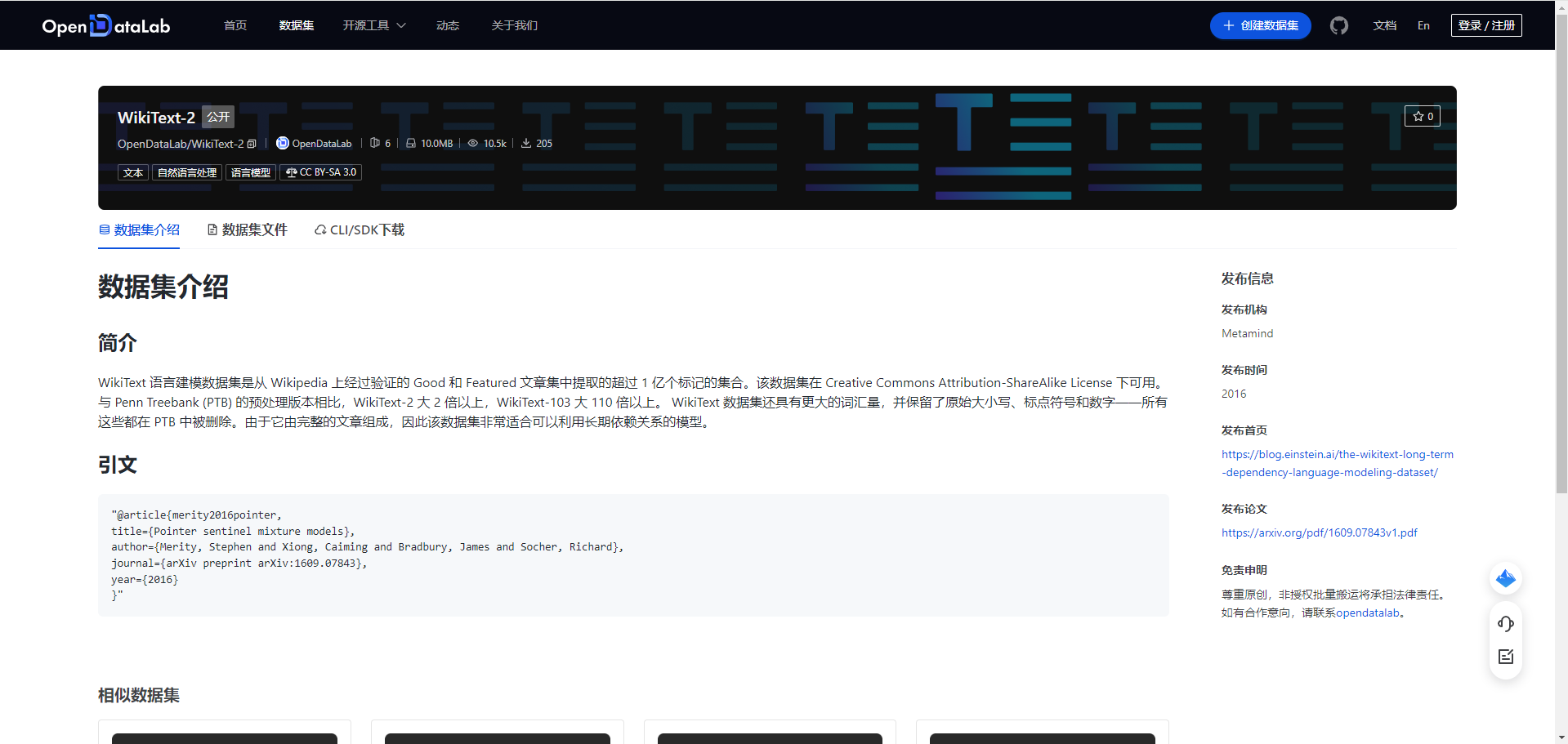

WikiText-2

收藏OpenDataLab2026-04-05 更新2024-05-09 收录

下载链接:

https://opendatalab.org.cn/OpenDataLab/WikiText-2

下载链接

链接失效反馈资源简介:

WikiText 语言建模数据集是从 Wikipedia 上经过验证的 Good 和 Featured 文章集中提取的超过 1 亿个标记的集合。该数据集在 Creative Commons Attribution-ShareAlike License 下可用。与 Penn Treebank (PTB) 的预处理版本相比,WikiText-2 大 2 倍以上,WikiText-103 大 110 倍以上。 WikiText 数据集还具有更大的词汇量,并保留了原始大小写、标点符号和数字——所有这些都在 PTB 中被删除。由于它由完整的文章组成,因此该数据集非常适合可以利用长期依赖关系的模型。

The WikiText language modeling dataset is a collection of over 100 million tokens extracted from the verified Good and Featured articles on Wikipedia. The dataset is available under the Creative Commons Attribution-ShareAlike License. Compared to the preprocessed version of Penn Treebank (PTB), WikiText-2 is more than twice as large, while WikiText-103 is over 110 times larger. The WikiText dataset also features a larger vocabulary, and retains original casing, punctuation, and numbers—all of which were removed in PTB. Composed of full-length articles, this dataset is ideal for models that can leverage long-term dependencies.

提供机构:

OpenDataLab

创建时间:

2022-04-28

AI搜集汇总

数据集介绍

构建方式

WikiText-2数据集源自维基百科,通过精心筛选和预处理,保留了高质量的文本内容。构建过程中,首先从维基百科中提取了大量的文章,随后通过去除模板、注释和非文本内容,确保了数据集的纯净性。此外,数据集还进行了分词和标准化处理,以适应自然语言处理任务的需求。

使用方法

WikiText-2数据集广泛应用于自然语言处理领域,特别是在语言模型训练和评估中。研究者可以利用该数据集进行词嵌入、文本生成、机器翻译等多种任务的实验。通过加载数据集,研究者可以快速构建和验证自己的模型,从而推动自然语言处理技术的发展。

背景与挑战

背景概述

WikiText-2数据集,由Salesforce研究团队于2016年创建,旨在为自然语言处理(NLP)领域提供一个高质量的文本数据源。该数据集源自维基百科,包含超过1亿个单词,涵盖了广泛的主题和语言风格。其核心研究问题在于评估和提升语言模型的性能,特别是在长文本序列的处理和生成方面。WikiText-2的发布对NLP研究产生了深远影响,为研究人员提供了一个标准化的基准,促进了语言模型、文本生成和机器翻译等领域的技术进步。

当前挑战

尽管WikiText-2在NLP领域具有重要地位,但其构建和应用过程中仍面临诸多挑战。首先,数据集的规模和多样性要求高效的预处理和清洗技术,以确保数据质量。其次,长文本序列的处理对计算资源和模型架构提出了高要求,尤其是在处理复杂语义和上下文依赖时。此外,如何有效利用该数据集进行模型训练,同时避免过拟合和数据偏差,也是当前研究的重要课题。这些挑战不仅影响了数据集的应用效果,也推动了NLP技术的不断创新和发展。

发展历史

创建时间与更新

WikiText-2数据集由Salesforce研究团队于2016年创建,旨在为自然语言处理任务提供高质量的文本数据。该数据集的最新版本于2017年发布,此后未有官方更新。

重要里程碑

WikiText-2数据集的发布标志着自然语言处理领域对大规模、高质量文本数据需求的响应。其包含超过1亿个单词的维基百科文章,为语言模型训练提供了丰富的语料库。该数据集在多个自然语言处理任务中表现出色,如语言建模、文本生成和机器翻译,成为研究者和开发者的重要资源。

当前发展情况

当前,WikiText-2数据集仍然是自然语言处理领域的重要基准之一。尽管近年来出现了更多大规模和多样化的数据集,WikiText-2因其高质量和结构化的文本数据,仍被广泛用于评估和训练语言模型。其在学术研究和工业应用中的持续使用,证明了其对推动自然语言处理技术发展的贡献。

发展历程

- WikiText-2数据集首次发表,作为用于语言建模任务的标准基准数据集。

- WikiText-2数据集被广泛应用于自然语言处理领域的研究,特别是在长文本建模和预训练语言模型中。

- 随着深度学习技术的发展,WikiText-2数据集成为评估和比较不同语言模型性能的重要工具。

- WikiText-2数据集在多个国际会议和期刊上被引用,进一步巩固了其在语言建模研究中的地位。

- WikiText-2数据集被用于训练和验证新一代预训练语言模型,如BERT和GPT-3的变体。

常用场景

经典使用场景

在自然语言处理领域,WikiText-2数据集以其高质量的文本内容和广泛的应用场景而著称。该数据集源自维基百科,包含了超过200万词的文本,涵盖了多种主题和领域。其经典使用场景包括但不限于语言模型训练、文本生成、机器翻译以及文本分类等。通过利用WikiText-2,研究者能够构建和评估各种先进的自然语言处理模型,从而推动该领域的发展。

解决学术问题

WikiText-2数据集在解决自然语言处理领域的多个学术研究问题上发挥了重要作用。首先,它为语言模型的训练提供了丰富的语料库,使得模型能够更好地理解和生成自然语言。其次,该数据集在文本生成任务中表现出色,帮助研究者探索和优化生成模型的性能。此外,WikiText-2还为机器翻译和文本分类等任务提供了高质量的训练数据,推动了这些领域的研究进展。

实际应用

在实际应用中,WikiText-2数据集被广泛用于构建和优化各种自然语言处理系统。例如,在智能助手和聊天机器人中,该数据集用于训练语言模型,以提高对话的自然性和准确性。在内容生成领域,WikiText-2帮助生成高质量的文章和报告,提升自动化写作的效率和质量。此外,该数据集还被用于新闻摘要生成、法律文书分析等实际应用场景,显著提升了相关系统的性能。

数据集最近研究

最新研究方向

在自然语言处理领域,WikiText-2数据集因其高质量的文本数据而备受关注。最新研究方向主要集中在利用该数据集进行预训练语言模型的优化。研究者们通过在WikiText-2上进行大规模预训练,探索如何提升模型在下游任务中的表现,特别是在长文本理解和生成方面的能力。此外,该数据集还被用于评估模型在不同语言风格和复杂语境下的适应性,推动了多语言和跨文化文本处理技术的发展。这些研究不仅深化了对语言模型内部机制的理解,也为实际应用中的文本生成和理解提供了新的工具和方法。

相关研究论文

- 1Pointer Sentinel Mixture ModelsSalesforce Research · 2017年

- 2BERT: Pre-training of Deep Bidirectional Transformers for Language UnderstandingGoogle AI Language · 2019年

- 3RoBERTa: A Robustly Optimized BERT Pretraining ApproachFacebook AI Research · 2019年

- 4T5: Exploring the Limits of Transfer Learning with a Unified Text-to-Text TransformerGoogle AI · 2020年

- 5Longformer: The Long-Document TransformerAllen Institute for AI · 2020年

以上内容由AI搜集并总结生成