Resume Categorization Dataset

收藏github2024-10-13 更新2024-10-22 收录

下载链接:

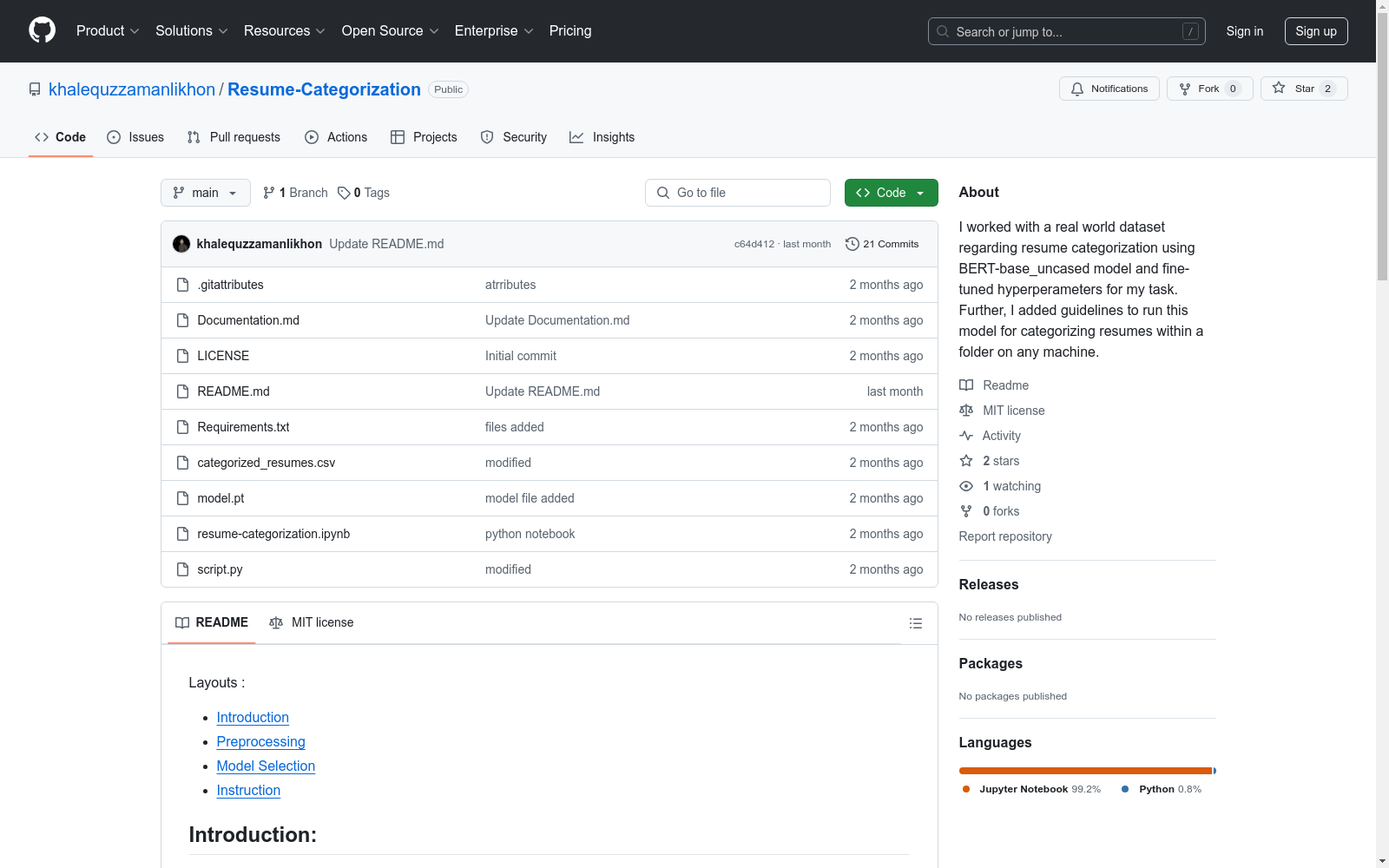

https://github.com/khalequzzamanlikhon/Resume-Categorization

下载链接

链接失效反馈资源简介:

该数据集用于自动分类简历。数据集包含四个列:ID、Resume_str、Resume_html和Category。Category列有24个不同的类别。数据集经过预处理后,使用BERT模型进行训练和分类。

This dataset is intended for automatic resume classification. It includes four columns: ID, Resume_str, Resume_html, and Category. The Category column encompasses 24 distinct categories. After preprocessing, the dataset is employed for training and classification via the BERT model.

创建时间:

2024-09-21

原始信息汇总

数据集概述

简介

该数据集旨在自动分类简历。数据集包含一个CSV文件,其中包含三个特征列:resume_str、resume_html 和目标列 category。经过预处理后,使用了BERT模型进行训练,并在验证集上达到了80%的准确率和召回率。

数据预处理

数据集包含四列:ID、Resume_str、Resume_html 和 Category。目标列 Category 包含24个不同的类别,并被编码为整数值。由于HTML标签不提供语义意义,仅保留了 Resume_str 列作为特征。

预处理步骤

- 忽略

Resume_html:HTML标签仅表示设计和结构,不提供语义意义,因此被忽略。 - 分词:使用BERT的分词器对

Resume_str列进行分词,BERT的分词器(Word piece)有助于处理词汇外单词,并帮助模型识别实际内容和填充内容。 - 数据分割:将数据集分为训练集、验证集和测试集,并在分词前将其转换为Hugging Face数据集格式。

模型选择

选择了BERT-base-uncased模型进行训练。BERT模型在处理NLP任务时表现出色,能够捕捉文本中的上下文关系。

选择BERT模型的原因

- BERT在文本分类任务中表现出色。

- BERT能够理解单词在句子中的上下文。

- BERT经过大规模语料库(如维基百科)的训练,能够理解语法和常见语言模式。

- BERT能够处理长文本,适合处理简历数据。

模型微调

对BERT模型进行了微调,使用了自定义的超参数,包括5个epochs、学习率2e-5、批量大小16和权重衰减0.01。

评估指标

使用准确率、F1分数、精确率和召回率来评估模型性能。

使用说明

提供了一个 script.py 文件,可以在本地机器上运行以进行预测。需要安装 torch 和 transformers 等库,并按照说明运行脚本。

使用步骤

- 下载

model.pt、script.py和Requirements.txt文件。 - 安装依赖项:

pip install -r Requirements.txt。 - 运行脚本:

python script.py /path to folder,其中/path to folder是包含PDF格式简历的文件夹路径。

script.py 功能

该脚本接受一个包含PDF格式简历的文件夹作为输入,对每个简历进行预测,并将结果存储为CSV文件和按类别分类的文件夹。

AI搜集汇总

数据集介绍

构建方式

该数据集的构建基于一个包含resume_str、resume_html和目标列(category)的CSV文件。在预处理阶段,数据集中的Resume_str列被选择为主要特征,而Resume_html列因可能引入不必要的噪声被舍弃。通过BERT的tokenizer进行分词处理,确保模型能够有效处理词汇表外的单词,并使用attention mask区分实际内容与填充部分。数据集被分割为训练集、验证集和测试集,并转换为Hugging Face数据集格式以优化分词过程。

特点

该数据集的显著特点在于其采用了BERT模型进行文本分类,该模型以其对上下文关系的捕捉能力著称,特别适用于处理长文本如简历。此外,数据集的预处理步骤精细,确保了特征选择和分词过程的高效性,从而提升了模型的分类准确性。数据集包含24个不同的类别,覆盖了广泛的简历类型,为模型训练提供了丰富的多样性。

使用方法

用户可以通过下载model.pt、script.py和Requirements.txt文件,并在本地安装所需的依赖库来使用该数据集。运行script.py脚本时,需指定包含PDF格式简历的文件夹路径,脚本将自动对每个简历进行分类预测,并将结果存储为CSV文件和按类别分类的文件夹结构。此方法确保了模型在CPU上的推理能力,无需依赖GPU资源。

背景与挑战

背景概述

简历分类数据集(Resume Categorization Dataset)旨在通过自动化技术对简历进行分类。该数据集由一个CSV文件构成,包含resume_str、resume_html和目标列(category)等特征。主要研究人员利用BERT模型进行训练,该模型在文本分类任务中表现出色,经过微调后在验证集上达到了80%的准确率和召回率。该数据集的创建旨在解决简历分类这一实际问题,对人力资源管理领域具有重要影响。

当前挑战

简历分类数据集在构建和应用过程中面临多项挑战。首先,文本数据的预处理,特别是Tokenization,是处理文本数据的核心难题。其次,选择合适的模型(如BERT)并进行微调,以适应特定任务的需求,也是一大挑战。此外,数据集包含24个不同的类别,如何确保模型在多类别分类任务中的表现,以及如何在不同硬件环境下(如GPU和CPU)保持模型性能的一致性,都是需要解决的问题。

常用场景

经典使用场景

在简历分类领域,Resume Categorization Dataset的经典使用场景主要集中在自动化简历分类任务上。该数据集通过提供丰富的简历文本数据,使得基于BERT模型的文本分类任务得以高效实施。通过预处理步骤,如文本清洗和标记化,数据集被转化为适合BERT模型输入的格式。随后,模型在训练集上进行微调,以实现对简历类别的精准分类。这一过程不仅提高了分类的准确性,还确保了模型在不同硬件环境下的可移植性。

实际应用

在实际应用中,Resume Categorization Dataset被广泛用于人力资源管理领域,特别是在简历筛选和分类过程中。通过自动化简历分类,企业能够快速且准确地筛选出符合特定职位要求的候选人,从而提高招聘效率。此外,该数据集的应用还扩展到教育机构,用于学生简历的分类和评估,帮助学生更好地规划职业发展路径。这种自动化分类方法不仅节省了大量人力成本,还显著提高了分类的准确性和一致性。

衍生相关工作

基于Resume Categorization Dataset,研究者们开展了一系列相关工作,进一步推动了文本分类技术的发展。例如,有研究通过引入更复杂的预处理技术,如多模态数据融合,来提升分类模型的性能。此外,还有研究探索了不同预训练语言模型在简历分类任务中的表现,比较了BERT、GPT等模型的优劣。这些衍生工作不仅丰富了文本分类领域的研究内容,还为实际应用提供了更多技术选择和优化方案。

以上内容由AI搜集并总结生成