DeepResearch Bench

收藏arXiv2025-06-13 更新2025-06-17 收录

下载链接:

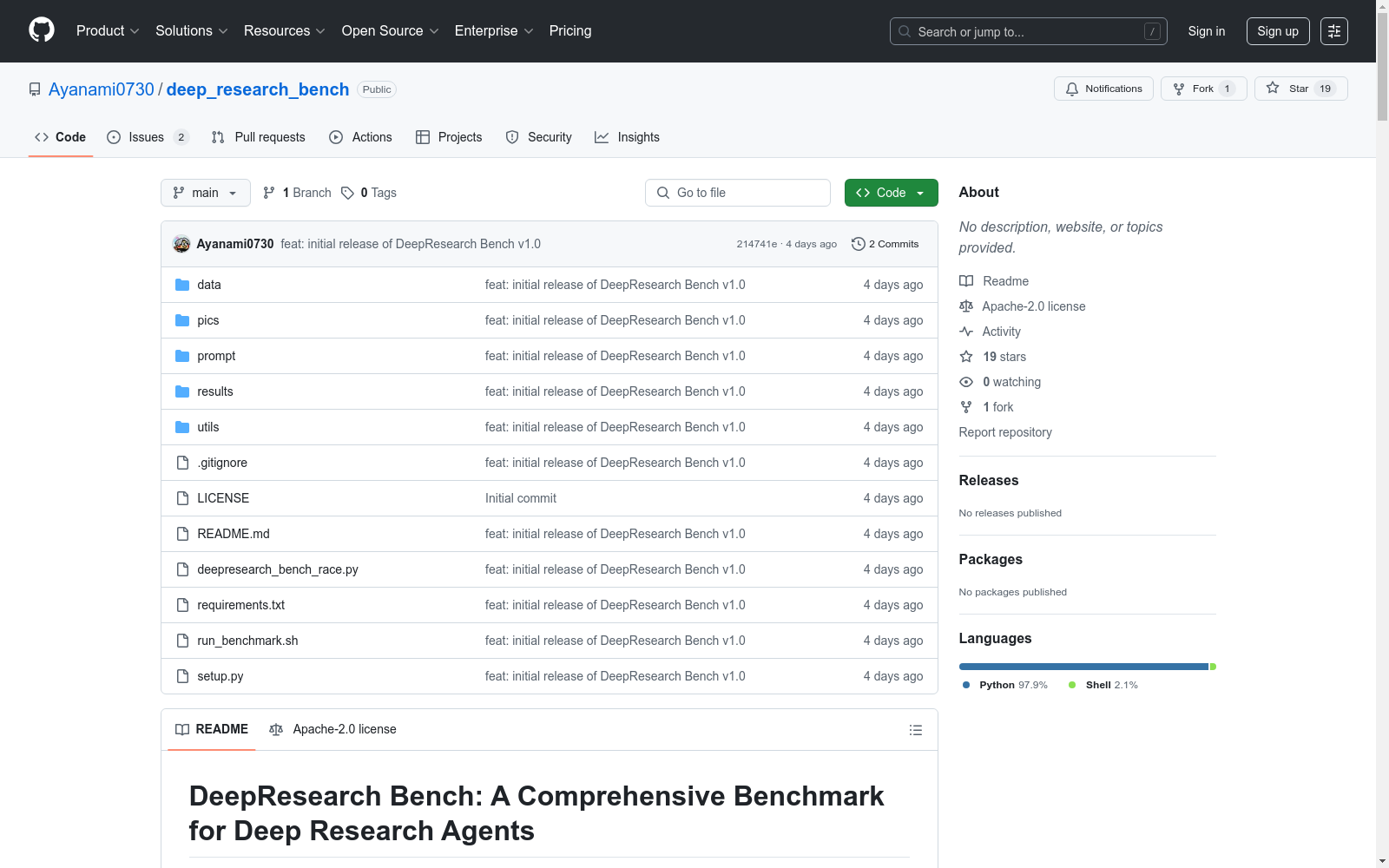

https://github.com/Ayanami0730/deep_research_bench

下载链接

链接失效反馈资源简介:

DeepResearch Bench是一个由100个博士级别的研究任务组成的基准数据集,这些任务由来自22个不同领域的专家精心设计。该数据集旨在评估深度研究代理的能力,这些代理通过自主组织多步骤的网络探索、有针对性的检索和高级别的合成,将大量的在线信息转化为分析师级别的、引用丰富的报告。数据集包含50个中文任务和50个英文任务,每个任务都经过迭代优化,以确保其真实反映实际研究需求。该数据集的创建过程包括对96,147个真实用户查询的统计分析,以及由具有丰富经验的专家提出和筛选的任务。DeepResearch Bench不仅用于评估深度研究代理的生成报告质量,还用于评估其信息检索和收集能力。

DeepResearch Bench is a benchmark dataset consisting of 100 doctoral-level research tasks, meticulously designed by experts from 22 distinct fields. This dataset aims to evaluate the capabilities of deep research agents, which transform vast volumes of online information into analyst-level, heavily cited reports through autonomous organization of multi-step web exploration, targeted retrieval, and high-level synthesis. The dataset contains 50 Chinese tasks and 50 English tasks, each of which has undergone iterative optimization to accurately reflect real-world research needs. The creation process of DeepResearch Bench includes statistical analysis of 96,147 real user queries, as well as task proposal and screening by seasoned experts. DeepResearch Bench is used not only to assess the quality of reports generated by deep research agents but also to evaluate their information retrieval and collection capabilities.

提供机构:

中国科学院大学, 北京, 中国

创建时间:

2025-06-13

原始信息汇总

DeepResearch Bench 数据集概述

📖 数据集简介

DeepResearch Bench 是一个针对深度研究代理(DRAs)的系统性评估基准,包含100个博士级别的研究任务,涵盖22个不同领域。

🌐 领域覆盖

- 🔬 科学与技术:物理、化学、生物、环境科学、工程

- 💼 金融与商业:投资、个人理财、市场营销、人力资源

- 💻 软件:与软件和互联网相关的主题

- 🌍 其他领域:艺术与设计、娱乐、历史、工业、交通、旅游等

📊 数据构建

主题分布分析

- 基于96,147条匿名用户查询(来自支持网页搜索的LLM交互)

- 按WebOrganizer分类法分为22个主题域

专家任务收集

- 由博士级专家和资深从业者(5年以上经验)设计

- 100个高质量基准任务(50中文,50英文)

- 筛选标准:

- 质量:高标准和复杂性

- 清晰度:明确的任务定义和要求

- 真实性:基于真实研究场景

- 挑战性:测试DRA能力上限

⚖️ 评估框架

🎯 RACE(基于参考的自适应标准驱动评估)

- 动态标准生成(四个关键维度):

- 全面性

- 洞察力/深度

- 指令遵循

- 可读性

- 基于参考的评分

- 加权评估

🔗 FACT(事实丰富性和引用可信度框架)

- 声明-URL提取

- 去重

- 支持验证

- 引用指标:

- 引用准确率

- 有效引用数

📈 主要评估结果

| 模型 | RACE总分 | RACE全面性 | RACE深度 | RACE指令 | RACE可读性 | FACT引用准确率 | FACT有效引用数 |

|---|---|---|---|---|---|---|---|

| 表现最佳模型 | |||||||

| Gemini-2.5-Pro Deep Research | 48.88 | 48.53 | 48.50 | 49.18 | 49.44 | 81.44 | 111.21 |

| Perplexity Deep Research | 42.25 | 40.69 | 39.39 | 46.40 | 44.28 | 90.24 | 31.26 |

| Claude-3.7-Sonnet w/Search | 40.67 | 38.99 | 37.66 | 45.77 | 41.46 | 93.68 | 32.48 |

🛠️ 使用说明

数据结构

deep_research_bench/ ├── data/ │ ├── prompt_data/query.jsonl # 100个基准查询 │ └── test_data/raw_data/ # 模型输出存放位置

快速开始

- 使用

query.jsonl中的查询运行您的深度研究代理 - 将输出保存为

<model_name>.jsonl格式 - 在

run_benchmark.sh中添加模型名称 - 运行评估脚本

📚 引用

bibtex @article{du2025deepresearch, author = {Mingxuan Du and Benfeng Xu and Chiwei Zhu and Xiaorui Wang and Zhendong Mao}, title = {DeepResearch Bench: A Comprehensive Benchmark for Deep Research Agents}, journal = {arXiv preprint}, year = {2025}, }

AI搜集汇总

数据集介绍

构建方式

DeepResearch Bench的构建过程体现了严谨的学术规范与真实用户需求的深度结合。研究团队通过分析96,147条真实用户查询数据,采用DeepSeek-V3-0324模型进行深度研究任务筛选,最终基于WebOrganizer提出的22个主题分类体系,构建了包含44,019条查询的语料库。为确保基准任务的专业性与挑战性,特邀各领域资深专家(博士或5年以上从业经验)参与任务设计,经过多轮质量筛选后形成100个中英双语研究任务(中英文各50个),任务分布严格遵循真实用户需求的统计规律。

特点

该数据集的核心特征体现在三个方面:领域覆盖的广泛性,包含22个学科领域的PhD级研究任务;任务设计的真实性,所有任务均源自对96,000+真实用户查询的统计分析;评估维度的创新性,首次提出RACE(报告质量评估)和FACT(引用准确性评估)双框架体系。特别值得注意的是,数据集通过动态权重分配机制实现任务特异性评估,其中RACE框架的四个评估维度(全面性、洞察力、指令遵循、可读性)权重可根据任务特点自适应调整,FACT框架则开创性地引入有效引用计数和引用准确率量化指标。

使用方法

使用DeepResearch Bench需遵循标准化评估流程:首先通过RACE框架对生成报告进行多维度质量评估,该框架采用动态权重生成(公式1)和基于参考报告的相对评分机制(公式3);继而应用FACT框架进行事实核查,包括声明-URL对提取、去重、支持判断等步骤(公式4-6)。评估时建议采用Gemini-2.5-pro作为RACE的评判模型,Gemini-2.5-flash处理FACT的引用验证。数据集已开源关键组件,用户可通过GitHub仓库快速部署评估环境,所有任务均提供标准化的提示模板(含系统角色、用户提示、输出格式等完整结构)。

背景与挑战

背景概述

DeepResearch Bench是由中国科学技术大学与Metastone Technology的研究团队于2025年6月推出的首个专注于深度研究智能体(Deep Research Agents, DRAs)评估的基准测试。该数据集包含22个学科领域的100个博士级研究任务,通过分析96,000余条真实用户查询构建任务分布,并由领域专家精心设计任务内容。作为大型语言模型(LLM)智能体的重要分支,DRAs通过自主网络探索、定向检索和高阶信息合成,将海量网络信息转化为分析师级、引用翔实的研究报告,显著提升研究效率。该数据集的建立填补了系统性评估研究型智能体能力的空白,为AI在复杂研究任务中的应用提供了标准化测评框架。

当前挑战

DeepResearch Bench面临双重挑战:在领域问题层面,评估研究型智能体存在固有复杂性,因其非透明的推理过程和开放式的研究报告生成特性,难以建立绝对标准答案;同时,多维度质量评估(如信息全面性、分析深度)需突破传统静态评分范式的局限。在构建层面,需解决真实研究需求与基准规模间的平衡问题——每个任务需博士级专家参与设计验证,导致数据扩展成本高昂;此外,跨学科任务分布需避免领域偏差,而人类专家评估长文本研究报告的效率瓶颈(单报告耗时30-60分钟)也制约了验证规模。

常用场景

经典使用场景

DeepResearch Bench作为首个专注于深度研究代理(DRA)评估的基准,其经典使用场景在于系统化测试多步骤网络探索、定向检索与高阶信息合成的综合能力。该数据集通过22个学科领域的100项博士级研究任务,模拟真实学术调研流程,尤其适用于评估LLM代理从海量网络信息中生成分析师级、引用翔实报告的效率与质量。其动态权重评估框架(RACE)和事实丰度验证体系(FACT)为量化代理的检索准确性与报告深度提供了标准化测试环境。

衍生相关工作

该数据集催生了三类重要衍生工作:一是评估方法的扩展,如WebThinker将RACE框架适配跨语言研究代理测试;二是新型代理架构开发,如DeepResearcher通过强化学习优化本基准的任务完成率;三是垂直领域基准构建,ScienceAgentBench等借鉴其动态权重设计评估科学发现代理。开源4个月即引发20+后续研究,推动Agent评估从单任务向复杂认知流程的范式转变。

数据集最近研究

最新研究方向

DeepResearch Bench作为首个专注于深度研究代理(Deep Research Agents, DRAs)评估的综合性基准,其最新研究聚焦于多模态信息整合与动态评估框架的优化。随着大语言模型在复杂研究任务中的广泛应用,该数据集通过引入自适应权重分配机制(RACE框架)和事实引用可信度验证(FACT框架),显著提升了生成报告的维度特异性评估能力。当前前沿探索包括:跨语言任务的迁移学习性能验证、基于强化学习的自主检索策略优化,以及引用网络的可解释性分析。2025年谷歌Gemini与OpenAI在工业级研究报告生成领域的竞争,进一步凸显了该基准在衡量模型事实一致性、分析深度等核心指标上的战略价值。

相关研究论文

- 1DeepResearch Bench: A Comprehensive Benchmark for Deep Research Agents中国科学院大学, 北京, 中国 · 2025年

以上内容由AI搜集并总结生成