MetaVQA

收藏arXiv2025-01-16 更新2025-01-18 收录

下载链接:

https://metadriverse.github.io/metavqa

下载链接

链接失效反馈官方服务:

资源简介:

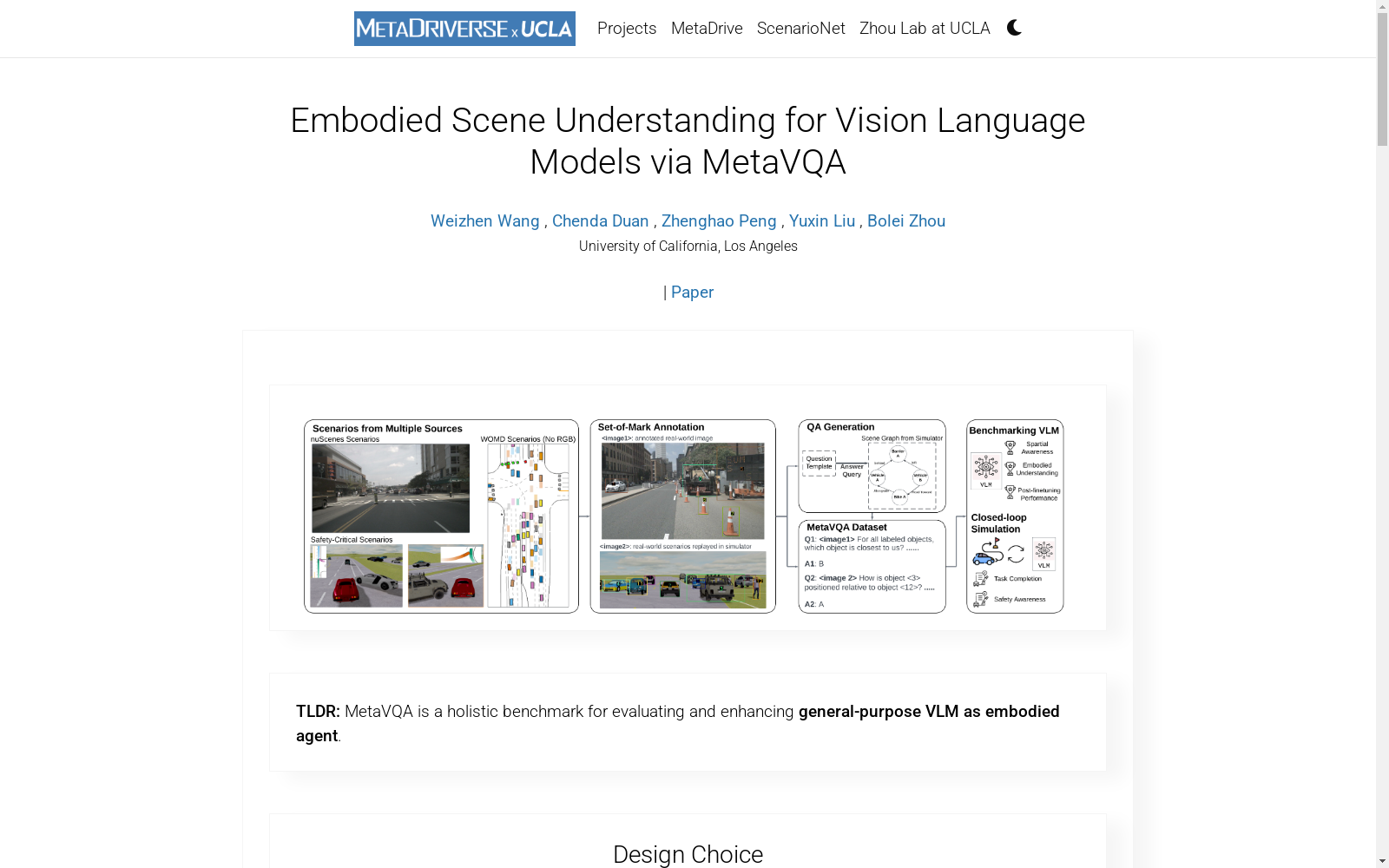

MetaVQA数据集由加利福尼亚大学洛杉矶分校的研究团队创建,旨在评估和增强视觉语言模型(VLMs)在空间推理和场景理解方面的能力。该数据集结合了nuScenes和Waymo数据集中的真实世界交通场景,利用Set-of-Mark提示和自上而下的视图注释,自动生成大量的问题-答案对。数据集包含丰富的对象中心和上下文丰富的指令,确保了对多样化交通场景的覆盖。通过MetaDrive模拟器,数据集还生成了安全关键的驾驶场景,用于闭环模拟评估。MetaVQA数据集的应用领域包括自动驾驶和仓库机器人等,旨在解决VLMs在安全关键模拟中的空间推理和场景理解问题,显著提升了模型的安全意识和决策能力。

The MetaVQA dataset was developed by a research team at the University of California, Los Angeles, with the goal of evaluating and enhancing the spatial reasoning and scene understanding capabilities of Vision-Language Models (VLMs). This dataset integrates real-world traffic scenarios from the nuScenes and Waymo datasets, and automatically generates a large volume of question-answer pairs by leveraging Set-of-Mark prompts and top-down view annotations. The dataset includes abundant object-centric and context-rich instructions, ensuring comprehensive coverage of diverse traffic scenes. Via the MetaDrive simulator, the dataset also produces safety-critical driving scenarios for closed-loop simulation-based evaluation. The application areas of the MetaVQA dataset cover autonomous driving, warehouse robotics and other fields, aiming to address the spatial reasoning and scene understanding challenges of VLMs in safety-critical simulations, and substantially improving the models' safety awareness and decision-making abilities.

提供机构:

加利福尼亚大学洛杉矶分校

创建时间:

2025-01-16

搜集汇总

数据集介绍

构建方式

MetaVQA数据集的构建基于nuScenes和Waymo数据集,通过Set-of-Mark提示技术和自上而下的视角真实标注,自动生成基于多样化真实交通场景的问答对。数据集结合了视觉问答(VQA)和闭环模拟,旨在评估和增强视觉语言模型(VLMs)的空间推理和场景动态理解能力。具体构建过程包括从nuScenes和Waymo数据集中提取场景图,并通过模拟器MetaDrive生成多样化的交通场景,确保问题具有对象中心性和丰富的上下文信息。

特点

MetaVQA数据集的特点在于其广泛覆盖了真实和模拟的交通场景,确保了数据集的多样性和复杂性。数据集中的问答对不仅涵盖了空间关系推理,还涉及场景动态理解,特别是安全关键场景下的决策能力。此外,MetaVQA通过Set-of-Mark提示技术,提供了清晰的视觉标注,使得模型能够更好地进行视觉定位和对象关联。数据集还支持从模拟到真实世界的知识迁移,验证了模型在真实场景中的泛化能力。

使用方法

MetaVQA数据集的使用方法主要包括两个方面:首先,通过视觉问答任务对视觉语言模型进行零样本评估,验证其在空间推理和场景理解方面的能力;其次,通过在闭环模拟环境中进行安全关键场景的驾驶任务,进一步评估模型的决策能力和安全性。数据集还支持模型的微调,通过大规模的高质量问答对,显著提升模型在空间推理和场景理解方面的表现。此外,MetaVQA数据集的使用还支持从模拟数据到真实数据的知识迁移,验证了模型在真实世界中的泛化能力。

背景与挑战

背景概述

MetaVQA数据集由加州大学洛杉矶分校的研究团队于2025年提出,旨在解决视觉语言模型(VLMs)在空间推理和场景理解方面的不足。该数据集通过视觉问答(VQA)和闭环模拟,评估和增强VLMs在真实交通场景中的空间关系理解和顺序决策能力。MetaVQA结合了nuScenes和Waymo数据集中的真实交通场景,自动生成大量的问题-答案对,确保问题具有对象中心和上下文丰富的特性。实验表明,使用MetaVQA微调的VLMs在安全关键模拟中的空间推理和场景理解能力显著提升,不仅在VQA准确性上有所提高,还在安全驾驶操作中表现出色。此外,MetaVQA还展示了从模拟到真实世界的强迁移性。

当前挑战

MetaVQA面临的挑战主要包括两个方面:首先,现有的VQA基准在描述场景和对象时存在不一致性,导致通用VLMs在零样本评估中表现不佳。其次,构建MetaVQA数据集时,如何确保问题的多样性和复杂性,尤其是在安全关键场景中的闭环评估,是一个巨大的挑战。此外,MetaVQA还需要解决如何在模拟环境中生成高质量的合成数据,并确保这些数据能够有效迁移到真实世界的任务中。这些挑战不仅涉及数据集的构建,还涉及如何通过闭环模拟验证VLMs在实际驾驶任务中的表现。

常用场景

经典使用场景

MetaVQA数据集主要用于评估和增强视觉语言模型(VLMs)在自动驾驶和机器人等领域的空间推理和场景理解能力。通过视觉问答(VQA)任务和闭环模拟,MetaVQA能够生成基于真实世界交通场景的多样化问题-答案对,帮助模型在复杂环境中做出更准确的决策。

衍生相关工作

MetaVQA的推出催生了一系列相关研究工作,特别是在自动驾驶和视觉语言模型领域。例如,DriveVLM和DriveLM等研究利用MetaVQA的数据集进行模型微调,显著提升了模型在闭环模拟中的表现。此外,MetaVQA还为其他研究提供了标准化的评估基准,推动了视觉语言模型在安全关键场景中的应用。

数据集最近研究

最新研究方向

MetaVQA数据集在视觉语言模型(VLMs)的具身场景理解领域展现了显著的前沿研究方向。该数据集通过视觉问答(VQA)和闭环模拟,评估和增强VLMs在空间推理和顺序决策能力方面的表现。MetaVQA结合了nuScenes和Waymo数据集中的真实交通场景,自动生成大量的问题-答案对,确保问题具有对象中心和上下文丰富的特性。实验表明,使用MetaVQA微调的VLMs在安全关键模拟中的空间推理和场景理解能力显著提升,不仅提高了VQA的准确率,还展现了安全意识的驾驶行为。此外,MetaVQA还展示了从模拟到现实世界的强迁移性,验证了其在自动驾驶和机器人等领域的广泛应用潜力。

相关研究论文

- 1Embodied Scene Understanding for Vision Language Models via MetaVQA加利福尼亚大学洛杉矶分校 · 2025年

以上内容由遇见数据集搜集并总结生成