MMLU

收藏arXiv2025-02-08 收录

下载链接:

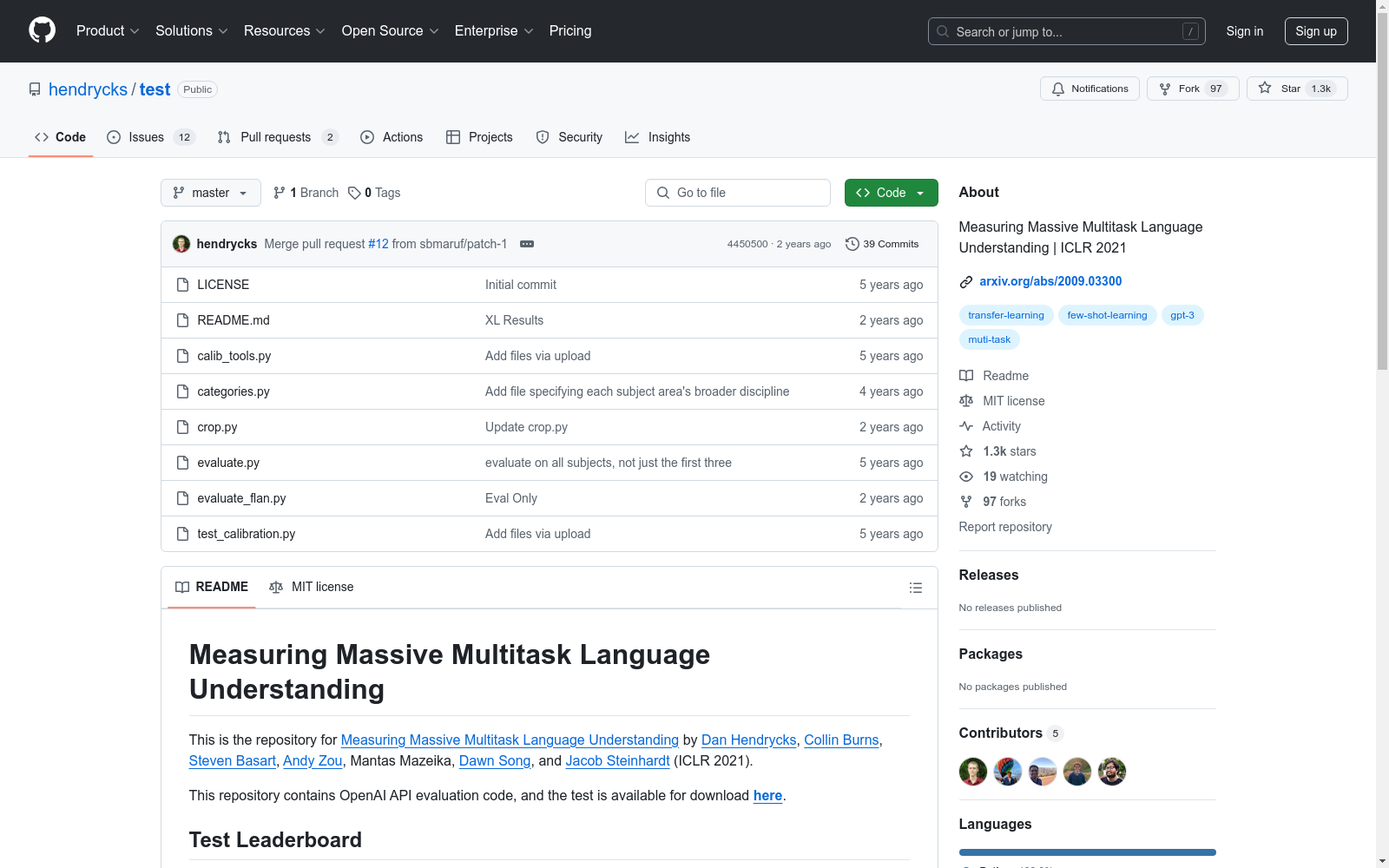

https://github.com/hendrycks/test

下载链接

链接失效反馈资源简介:

该数据集是一个用于评估语言模型在不同任务上性能的基准。它也被用来对在多个任务上进行了微调的模型进行评估。

The MMLU dataset encompasses 15,908 English multiple-choice questions, providing a benchmark for evaluating model proficiency in knowledge through zero-shot and few-shot assessments. This benchmark spans 57 disciplines, including STEM (Science, Technology, Engineering, and Mathematics), humanities, and social sciences, with difficulty levels ranging from elementary to advanced. These questions were manually collected by students from various free online resources, including practice problems from different disciplines. The evaluation is conducted using a code-based assessment method.

提供机构:

HELM

原始信息汇总

数据集概述

基本信息

- 数据集名称:Measuring Massive Multitask Language Understanding

- 发布年份:2021年

- 发布会议:International Conference on Learning Representations (ICLR)

- 数据集作者:Dan Hendrycks, Collin Burns, Steven Basart, Andy Zou, Mantas Mazeika, Dawn Song, Jacob Steinhardt

- 数据集论文:Measuring Massive Multitask Language Understanding

- 数据集下载地址:https://people.eecs.berkeley.edu/~hendrycks/data.tar

数据集内容

- 用途:用于评估大规模多任务语言理解能力。

- 包含内容:OpenAI API评估代码及测试数据。

测试结果

- 测试模型及结果:

| 模型 | 作者 | 人文科学 | 社会科学 | STEM | 其他 | 平均分 |

|---|---|---|---|---|---|---|

| Chinchilla (70B, few-shot) | Hoffmann et al., 2022 | 63.6 | 79.3 | 54.9 | 73.9 | 67.5 |

| Gopher (280B, few-shot) | Rae et al., 2021 | 56.2 | 71.9 | 47.4 | 66.1 | 60.0 |

| GPT-3 (175B, fine-tuned) | Brown et al., 2020 | 52.5 | 63.9 | 41.4 | 57.9 | 53.9 |

| flan-T5-xl | Chung et al., 2022 | 46.3 | 57.7 | 39.0 | 55.1 | 49.3 |

| UnifiedQA | Khashabi et al., 2020 | 45.6 | 56.6 | 40.2 | 54.6 | 48.9 |

| GPT-3 (175B, few-shot) | Brown et al., 2020 | 40.8 | 50.4 | 36.7 | 48.8 | 43.9 |

| GPT-3 (6.7B, fine-tuned) | Brown et al., 2020 | 42.1 | 49.2 | 35.1 | 46.9 | 43.2 |

| flan-T5-large | Chung et al., 2022 | 39.1 | 49.1 | 33.2 | 47.4 | 41.9 |

| flan-T5-base | Chung et al., 2022 | 34.0 | 38.1 | 27.6 | 37.0 | 34.2 |

| GPT-2 | Radford et al., 2019 | 32.8 | 33.3 | 30.2 | 33.1 | 32.4 |

| flan-T5-small | Chung et al., 2022 | 29.9 | 30.9 | 27.5 | 29.7 | 29.5 |

| Random Baseline | N/A | 25.0 | 25.0 | 25.0 | 25.0 | 25.0 |

引用信息

-

主数据集引用: bibtex @article{hendryckstest2021, title={Measuring Massive Multitask Language Understanding}, author={Dan Hendrycks and Collin Burns and Steven Basart and Andy Zou and Mantas Mazeika and Dawn Song and Jacob Steinhardt}, journal={Proceedings of the International Conference on Learning Representations (ICLR)}, year={2021} }

-

相关数据集引用: bibtex @article{hendrycks2021ethics, title={Aligning AI With Shared Human Values}, author={Dan Hendrycks and Collin Burns and Steven Basart and Andrew Critch and Jerry Li and Dawn Song and Jacob Steinhardt}, journal={Proceedings of the International Conference on Learning Representations (ICLR)}, year={2021} }

搜集汇总

数据集介绍

构建方式

MMLU数据集旨在评估大规模多任务语言理解能力,其构建过程涵盖了广泛的学科领域,包括人文学科、社会科学、STEM(科学、技术、工程和数学)以及其他领域。数据集的构建基于对现有学术资源和公开测试题的整合与扩展,确保了内容的多样性和深度。通过精心设计的测试题目,数据集能够全面衡量模型在不同知识领域的理解和推理能力。

特点

MMLU数据集的特点在于其广泛覆盖的学科领域和多样化的任务类型。数据集不仅包含传统的语言理解任务,还涉及跨学科的知识整合与推理,能够有效评估模型在复杂情境下的表现。此外,数据集的测试题目设计严谨,既包含基础知识的考察,也包含高阶思维能力的挑战,为模型的多任务学习能力提供了全面的评估基准。

使用方法

MMLU数据集的使用方法主要包括下载测试数据并利用提供的OpenAI API进行评估。用户可以通过运行测试代码,将模型的表现与公开的排行榜进行对比,从而了解模型在不同任务中的表现。此外,用户还可以提交自己的模型结果以更新排行榜,或通过GitHub提交拉取请求以参与数据集的进一步开发与优化。

背景与挑战

背景概述

MMLU(Measuring Massive Multitask Language Understanding)数据集由Dan Hendrycks、Collin Burns等研究人员于2021年提出,旨在评估大规模多任务语言理解能力。该数据集涵盖了人文、社会科学、STEM(科学、技术、工程、数学)及其他领域的广泛知识,旨在测试模型在不同学科中的综合理解能力。其研究背景源于对通用人工智能(AGI)的追求,特别是在多任务学习和跨领域知识迁移方面的挑战。MMLU的提出为语言模型的评估提供了新的基准,推动了自然语言处理领域的发展,并在ICLR 2021会议上发表,成为该领域的重要参考。

当前挑战

MMLU数据集面临的挑战主要体现在两个方面。首先,其核心目标是解决多任务语言理解的复杂性,要求模型在多个学科领域中具备广泛的知识覆盖和深度理解能力。然而,不同学科之间的知识差异性和任务多样性使得模型难以在单一框架下实现高效的多任务学习。其次,在数据集的构建过程中,研究人员需要确保数据的多样性和平衡性,涵盖广泛的学科领域,同时避免数据偏差。此外,评估模型的性能时,如何设计公平且全面的测试指标也是一个重要挑战。这些挑战不仅反映了多任务学习的复杂性,也为未来研究提供了重要的方向。

常用场景

经典使用场景

MMLU数据集广泛应用于评估大规模多任务语言理解模型的性能。通过涵盖人文学科、社会科学、STEM和其他领域的多样化任务,该数据集为研究人员提供了一个全面的基准,用于测试模型在不同知识领域的泛化能力。特别是在自然语言处理领域,MMLU被广泛用于评估模型在复杂任务中的表现,如阅读理解、知识推理和跨领域迁移学习。

实际应用

在实际应用中,MMLU数据集为开发更智能的语言模型提供了重要支持。例如,在教育领域,基于MMLU评估的模型可以用于开发智能辅导系统,帮助学生跨学科学习。在商业领域,该数据集的应用有助于构建更强大的客服系统,能够处理多领域的复杂查询。此外,MMLU还为法律、医疗等专业领域的语言模型开发提供了基准测试。

衍生相关工作

MMLU数据集自发布以来,已衍生出多项经典研究工作。例如,基于MMLU的评估结果,研究人员提出了改进的多任务学习架构,如Chinchilla和Gopher模型。这些模型在MMLU的基准测试中表现出色,推动了大规模语言模型的进一步发展。此外,MMLU还为其他多任务学习数据集的设计提供了参考,如ETHICS数据集,进一步扩展了多任务学习的研究范围。

以上内容由遇见数据集搜集并总结生成