High-quality-Chinese-Q-A-dataset

收藏github2023-07-31 更新2024-05-31 收录

下载链接:

https://github.com/UnstoppableCurry/High-quality-Chinese-Q-A-dataset

下载链接

链接失效反馈资源简介:

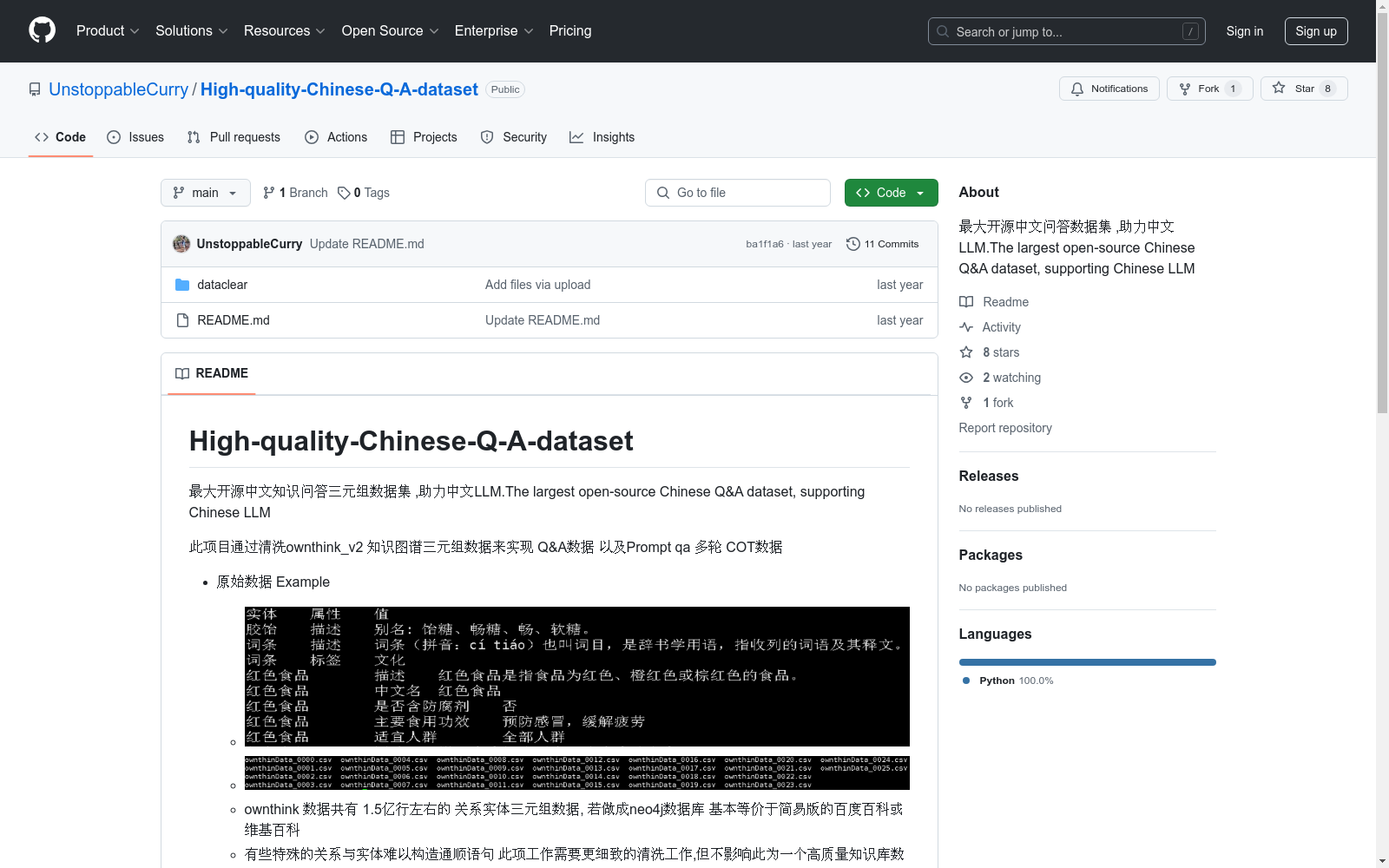

最大开源中文知识问答三元组数据集,通过清洗ownthink_v2知识图谱三元组数据来实现Q&A数据以及Prompt qa多轮COT数据,助力中文LLM。

The largest open-source Chinese knowledge question-answering triple dataset, achieved by cleaning the ownthink_v2 knowledge graph triple data to generate Q&A data and multi-turn COT (Chain-of-Thought) data for Prompt qa, facilitating the development of Chinese LLMs (Large Language Models).

创建时间:

2023-04-06

原始信息汇总

数据集概述

数据集名称

- High-quality-Chinese-Q-A-dataset

数据集描述

- 该数据集是通过清洗ownthink_v2知识图谱三元组数据来构建的中文问答数据集,支持中文LLM。

- 原始数据包含约1.5亿行关系实体三元组,相当于简易版的百度百科或维基百科。

- 数据集包括Q&A数据和Prompt qa多轮COT数据。

数据集内容

-

原始数据

- 包含关系实体三元组数据。

-

Q&A数据

- 通过拼接三元组数据构造QA数据,并将数据shuffle。

- 下载链接:链接,提取码:kbge。

-

Q&A & Cot Prompt 数据

数据集应用

- 用于微调模型,如使用rwkv 1B5微调少量Cot Q&A数据,展示良好的zeroshot能力。

搜集汇总

数据集介绍

构建方式

该数据集通过清洗ownthink_v2知识图谱三元组数据构建而成,原始数据包含约1.5亿行的关系实体三元组。构建过程中,首先将三元组数据拼接成问答对,随后进行数据洗牌以增强多样性。此外,还生成了多轮COT(Chain of Thought)Prompt数据,通过多次洗牌操作,确保数据的高质量和多样性。

使用方法

用户可通过提供的下载链接获取数据集,链接包括单轮和多轮洗牌后的数据。数据集可用于训练和微调中文语言模型,特别是对于需要高质量问答数据和多轮推理能力的应用场景。使用时,建议结合具体的模型架构和训练策略,以最大化数据集的效用。

背景与挑战

背景概述

在自然语言处理领域,高质量的中文问答数据集对于训练和评估中文语言模型(LLM)至关重要。High-quality-Chinese-Q-A-dataset 数据集应运而生,旨在通过清洗和重组 ownthink_v2 知识图谱的三元组数据,构建一个大规模、高质量的中文问答数据集。该数据集由匿名研究人员或团队创建,其核心研究问题是如何有效地从海量三元组数据中提取和构建高质量的问答对,以支持中文LLM的训练和应用。此数据集不仅丰富了中文自然语言处理的数据资源,还为相关研究提供了宝贵的实验材料,推动了中文LLM的发展。

当前挑战

尽管High-quality-Chinese-Q-A-dataset 数据集在构建高质量中文问答数据方面取得了显著进展,但仍面临若干挑战。首先,从原始的三元组数据中提取和构造通顺的问答对是一个复杂的过程,需要细致的数据清洗和处理。其次,某些特殊的关系和实体在构造问答对时可能难以形成自然流畅的语句,这要求更高的数据处理技术和策略。此外,数据集的构建过程中还需考虑如何确保数据的多样性和覆盖面,以避免模型训练中的偏差。最后,数据集的更新和维护也是一个持续的挑战,以确保其始终保持高质量和时效性。

常用场景

经典使用场景

在自然语言处理领域,High-quality-Chinese-Q-A-dataset 数据集的经典使用场景主要体现在中文语言模型的训练与优化。通过该数据集,研究者能够构建高质量的中文问答系统,提升模型在多轮对话中的表现。此外,该数据集还可用于开发智能客服系统,增强其在复杂问题解答中的能力。

解决学术问题

High-quality-Chinese-Q-A-dataset 数据集解决了中文自然语言处理中高质量问答数据稀缺的问题。其丰富的三元组数据和多轮对话样本,为研究者提供了宝贵的资源,有助于推动中文语言模型的发展。该数据集的引入,不仅提升了模型的性能,还为相关领域的学术研究提供了新的方向和可能性。

实际应用

在实际应用中,High-quality-Chinese-Q-A-dataset 数据集被广泛用于构建智能客服系统、在线教育平台以及知识问答社区。通过利用该数据集,这些应用能够提供更准确、更智能的问答服务,显著提升用户体验。此外,该数据集还可用于企业内部的知识管理系统,提高信息检索和知识共享的效率。

数据集最近研究

最新研究方向

在自然语言处理领域,高质量中文问答数据集(High-quality-Chinese-Q-A-dataset)的最新研究方向主要集中在提升大型语言模型(LLM)的中文理解和生成能力。该数据集通过清洗和重组ownthink_v2知识图谱的三元组数据,构建了丰富的问答对和多轮对话数据,为中文LLM的训练提供了坚实的基础。当前研究热点包括利用此数据集进行模型微调,以增强模型的零样本学习能力,特别是在处理复杂问题和多轮对话时表现出的优越性。此外,该数据集的构建和应用也推动了中文知识图谱的进一步完善和应用,为中文信息处理技术的发展提供了新的动力。

以上内容由遇见数据集搜集并总结生成