IRMAS

收藏github2023-12-12 更新2024-05-31 收录

下载链接:

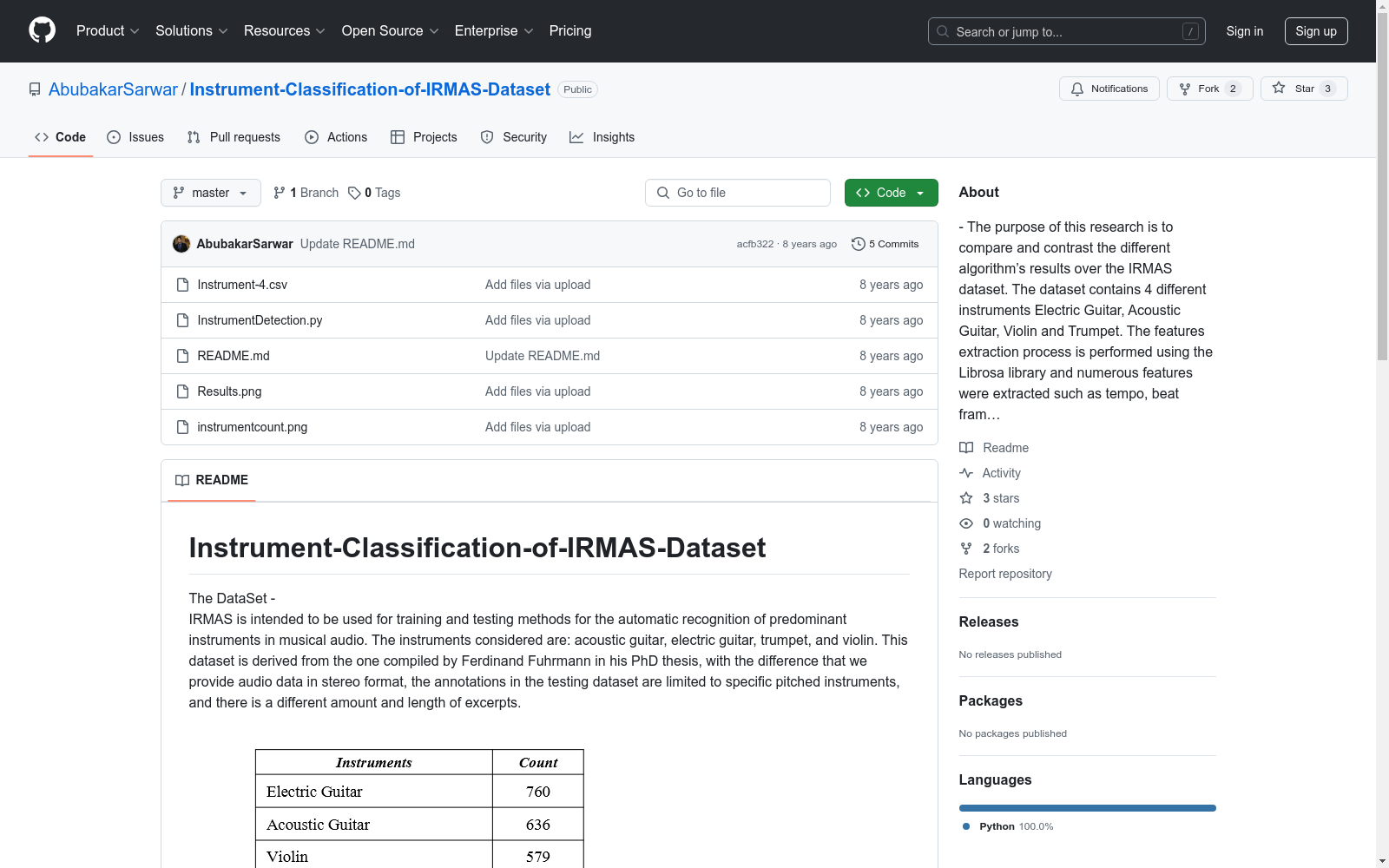

https://github.com/AbubakarSarwar/Instrument-Classification-of-IRMAS-Dataset

下载链接

链接失效反馈资源简介:

IRMAS数据集旨在用于训练和测试音乐音频中主要乐器的自动识别方法。考虑的乐器包括原声吉他、电吉他、小号和提琴。该数据集源自Ferdinand Fuhrmann在其博士论文中编译的数据集,区别在于我们提供立体声音频数据,测试数据集中的注释仅限于特定的有音高乐器,并且摘录的数量和长度有所不同。

The IRMAS dataset is designed for training and testing automatic recognition methods of primary instruments in musical audio. The instruments considered include acoustic guitar, electric guitar, trumpet, and violin. This dataset originates from the dataset compiled by Ferdinand Fuhrmann in his doctoral thesis, with the distinction that we provide stereo audio data, the annotations in the test dataset are limited to specific pitched instruments, and the number and length of excerpts vary.

创建时间:

2017-05-10

原始信息汇总

数据集概述

数据集名称

- IRMAS

数据集用途

- 用于训练和测试自动识别音乐音频中主要乐器的方法。

包含的乐器类型

-

- 原声吉他

-

- 电吉他

-

- 小号

-

- 小提琴

数据集特点

- 提供立体声音频数据。

- 测试集中的注释仅限于特定的有调乐器。

- 包含不同数量和长度的摘录。

提取的特征

-

- 节拍框架

-

- 频谱中心

-

- 带宽

-

- 滚降

-

- 零交叉率

-

- 均方根能量

-

- 速度

-

- MFCC(20个系数)

特征处理

- 上述8个特征及其均值、总和、方差和标准差,加上MFCC的20个系数,总计98个特征。

特征选择方法

- 使用L1基础的特征选择方法,将98个特征减少到63个。

分类方法

-

- K折交叉验证

-

- 留一交叉验证

-

- 保留方法

测试的算法

-

- 装袋

-

- 随机森林

-

- 决策树分类器

-

- 朴素贝叶斯

-

- K近邻

结果

- 结果图表未在此文本中详细描述。

AI搜集汇总

数据集介绍

构建方式

IRMAS数据集旨在用于训练和测试音乐音频中主要乐器的自动识别方法。该数据集源自Ferdinand Fuhrmann在其博士论文中汇编的数据集,不同之处在于我们提供了立体声格式的音频数据,测试数据集中的注释仅限于特定音高乐器,并且片段的数量和长度有所不同。通过使用Python库LibROSA提取了包括节拍帧、频谱质心、带宽、滚降、零交叉率、均方根能量、节奏和MFCC等8种特征,并进一步计算了这些特征的均值、总和、方差和标准差,最终形成了98个特征。

特点

IRMAS数据集的特点在于其专注于音乐音频中主要乐器的识别,特别是针对原声吉他、电吉他、小号和提琴等乐器。数据集通过LibROSA库提取了丰富的音频特征,包括节拍帧、频谱质心、带宽等,并通过L1基础特征选择方法将特征维度从98个减少到63个,显著降低了特征向量的尺寸。此外,数据集采用了三种不同的分类算法应用方法,包括K折交叉验证、留一法交叉验证和保留法,以寻找最佳的乐器分类模型。

使用方法

IRMAS数据集的使用方法涉及多种分类算法的应用和比较。研究人员可以运行五种不同的分类器,包括Bagging、随机森林、决策树分类器、朴素贝叶斯和K近邻算法,并通过K折交叉验证、留一法交叉验证和保留法三种方法进行模型训练和测试。通过这些方法,用户可以比较不同算法和方法的性能,最终选择最佳的乐器分类模型。数据集的使用不仅限于学术研究,还可应用于音乐信息检索系统的开发和优化。

背景与挑战

背景概述

IRMAS数据集是一个专门用于音乐音频中主要乐器自动识别的研究工具,旨在训练和测试相关算法。该数据集由Ferdinand Fuhrmann在其博士论文中编译的数据集衍生而来,主要关注四种乐器:原声吉他、电吉他、小号和提琴。IRMAS数据集提供了立体声格式的音频数据,并在测试数据集中对特定音高乐器进行了标注。该数据集的创建为音乐信息检索领域提供了重要的实验基础,推动了音频信号处理与机器学习在音乐分析中的应用。

当前挑战

IRMAS数据集在解决音乐乐器分类问题时面临多重挑战。首先,音频信号的高维度和复杂性使得特征提取和选择成为关键问题,尽管使用了LibROSA库提取了包括MFCC在内的多种特征,但仍需通过L1特征选择方法进一步降维。其次,乐器声音的多样性和重叠性增加了分类难度,尤其是在多乐器混合的音频中识别主导乐器。此外,数据集构建过程中,音频片段的长度和数量差异也对模型的泛化能力提出了挑战。这些挑战促使研究者不断优化分类算法,以提升模型的准确性和鲁棒性。

常用场景

经典使用场景

在音乐信息检索领域,IRMAS数据集被广泛用于训练和测试自动识别音乐音频中主要乐器的算法。该数据集特别关注了四种乐器:原声吉他、电吉他、小号和提琴。通过提供立体声音频数据以及针对特定音高乐器的注释,IRMAS为研究者提供了一个标准化的平台,用于开发和评估乐器分类模型。

衍生相关工作

基于IRMAS数据集,许多经典研究工作得以展开。例如,研究者利用该数据集开发了基于随机森林和K近邻算法的乐器分类模型,显著提升了分类准确率。此外,IRMAS还启发了对音乐特征提取方法的深入研究,如基于MFCC(梅尔频率倒谱系数)的特征优化。这些工作不仅推动了音乐信息检索领域的发展,也为其他音频分析任务提供了重要参考。

数据集最近研究

最新研究方向

在音乐信息检索领域,IRMAS数据集的最新研究方向聚焦于利用深度学习技术提升乐器分类的准确性和效率。近年来,随着卷积神经网络(CNN)和循环神经网络(RNN)在音频处理中的广泛应用,研究者们开始探索这些模型在IRMAS数据集上的表现。通过结合时间序列分析和频谱特征提取,研究者能够更精确地识别音频中的主导乐器。此外,迁移学习和数据增强技术也被引入,以应对数据量有限和类别不平衡的问题。这些研究不仅推动了乐器分类技术的发展,还为音乐推荐系统和自动音乐生成等应用提供了新的可能性。

以上内容由AI搜集并总结生成