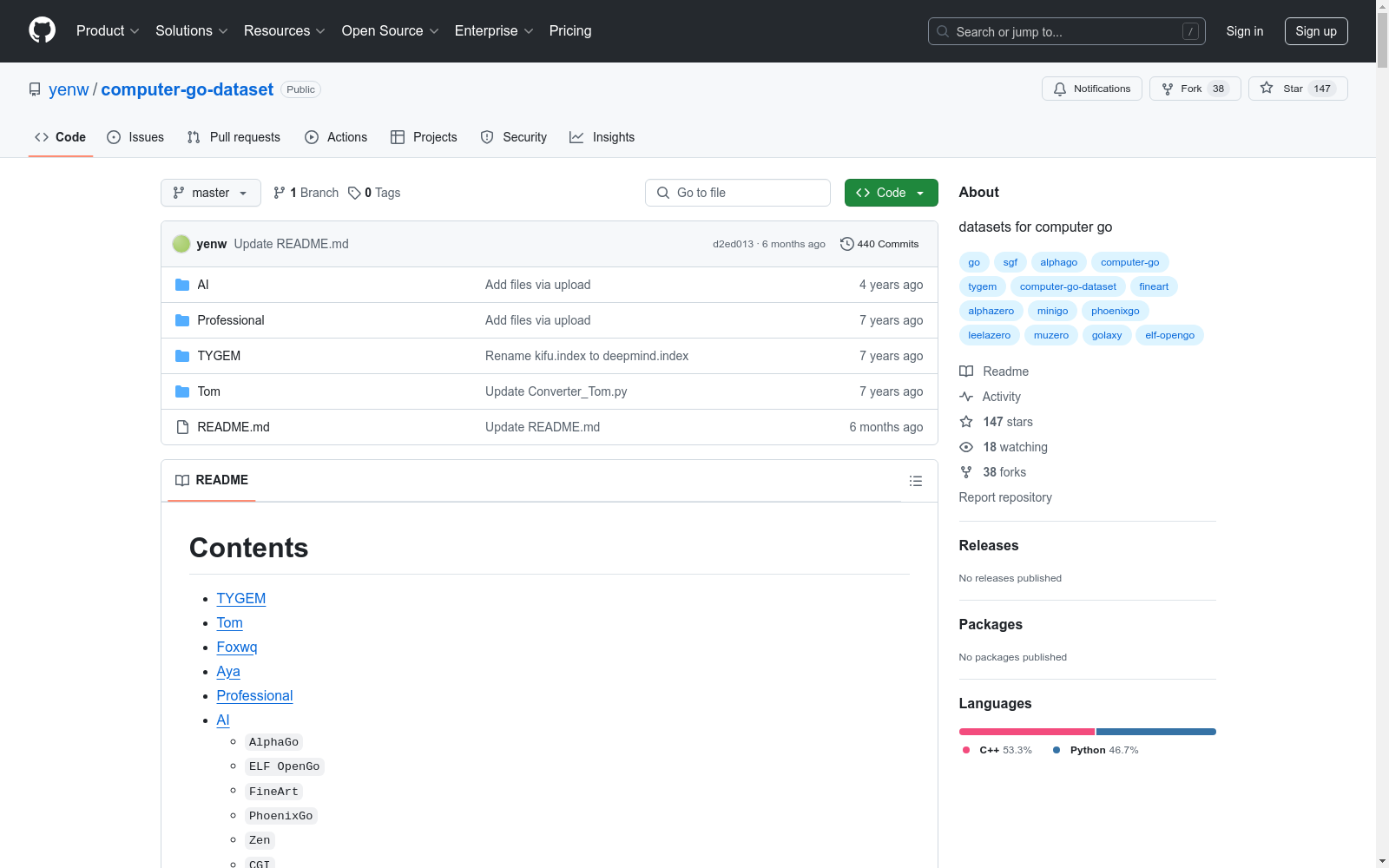

computer-go-dataset|围棋AI数据集|数据集数据集

收藏数据集概述

1. TYGEM 数据集

- 时间范围: 2005.11.02 - 2016.12.31

- 游戏数量: 1,516,031 场

- 格式: 包含 id, date, white, black, result 等字段

- 转换工具: 提供转换为 SGF 的工具和使用示例

2. TOM 数据集

- 时间范围: 2003.09.25 - 2011.12.28

- 游戏数量: 50,956 场

- 格式: 包含 id, date, white, black, result 等字段

- 转换工具: 提供转换为 SGF 的工具和使用示例

3. Foxwq 数据集

- 时间范围: 2013.07.09 - 2019.10.17

- 游戏数量: 166,184 场

- Github 链接: 18k-9d

4. Ayas selfplay games for training value network

- 棋盘大小: 19x19, 13x13, 9x9

- 链接: Ayas selfplay games

5. Professional 数据集

- 时间范围: 1940.01.01 - 2017.01.09

- 游戏数量: 73,522 场

- 格式: 文本格式,包含多个 SGF 文件

- SGF 标签: 包含 GM, FF, SZ 等标签

6. AI 数据集

- 包含多个 AI 系统: AlphaGo, ELF OpenGo, FineArt, PhoenixGo 等

- 详细记录了各个 AI 系统的对局情况和比赛结果

7. CGOS 数据集

- 包含多个棋盘大小: 19x19, 13x13, 9x9

- 链接: CGOS 数据集

8. Leela Zero 数据集

- 包含自对局和比赛数据: Self-Play, Match

- 训练数据: Training Data

9. KGS 数据集

- 链接: Kifu

10. Minigo 数据集

- 包含多个资源: CloudyGo, Github, Youtube

- Google Cloud 存储: 包含训练数据和模型文件

11. NNGS 数据集

- 包含 SGF 文件数量: 435,495

- 时间范围: 1995.07 - 2005.05

- Github 链接: NNGS_SGF_Archive

12. ELF OpenGo 数据集

- 包含训练数据和分析: v2-training-run, Analysis

13. KataGo 数据集

- 包含分布式训练数据: KataGo Distributed Training

- 链接: Home Page, dataset

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

Materials Project

材料项目是一组标有不同属性的化合物。数据集链接: MP 2018.6.1(69,239 个材料) MP 2019.4.1(133,420 个材料)

OpenDataLab 收录

Fruits-360

一个高质量的水果图像数据集,包含多种水果的图像,如苹果、香蕉、樱桃等,总计42345张图片,分为训练集和验证集,共有64个水果类别。

github 收录

CatMeows

该数据集包含440个声音样本,由21只属于两个品种(缅因州库恩猫和欧洲短毛猫)的猫在三种不同情境下发出的喵声组成。这些情境包括刷毛、在陌生环境中隔离和等待食物。每个声音文件都遵循特定的命名约定,包含猫的唯一ID、品种、性别、猫主人的唯一ID、录音场次和发声计数。此外,还有一个额外的zip文件,包含被排除的录音(非喵声)和未剪辑的连续发声序列。

huggingface 收录

Traditional-Chinese-Medicine-Dataset-SFT

该数据集是一个高质量的中医数据集,主要由非网络来源的内部数据构成,包含约1GB的中医各个领域临床案例、名家典籍、医学百科、名词解释等优质内容。数据集99%为简体中文内容,质量优异,信息密度可观。数据集适用于预训练或继续预训练用途,未来将继续发布针对SFT/IFT的多轮对话和问答数据集。数据集可以独立使用,但建议先使用配套的预训练数据集对模型进行继续预训练后,再使用该数据集进行进一步的指令微调。数据集还包含一定比例的中文常识、中文多轮对话数据以及古文/文言文<->现代文翻译数据,以避免灾难性遗忘并加强模型表现。

huggingface 收录