【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

PLAWBENCH

收藏arXiv2026-01-23 更新2026-01-27 收录

下载链接:

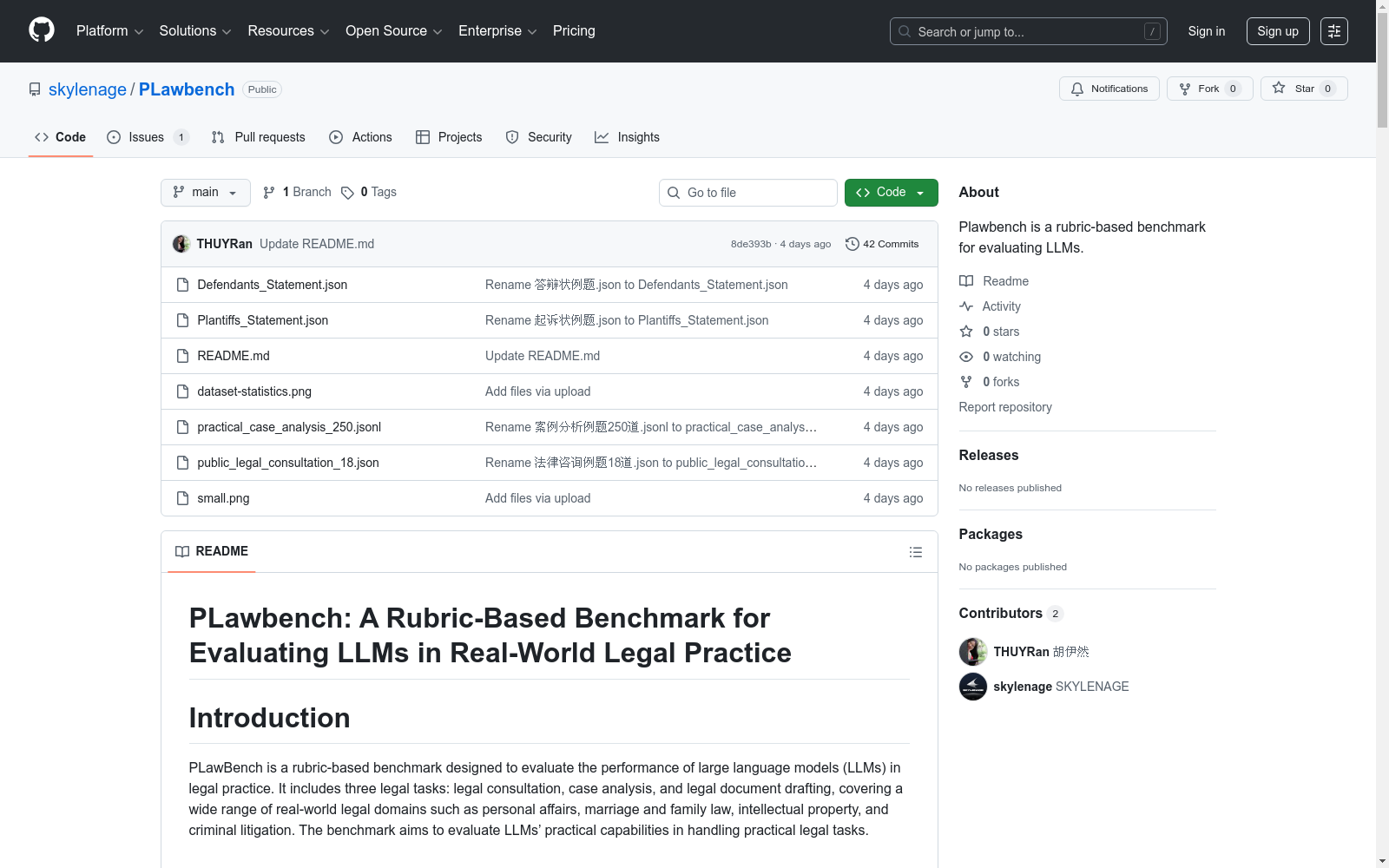

https://github.com/skylenage/PLawbench

下载链接

链接失效反馈官方服务:

资源简介:

PLAWBENCH是由阿里巴巴集团等机构联合构建的实用法律评测基准,旨在模拟真实法律工作流程中的复杂性和模糊性。该数据集包含850个问题,覆盖公共法律咨询、实际案例分析和法律文件生成三大任务类型,数据来源于多源法律数据库和专家标注,并通过细粒度评估细则(约12,500条)量化模型表现。其构建过程强调对法律推理步骤的拆解和任务特异性设计,适用于评估大语言模型在法律问题识别、事实澄清、结构化推理及专业文档生成等核心能力,为解决当前法律AI在真实场景中适应性不足的问题提供了标准化评测工具。

PLAWBENCH is a practical legal evaluation benchmark jointly constructed by Alibaba Group and other institutions. It is designed to simulate the complexity and ambiguity inherent in real-world legal work workflows. This dataset includes 850 questions covering three core task categories: public legal consultation, practical case analysis, and legal document generation. Its data is sourced from multi-source legal databases and expert annotations, and model performance is quantified using approximately 12,500 fine-grained evaluation criteria. The development process of PLAWBENCH emphasizes the decomposition of legal reasoning steps and task-specific design. It is suitable for evaluating key capabilities of Large Language Models (LLMs), such as legal problem identification, fact clarification, structured reasoning, and professional document generation, thus providing a standardized evaluation tool to address the issue of insufficient real-world adaptability of current legal AI systems.

提供机构:

阿里巴巴集团; 清华大学; 上海交通大学; 滑铁卢大学; 匹兹堡大学; 博洛尼亚大学

创建时间:

2026-01-23

原始信息汇总

PLawbench 数据集概述

数据集简介

PLawbench 是一个基于量规的基准测试,旨在评估大语言模型在法律实践中的性能。它包含三项法律任务:法律咨询、案件分析和法律文书起草,涵盖个人事务、婚姻家庭法、知识产权、刑事诉讼等多种现实法律领域。

数据集构成

数据集由以下文件组成:

- practical_case_analysis_250.jsonl:包含案件分析问题。共开源250个问题,包括问题、参考答案、评分量规和评分表。

- public_legal_consultation_18.json:包含法律咨询问题。共开源18个问题,包括咨询场景和评分量规。

- Defendants_Statement.json 和 Plantiffs_Statement.json:分别为起草答辩状和起诉书的法律文书撰写任务。共开源12个问题,包括撰写场景和评分量规。

任务描述

- 公共法律咨询任务:模拟律师与客户之间的互动,测试模型能否正确理解用户的法律需求,并识别和引出当事人未披露的关键事实。

- 案件分析任务:每个案例结构分为结论、法律事实、推理和法律条文四部分,并为每个部分设计了专门的量规。对于选定的问题,进一步指定了特定的法律推理路径,以评估模型在现实案例中进行结构化、合理法律推理的能力。

- 法律文书起草任务:要求模型根据提供的场景生成法律文书(如起诉状、答辩状),旨在评估模型在法律专业写作方面的熟练程度。

主要贡献

- 更真实地模拟法律实践:忠实模拟现实世界的法律实践场景,所有任务均改编自真实案例。基准测试将法律任务组织为公共法律咨询、实践案例分析和法律文书生成三个层次,反映了法律从业者的完整工作流程。

- 细粒度推理步骤:在任务设计和评估中明确纳入细粒度的法律推理步骤,以检验大语言模型能否执行多阶段法律推理。

- 任务特定量规:采用由法律专家标注的个性化、任务特定的量规进行评估,超越纯粹基于结果或形式的指标,以评估实质性的法律推理和决策过程。

模型性能排名(部分摘要)

下表展示了部分模型在基准测试中的综合与分项表现:

| 系列 | 模型 | 综合得分 | 任务2-平均 | 任务2-结论 | 任务2-事实 | 任务2-推理 | 任务2-法条 | 任务1 | 任务3-平均 | 任务3-原告 | 任务3-被告 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| GPT | GPT-5.2-1211-global | 69.67 | 66.37 | 69.93 | 88.26 | 60.38 | 48.59 | 79.57 | 68.58 | 58.25 | 63.42 |

| Claude | Claude-opus-4-5-20251101 | 66.47 | 68.00 | 69.82 | 83.61 | 65.49 | 53.61 | 68.92 | 62.27 | 56.54 | 68.01 |

| Gemini | Gemini-3.0-pro-preview | 66.35 | 64.95 | 72.03 | 77.79 | 65.00 | 46.42 | 70.17 | 66.13 | 63.84 | 68.42 |

| Qwen | Qwen3-235b-a22b-instruct-2507 | 63.08 | 65.57 | 64.34 | 91.90 | 60.07 | 42.52 | 67.79 | 55.78 | 42.04 | 69.51 |

注:

- 任务1:公共法律咨询。

- 任务2:案件分析(包含结论、事实、推理、法条四个子项)。

- 任务3:法律文书起草(包含原告、被告两个子项)。

搜集汇总

数据集介绍

构建方式

PLAWBENCH的构建植根于真实法律实践工作流,旨在弥合现有法律基准与现实法律应用之间的鸿沟。该数据集通过系统化流程从中国裁判文书网、律师事务所档案及个人咨询记录等多源法律数据中筛选出850个代表性案例,覆盖13种实际法律场景。构建过程由39位通过国家统一法律职业资格考试的专家参与,采用严格的“起草-评审-验证”工作流,确保每个案例均经过匿名化处理并嵌入现实噪声,如模糊查询、情感化叙事及关键事实省略,以模拟法律从业者面临的真实认知挑战。专家依据分层任务框架——公共法律咨询、实务案例分析与法律文书生成——进行精细化标注,平均每个实例耗时约三小时,最终形成约12,500个细粒度评分项,为评估大语言模型在法律实践中的综合能力提供了坚实的数据基础。

特点

PLAWBENCH的核心特征在于其高度仿真与细粒度评估体系。该基准模拟了法律从业者的核心工作流程,通过三大任务类别系统评估模型在识别法律问题、结构化法律推理及生成法律文书方面的能力。区别于传统基于标准化考试或简化任务的基准,PLAWBENCH刻意引入现实复杂性,例如在咨询任务中嵌入模糊查询与策略性事实隐瞒,在文书生成任务中采用客户视角的混乱叙事。尤为突出的是其基于评分的评估机制,每个问题均配有专家设计的个性化评分标准,将评估维度细化为问题与事实识别、法律推理、法律知识应用等六个统一维度,从而能够深入检验模型的法律推理链条完整性,而非仅关注表面结论的正确性。

使用方法

PLAWBENCH的使用旨在系统评估大语言模型在真实法律场景下的实践能力。研究人员或开发者可通过其提供的任务提示,引导模型依次完成公共法律咨询、实务案例分析及法律文书生成。评估时,需将模型输出与专家构建的参考答案及细粒度评分标准进行比对。为提升评估效率与一致性,该基准推荐采用经过人工专家对齐的大语言模型作为评判员,例如Gemini-3.0-Pro-Preview,依据评分标准对模型输出的结论、事实、推理过程及法律依据等维度进行逐项打分。最终通过计算评分率来量化模型性能,该指标综合反映了模型在复杂、模糊且知识密集的法律工作流中解决实际问题的能力。

背景与挑战

背景概述

PLAWBENCH作为一项专注于评估大语言模型在真实法律实践中应用能力的基准数据集,由阿里巴巴集团、清华大学、上海交通大学及滑铁卢大学等机构的联合研究团队于2026年提出。该数据集的构建源于当前法律领域人工智能评估的局限性:现有基准多依赖于高度简化或标准化的任务,难以捕捉真实法律实务中的模糊性、复杂性及深度推理需求。PLAWBENCH通过模拟法律从业者的核心工作流程,设计了公共法律咨询、实务案例分析与法律文书生成三大任务类别,涵盖850个问题及约12,500项细粒度评估指标,旨在系统检验模型在法律问题识别、结构化推理及文书生成等方面的综合能力。该数据集的推出为法律领域大语言模型的评估提供了更为贴近实际的专业标准,对推动法律人工智能向实用化、精细化发展具有显著影响。

当前挑战

PLAWBENCH所应对的核心领域挑战在于如何准确评估大语言模型在复杂、非结构化的真实法律场景中的推理与实务能力。具体而言,其需解决现有基准在任务真实性、推理建模及评估指标方面的不足:例如,模型需处理用户咨询中常见的模糊查询、情感化叙述及关键事实省略等问题,并完成从法律问题识别到多步骤逻辑推理的完整链条。在数据集构建过程中,挑战主要体现在高质量数据的采集与标注上:需从裁判文书、律所案例等多源数据中筛选并重构具有代表性的实务场景,同时由法律专家进行耗时且高成本的细粒度标注,以确保评估指标既符合法律逻辑又能覆盖多样化的风险点。此外,设计能够精准反映法律推理质量的评估体系,并使其与人类专家判断保持一致,亦是构建过程中的关键难点。

常用场景

经典使用场景

在法学与人工智能交叉领域,PLAWBENCH作为一项基于细粒度量规的基准测试,主要用于评估大语言模型在真实法律实践场景中的综合能力。该数据集通过模拟法律从业者的核心工作流程,构建了公共法律咨询、实务案例分析和法律文书生成三大任务类别,旨在系统检验模型在模糊性、复杂性及推理需求并存的现实法律环境下的表现。其经典应用场景在于为研究者和开发者提供一个贴近实际、层次分明的评估框架,用以衡量模型是否具备从含混叙述中提炼关键事实、进行结构化法律推理以及生成专业法律文本的深层能力。

衍生相关工作

PLAWBENCH的推出催生了一系列围绕法律大语言模型评估与增强的衍生研究。基于其细粒度量规和真实任务框架,后续工作可深入探索模型在法律推理链完整性、法规时效性把握以及跨法域知识迁移等方面的改进策略。例如,研究者可借鉴其任务分类与评估维度,构建针对特定法律子领域(如知识产权、金融合规)的专项基准,或开发基于量规反馈的模型微调与对齐方法。同时,该数据集也为法律多智能体系统的协同推理评估提供了基础,激励学界探索如何将单模型能力评估扩展至复杂多智能体工作流模拟,进一步推动法律人工智能向更深层次的实用化与专业化发展。

数据集最近研究

最新研究方向

随着大语言模型在法律领域的深入应用,PLAWBENCH作为基于评分标准的基准测试,其最新研究方向聚焦于模拟真实法律工作流程的细粒度评估。该研究旨在突破传统法律基准测试的局限,通过构建涵盖公共法律咨询、实务案例分析与法律文书生成的三层次任务框架,全面检验模型在模糊性、复杂性和推理需求并存的实际法律场景中的表现。前沿探索着重于将法律推理步骤显式化,并设计任务特定的评分标准,以评估模型识别法律议题、澄清关键事实、进行结构化法律推理及生成法律连贯文书的能力。这一方向与当前法律人工智能领域的热点事件——如欧盟《人工智能法案》的风险分类框架及法律风险管理实践——紧密关联,强调评估需结合具体任务、情境与利益相关者,而非依赖抽象的准确性指标。PLAWBENCH的影响在于为法律大语言模型的开发提供了更贴近实践的评估工具,揭示了当前模型在细粒度法律推理能力上的显著不足,从而推动了法律人工智能向更深层次、更专业化的方向发展。

相关研究论文

- 1PLawBench: A Rubric-Based Benchmark for Evaluating LLMs in Real-World Legal Practice阿里巴巴集团; 清华大学; 上海交通大学; 滑铁卢大学; 匹兹堡大学; 博洛尼亚大学 · 2026年

以上内容由遇见数据集搜集并总结生成