Vicuna Evaluation

收藏github2023-03-01 更新2025-02-08 收录

下载链接:

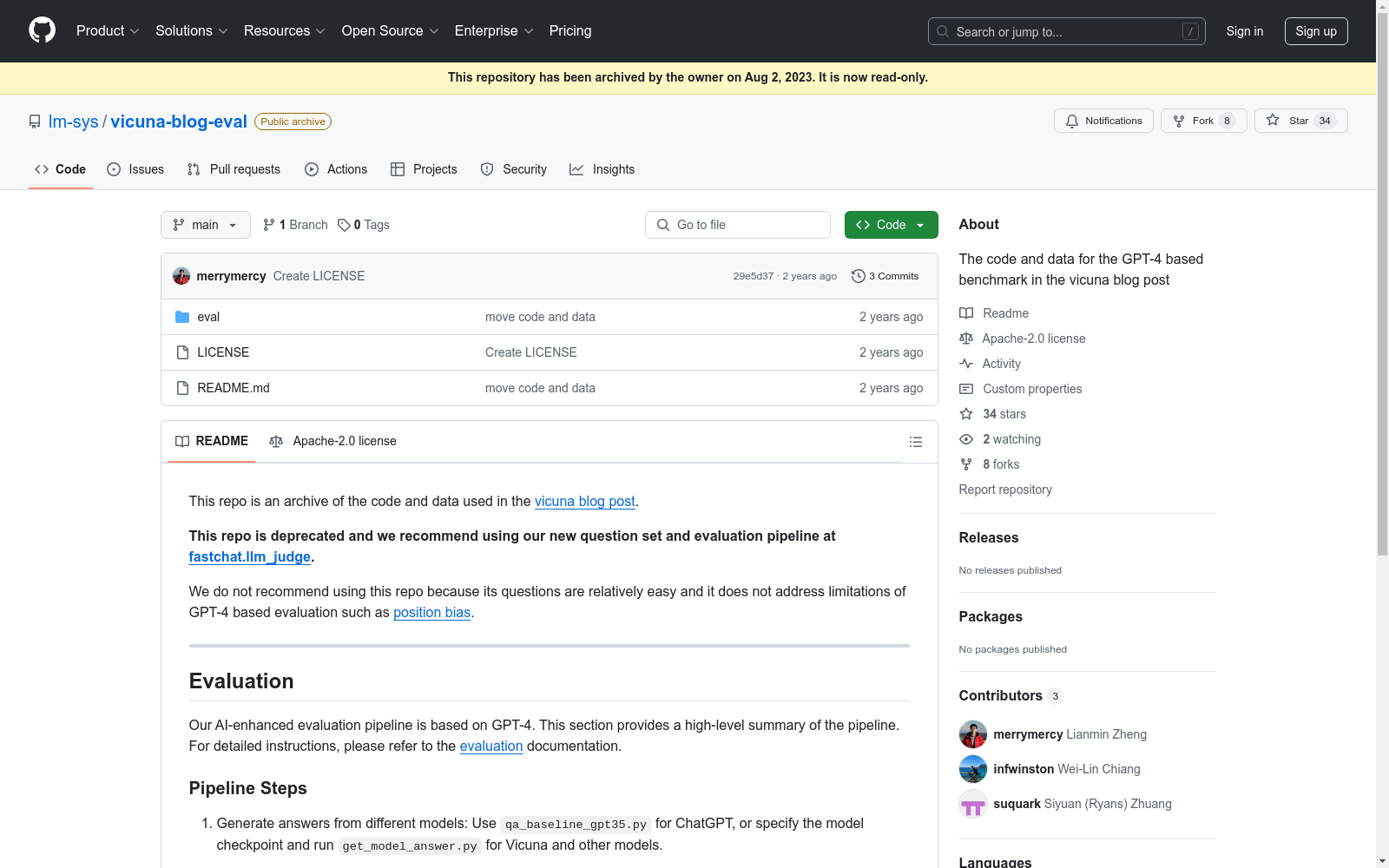

https://github.com/lm-sys/vicuna-blog-eval

下载链接

链接失效反馈资源简介:

Vicuna Evaluation数据集包含了80条英文指令,这些指令由人类创作者精心编写而成。其主要目的是对大型语言模型(LLMs)的综合能力进行初步评估,涵盖九种不同的任务,包括写作、角色扮演、常识、费米问题、反事实推理、编程、数学、通用任务和知识问答。该评估方法使用GPT-4对两个回答进行比较。

The Vicuna Evaluation dataset encompasses 80 English instructions meticulously crafted by human creators. Its primary objective is to conduct an initial assessment of the comprehensive capabilities of Large Language Models (LLMs), covering nine diverse tasks such as writing, role-playing, common sense, Fermi questions, counterfactual reasoning, programming, mathematics, general tasks, and knowledge-based questions. The evaluation methodology employs GPT-4 to compare two responses.

提供机构:

LMSYS ORG

创建时间:

2023-03-01

原始信息汇总

Vicuna博客评估数据集概述

数据集来源

- 原始博客文章:vicuna blog post

- 替代推荐:fastchat.llm_judge

数据集状态

- 已弃用(deprecated)

- 不推荐使用原因:

- 问题相对简单

- 未解决GPT-4评估的局限性(如位置偏见position bias)

评估流程

-

生成模型答案:

- ChatGPT:使用

qa_baseline_gpt35.py - Vicuna及其他模型:使用

get_model_answer.py并指定模型检查点

- ChatGPT:使用

-

生成GPT-4评价:

- 自动生成(需GPT-4 API)

- 支持手动评价

-

生成可视化数据:

- 运行

generate_webpage_data_from_table.py

- 运行

-

数据可视化:

- 本地服务静态网站(

webpage目录) - 使用命令:

python3 -m http.server

- 本地服务静态网站(

数据格式

- 使用JSON Lines格式编码

- 包含字段:

- 模型信息

- 提示

- 评价者

- 问题

- 答案

- 评价

数据贡献

- 数据访问:eval/table/

- 详细说明:evaluation文档

搜集汇总

数据集介绍

构建方式

Vicuna Evaluation数据集的构建基于GPT-4增强的评估流程,旨在通过自动化生成模型答案和评价来评估不同语言模型的性能。首先,使用特定脚本生成ChatGPT、Vicuna等模型的答案;随后,通过GPT-4自动生成评价,或手动完成此步骤;最后,生成可视化数据并通过静态网站展示评估结果。整个流程采用JSON Lines格式存储数据,确保信息的结构化和可扩展性。

特点

该数据集的特点在于其基于GPT-4的自动化评估流程,能够高效生成模型答案和评价,同时支持手动干预以应对API限制。数据集采用JSON Lines格式,包含模型、提示、评审者、问题、答案和评价等关键信息,便于用户进行定制化分析和扩展。此外,数据集提供了可视化工具,用户可通过静态网站直观查看评估结果,增强了数据的可解释性和交互性。

使用方法

使用Vicuna Evaluation数据集时,用户需按照评估流程逐步执行:首先运行脚本生成模型答案,随后调用GPT-4生成评价或手动完成此步骤,接着生成可视化数据并通过静态网站展示结果。用户可通过修改JSON Lines格式的数据文件定制评估流程,或贡献新的数据以丰富数据集内容。详细的步骤和操作指南可在相关文档中找到,确保用户能够高效地利用该数据集进行语言模型评估。

背景与挑战

背景概述

Vicuna Evaluation数据集由LMSYS机构于2023年创建,旨在评估大型语言模型(LLMs)的性能,特别是针对Vicuna模型及其与ChatGPT等模型的对比。该数据集的核心研究问题在于如何通过自动化评估流程,客观衡量不同语言模型在生成答案质量上的差异。其评估流程基于GPT-4,结合了自动生成答案、评审及数据可视化的多步骤方法。该数据集对自然语言处理领域的研究具有重要意义,尤其是在模型性能评估和对比分析方面,为研究者提供了一个标准化的评估框架。

当前挑战

Vicuna Evaluation数据集在构建和应用过程中面临多重挑战。首先,其评估流程依赖于GPT-4,这可能导致位置偏差(position bias)等问题,影响评估结果的客观性。其次,数据集中包含的问题相对简单,未能充分涵盖复杂场景下的模型表现,限制了其在实际应用中的泛化能力。此外,自动化评估流程虽然提高了效率,但也可能因缺乏人工干预而忽略某些细微的模型差异。这些挑战凸显了在语言模型评估中平衡自动化与人工评审的重要性,同时也为未来研究提供了改进方向。

常用场景

经典使用场景

Vicuna Evaluation数据集主要用于评估和比较不同语言模型的性能,特别是在生成式对话系统中的表现。通过使用GPT-4作为评估工具,该数据集能够自动化生成模型回答并进行评分,从而为研究人员提供一个标准化的评估框架。这一场景在自然语言处理领域尤为重要,尤其是在对话系统的开发和优化过程中。

实际应用

在实际应用中,Vicuna Evaluation数据集被广泛应用于对话系统的开发和优化。企业可以利用该数据集评估其对话模型的表现,识别模型在生成回答时的弱点,并进行针对性的改进。此外,该数据集还可用于教育领域,帮助学生和研究人员理解语言模型的评估方法和技术。

衍生相关工作

Vicuna Evaluation数据集衍生了一系列相关研究,特别是在语言模型评估和对话系统优化方面。例如,基于该数据集的研究工作探讨了如何通过改进评估方法来提升模型性能,以及如何利用自动化评估工具减少人工干预。这些研究不仅丰富了自然语言处理领域的理论体系,也为实际应用提供了有力的技术支持。

以上内容由遇见数据集搜集并总结生成