FlagEval

收藏github2023-06-01 更新2025-02-07 收录

下载链接:

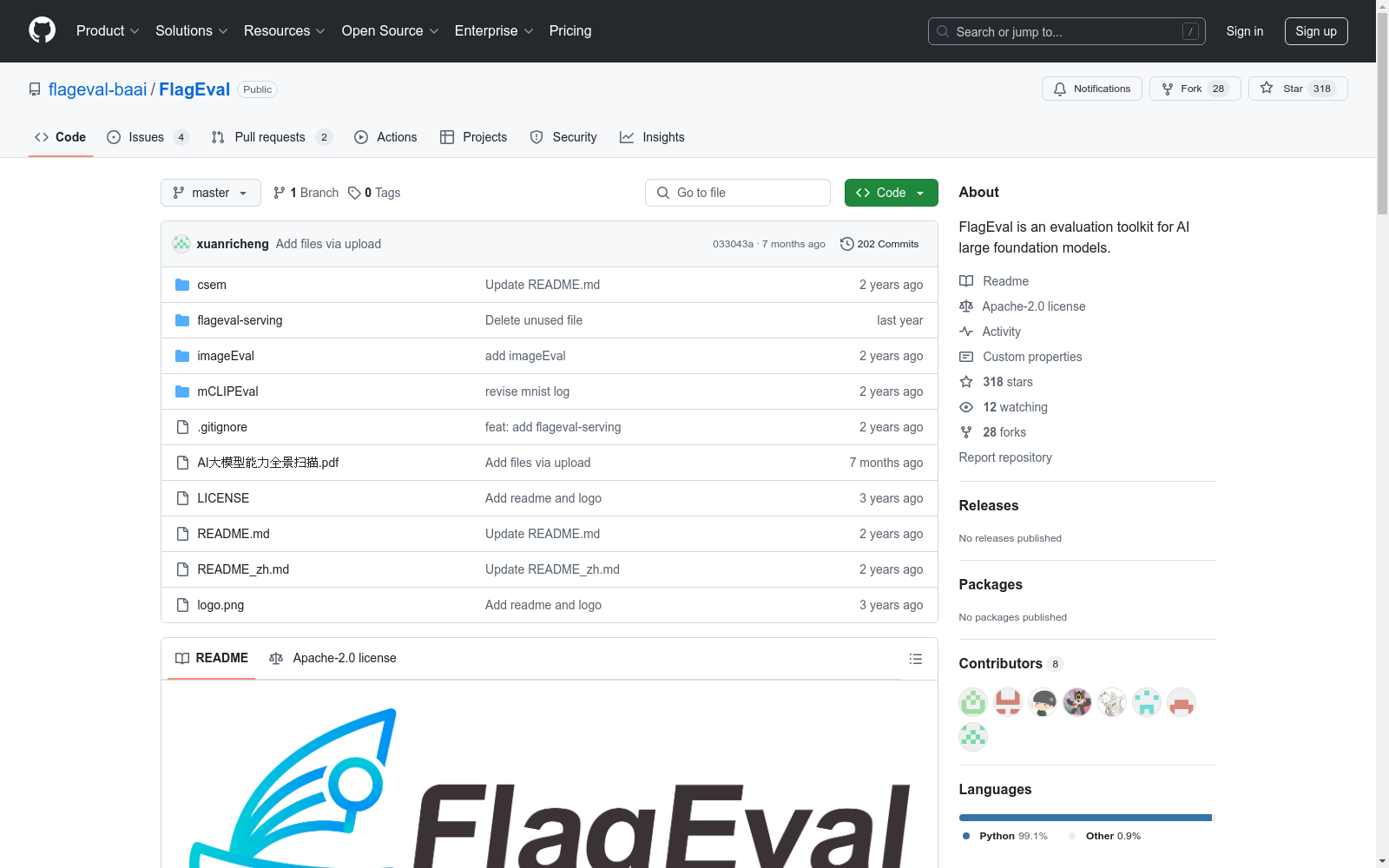

https://github.com/flageval-baai/FlagEval

下载链接

链接失效反馈资源简介:

FlagEval数据集目前涵盖了22个评估集合,包含总计84,433个问题。它引入了一个基于“能力-任务-指标”维度的细致评估框架,能够详细揭示模型的认知边界。该评估覆盖了30多种能力、5项主要任务和4个关键指标,涉及超过600个子维度。

The FlagEval dataset currently encompasses 22 evaluation sets, comprising a total of 84,433 questions. It introduces a refined evaluation framework based on the 'ability-task-metric' dimension, which can meticulously unveil the cognitive boundaries of models. The evaluation covers over 30 abilities, five major tasks, and four key metrics, involving more than 600 sub-dimensions.

提供机构:

BAAI et al.

创建时间:

2023-06-01

原始信息汇总

FlagEval数据集概述

1. 总体介绍

- 定位:开源评估工具包及大模型评估开放平台

- 评估对象:基础模型、预训练算法、微调/压缩算法

- 评估场景:自然语言处理(NLP)、计算机视觉(CV)、音频、多模态

- 目标:开发科学、公正、清晰的基准测试和方法论

2. 子项目详情

2.1 mCLIPEval

- 功能:视觉语言模型(如CLIP)评估工具包

- 特点:

- 支持12种语言数据集和单语(英/中)数据集

- 评估任务:零样本分类、检索和组合

- 适配多种预训练模型(FlagAI/OpenCLIP/Chinese CLIP等)

- 支持多数据源准备(torchvision/huggingface/kaggle)

- 提供可视化评估结果(排行榜/模型对比)

2.2 ImageEval-prompt

- 功能:细粒度文本到图像(T2I)模型评估提示集

- 特点:

- 包含1,624英文提示和339中文提示

- 采用"双盲标注+第三方仲裁"标注方法

- 三维度评估:

- 实体维度(对象/状态/颜色/数量/位置)

- 风格维度(绘画风格/文化风格)

- 细节维度(手部/面部特征/性别/逻辑知识)

2.3 C-SEM

- 功能:大模型语义理解评估系统(v1.0)

- 评估项目:

- 词汇级语义关系分类(LLSRC)

- 句子级语义关系分类(SLSRC)

- 句子级多义词分类(SLPWC)

- 句子级修辞手法分类(SLRFC)

3. 许可信息

- 主许可证:Apache 2.0

- 特殊许可:

- CLIP_benchmark使用MIT许可

- ImageNet1k数据集使用huggingface datasets和ImageNet许可

4. 联系方式

- 问题反馈:GitHub Issues或flageval@baai.ac.cn

- 合作招聘:基础模型评估相关职位

- 贡献邀请:欢迎提交新任务/数据集/工具

搜集汇总

数据集介绍

构建方式

FlagEval数据集的构建依托于多模态大模型的评估需求,涵盖了自然语言处理、计算机视觉、音频和多模态四大核心场景。其构建过程通过整合开源工具和平台,结合多种预训练模型和算法,确保了评估的科学性和全面性。数据来源多样化,包括torchvision、huggingface和kaggle等平台,确保了数据的广泛性和代表性。此外,FlagEval还通过双盲标注和第三方仲裁的方式对提示词进行精细标注,进一步提升了数据的质量和可靠性。

特点

FlagEval数据集的特点在于其多维度、多语言的评估能力。它不仅支持多语言(12种语言)和单语言(中英文)数据集,还涵盖了零样本分类、检索和组合任务。数据集的提示词标注分为实体、风格和细节三个维度,每个维度下又细分为多个子维度,如对象、状态、颜色等,提供了精细化的评估标准。此外,FlagEval还创新性地构建了C-SEM评估体系,从词汇和句子层面考察模型的语义理解能力,为研究提供了丰富的对比数据。

使用方法

FlagEval的使用方法简便且灵活。用户需确保环境满足Pytorch版本≥1.8.0和Python版本≥3.8的要求,并安装CUDA和NCCL以支持GPU评估。通过克隆GitHub仓库并安装依赖包,用户即可快速启动评估任务。FlagEval提供了详细的文档和示例代码,用户可根据需求选择不同的子项目进行评估,如mCLIPEval用于视觉语言模型评估,ImageEval-prompt用于文本到图像模型的细粒度评估。评估结果可通过排行榜图表或表格进行可视化展示,便于用户进行模型性能的详细对比和分析。

背景与挑战

背景概述

FlagEval是由北京智源人工智能研究院开发的开源评估工具包和开放平台,旨在为大模型的评估提供科学、公正和清晰的基准、方法和工具。该平台涵盖了自然语言处理(NLP)、计算机视觉(CV)、音频和多模态等关键评估场景,并包含丰富的下游任务。FlagEval的核心研究问题在于如何全面评估基础模型和训练算法的有效性,同时探索利用AI技术增强主观评估的客观性和效率。自推出以来,FlagEval在推动大模型评估领域的发展中发挥了重要作用,吸引了众多研究人员的关注和参与。

当前挑战

FlagEval面临的挑战主要集中在两个方面。首先,在领域问题方面,如何设计出能够全面覆盖多模态任务的评估基准,以确保模型在不同场景下的表现得到准确衡量,是一个复杂且具有挑战性的问题。其次,在构建过程中,如何确保评估数据的多样性和代表性,尤其是在多语言和多文化背景下,数据的收集和标注工作面临巨大挑战。此外,如何利用AI技术提升主观评估的客观性和效率,也是FlagEval团队需要持续探索和优化的方向。

常用场景

经典使用场景

FlagEval作为一个开源的大模型评估工具包,广泛应用于自然语言处理(NLP)、计算机视觉(CV)、音频和多模态领域的模型评估。其核心功能包括对基础模型、预训练算法以及微调/压缩算法的全面评估。通过提供丰富的下游任务数据集和评估场景,FlagEval为研究人员提供了一个科学、公正且透明的评估平台,帮助他们深入理解模型的性能与局限性。

解决学术问题

FlagEval解决了大模型评估中的多个关键学术问题,尤其是在多语言、多模态场景下的模型性能评估。通过引入mCLIPEval等子项目,FlagEval支持零样本分类、检索和组合任务,显著提升了模型在跨语言和跨模态任务中的表现。此外,C-SEM项目通过构建多层次、多难度的语义理解评估数据,弥补了现有大模型在语义理解能力上的不足,为模型优化提供了科学依据。

衍生相关工作

FlagEval的推出催生了一系列相关研究工作,尤其是在多模态模型评估领域。例如,基于mCLIPEval的研究推动了多语言CLIP模型的优化,而C-SEM项目则为语义理解模型的评估提供了新的基准。此外,FlagEval的开源特性吸引了大量开发者贡献新的评估任务和数据集,进一步丰富了其生态系统,推动了整个大模型评估领域的发展。

以上内容由遇见数据集搜集并总结生成