PAN-X

收藏github2023-06-19 更新2024-05-31 收录

下载链接:

https://github.com/NityamPareek/Multilingual-Named-Entity-Recognition

下载链接

链接失效反馈资源简介:

该数据集是Cross-lingual TRansfer Evaluation of Multilingual Encoders (XTREME)基准的一部分,名为WikiANN或PAN-X。它包含多种语言的维基百科文章,特别是瑞士四种最常用语言:德语、法语、意大利语和英语。每篇文章都使用LOC(位置)、PER(人物)和ORG(组织)标签在‘inside-outside-beginning’(IOB2)格式下进行了标注。

This dataset, named WikiANN or PAN-X, is part of the Cross-lingual TRansfer Evaluation of Multilingual Encoders (XTREME) benchmark. It contains Wikipedia articles across multiple languages, particularly the four most commonly used languages in Switzerland: German, French, Italian, and English. Each article has been annotated with LOC (location), PER (person), and ORG (organization) tags in the 'inside-outside-beginning' (IOB2) format.

创建时间:

2023-06-15

原始信息汇总

数据集概述

数据集名称

- WikiANN (PAN-X)

数据集内容

- 包含多种语言的Wikipedia文章,特别选取了瑞士四种主要语言的文章:德语(62.9%)、法语(22.9%)、意大利语(8.4%)、英语(5.9%)。

- 文章均以“inside-outside-beginning”(IOB2)格式标注了LOC(位置)、PER(人物)、ORG(组织)标签。

数据集用途

- 用于训练和评估跨语言的命名实体识别(NER)模型。

数据集采样

- 根据瑞士各语言的使用比例,从PAN-X数据集中采样相应的语言数据。

模型与技术

模型选择

- XLM-RoBERTa (XLM-R):一种多语言Transformer模型,用于跨语言的NER任务。

模型特点

- 使用SentencePiece作为Tokenizer,支持多语言处理,特别是对于无空格字符的语言如日语。

训练流程

- 从PAN-X数据集构建多语言数据集。

- 使用SentencePiece进行文本Tokenization。

- 导入预训练的XLM-R模型。

- 在多语言数据集上进行模型微调。

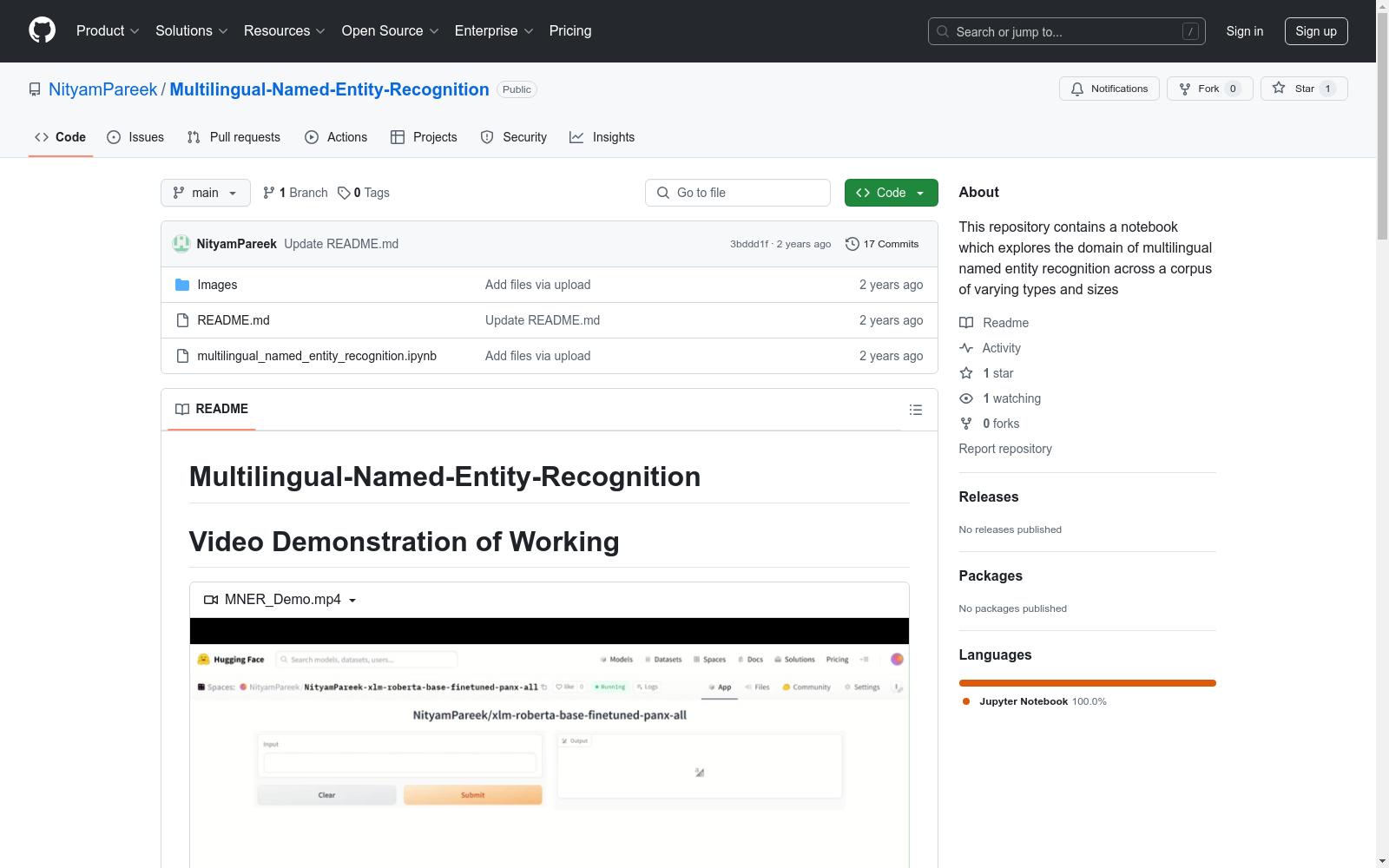

- 使用Gradio Spaces在Hugging Face上部署模型。

实验结果

- 在小规模数据集上,零样本跨语言迁移效果优于微调。

- 随着微调数据集规模的增加,模型性能相比零样本迁移有所提升。

- 增加某一语言的训练数据量,能提升模型在其他语言上的表现。

模型部署

- 模型已通过Gradio Spaces在Hugging Face平台上部署,可用于测试自定义输入。

AI搜集汇总

数据集介绍

构建方式

PAN-X数据集的构建基于跨语言迁移评估多语言编码器(XTREME)基准的子集WikiANN。该数据集涵盖了多种语言的维基百科文章,特别是瑞士的四种主要语言:德语、法语、意大利语和英语。为了模拟现实世界的语言分布,数据集根据这些语言在瑞士的使用比例进行了采样。每篇文章均采用“内部-外部-开始”(IOB2)格式标注了位置(LOC)、人物(PER)和组织(ORG)等实体。

使用方法

使用PAN-X数据集时,首先需要从数据集中提取多语言语料,并使用SentencePiece分词器对输入文本进行分词处理。接着,导入预训练的XLM-RoBERTa模型,并在多语言语料上进行微调。微调后的模型可以部署在Hugging Face等平台上,用于实际的命名实体识别任务。用户还可以通过Gradio Spaces在Hugging Face上测试自己的输入,以验证模型的性能。

背景与挑战

背景概述

PAN-X数据集是跨语言命名实体识别(NER)领域的重要资源,源自XTREME基准测试中的WikiANN子集。该数据集由多语言维基百科文章构成,涵盖了德语、法语、意大利语和英语等四种瑞士主要语言,每种语言的文本均标注了位置(LOC)、人物(PER)和组织(ORG)等实体标签,采用IOB2格式。PAN-X的创建旨在支持多语言环境下的NER任务,特别是在瑞士这样的多语言国家中,为跨语言信息提取和知识库构建提供了重要支持。该数据集的研究背景与多语言自然语言处理(NLP)的发展密切相关,其核心研究问题在于如何通过单一模型实现多语言实体识别,从而提升跨语言信息处理的效率与准确性。

当前挑战

PAN-X数据集在应用与构建过程中面临多重挑战。首先,多语言NER任务本身具有复杂性,不同语言之间的语法结构、词汇表达和实体标注规范存在显著差异,这对模型的泛化能力提出了极高要求。其次,数据集的构建依赖于维基百科的多语言语料,而维基百科的内容分布不均,某些语言的标注数据较为稀缺,可能导致模型在某些语言上的性能受限。此外,尽管XLM-RoBERTa等预训练模型在多语言任务中表现出色,但其对低资源语言的适应性仍需进一步优化。最后,数据采样比例的合理性也是一个关键问题,如何根据语言使用频率调整数据分布以模拟真实场景,仍需深入研究。

常用场景

经典使用场景

PAN-X数据集在多语言命名实体识别(NER)任务中展现了其独特价值。通过涵盖德语、法语、意大利语和英语的维基百科文章,该数据集为研究者提供了一个跨语言实体标注的基准。其经典使用场景包括在多语言环境下训练和评估NER模型,特别是在瑞士这样的多语言国家中,模拟真实世界的语言分布和实体识别需求。

解决学术问题

PAN-X数据集解决了多语言NER任务中的关键学术问题,如跨语言迁移学习和低资源语言下的实体识别。通过提供多语言标注数据,研究者能够探索模型在不同语言间的泛化能力,并验证零样本迁移与微调策略的效果。该数据集为多语言NLP研究提供了重要的实验基础,推动了跨语言模型的发展。

实际应用

在实际应用中,PAN-X数据集支持了多语言信息抽取系统的开发,例如在企业文档分析、搜索引擎优化和多语言知识图谱构建中发挥重要作用。通过识别文本中的人名、地名和组织名,该数据集为多语言环境下的信息结构化提供了技术支持,提升了跨语言数据处理的效率和准确性。

数据集最近研究

最新研究方向

在自然语言处理领域,跨语言命名实体识别(NER)正成为研究热点,尤其是在多语言环境下的应用。PAN-X数据集作为XTREME基准的一部分,提供了涵盖德语、法语、意大利语和英语的维基百科文章,并标注了位置、人物和组织等实体。近期研究聚焦于利用XLM-RoBERTa等预训练多语言模型进行微调,以提升跨语言NER的性能。研究表明,随着训练数据的增加,模型在一种语言上的性能提升能够泛化到其他语言,这为多语言信息抽取和知识图谱构建提供了新的思路。此外,零样本跨语言迁移在小型语料库上表现优异,但随着语料库规模的扩大,微调模型的性能显著提升,这一发现为资源稀缺语言的NER任务提供了重要参考。

以上内容由AI搜集并总结生成