SAMM Long Videos

收藏arXiv2020-02-29 更新2024-06-21 收录

下载链接:

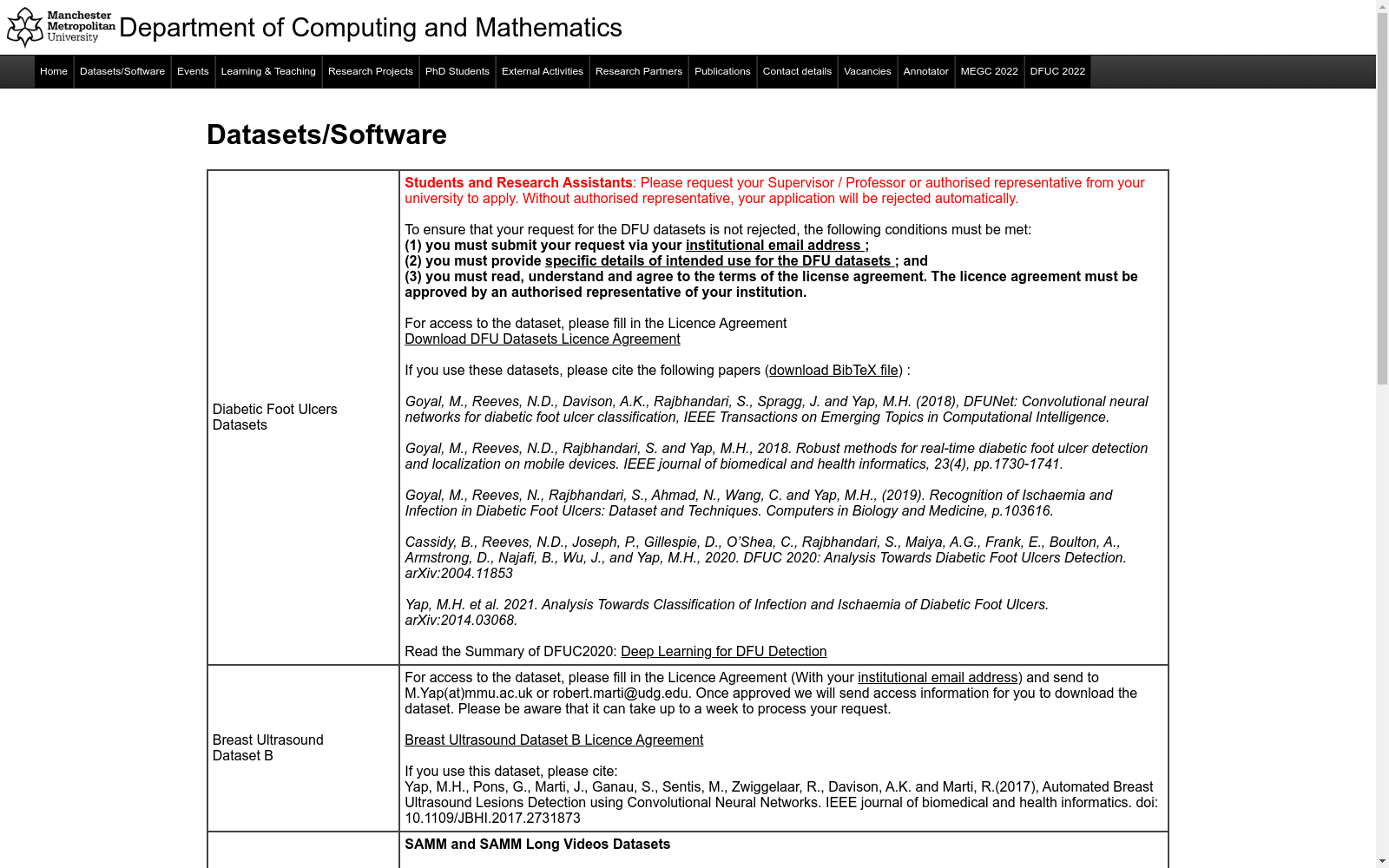

http://www2.docm.mmu.ac.uk/STAFF/M.Yap/dataset.php

下载链接

链接失效反馈资源简介:

SAMM Long Videos数据集是由曼彻斯特都会大学计算机与数学系创建,专注于自发面部微观和宏观表情的识别与检测。该数据集包含147个长视频,总计343个宏观表情和159个微观表情,采用FACS编码详细动作单元。数据集创建过程中,使用OpenFace工具进行面部对齐和动作单元检测,提高了数据处理的质量。该数据集主要应用于情感研究、行为心理学、安全及通信等领域,旨在解决面部微观和宏观表情识别的挑战。

The SAMM Long Videos Dataset was developed by the School of Computer Science and Mathematics, Manchester Metropolitan University, focusing on the recognition and detection of spontaneous facial micro-expressions and macro-expressions. This dataset consists of 147 long videos, totaling 343 macro-expressions and 159 micro-expressions, with detailed Action Units (AUs) annotated via the Facial Action Coding System (FACS). During the development of this dataset, the OpenFace toolkit was employed for facial alignment and Action Unit detection, thereby enhancing the quality of data processing. This dataset is primarily utilized in domains including affective research, behavioral psychology, security, and communication, with the goal of addressing the challenges in facial micro-expression and macro-expression recognition.

提供机构:

曼彻斯特都会大学计算机与数学系

创建时间:

2019-11-05

AI搜集汇总

数据集介绍

构建方式

SAMM Long Videos 数据集的构建是基于 SAMM 微表情数据集的扩展,旨在满足对长视频中的微表情和宏表情识别与定位的需求。该数据集包含 147 个长视频,共标注了 343 个宏表情和 159 个微表情。所有视频均采用 FACScoding 方式进行标注,详细记录了每个表情单元(AUs)的动作。为了提高数据集的质量,研究人员使用 OpenFace 工具对视频进行了预处理,包括面部对齐和 AU 的检测。此外,他们还与 CAS(ME)2 数据集进行了比较,以评估 SAMM Long Videos 数据集的优越性。

使用方法

SAMM Long Videos 数据集的使用方法如下:1. 数据下载:可以从数据集的官方网站(http://www2.docm.mmu.ac.uk/STAFF/M.Yap/dataset.php)下载数据集及其标注文件;2. 数据预处理:使用 OpenFace 工具对视频进行预处理,包括面部对齐和 AU 的检测;3. 数据标注:根据 FACScoding 方式对视频中的微表情和宏表情进行标注;4. 数据分析:使用机器学习或深度学习算法对标注数据进行训练和测试,评估模型在微表情和宏表情识别与定位方面的性能。

背景与挑战

背景概述

在近年来面部微表情研究领域日益受到关注的背景下,对包含微表情和宏表情的长视频的需求持续增长。SAMM Long Videos数据集是在2016年发布的微表情数据集SAMM的基础上扩展而来,旨在为自发的微表情和宏表情识别与定位提供数据支持。该数据集由英国曼彻斯特都会大学计算与数学系的研究人员Chuin Hong Yap、Connah Kendrick和Moi Hoon Yap创建,包含147个长视频,其中包含343个宏表情和159个微表情。所有视频均经过FACS编码,并标注了详细的动作单元(AUs)。该数据集的发布为研究人员提供了宝贵的资源,有助于推动面部表情识别与定位技术的发展。

当前挑战

SAMM Long Videos数据集面临的挑战主要包括:1)领域问题挑战:在现实场景中,微表情和宏表情可能共存或独立发生,这使得同时识别和定位这两种表情成为一项挑战;2)构建过程中遇到的挑战:构建包含FACS编码的微表情和宏表情的长视频数据集是一项复杂的工作,需要精确的动作单元标注和视频预处理。此外,OpenFace工具在微表情检测方面表现不如宏表情检测,这表明需要进一步研究和改进微表情检测方法。

常用场景

经典使用场景

SAMM Long Videos数据集广泛应用于面部微表情和宏观表情的自动识别与定位。该数据集包含了丰富的表情变化,为研究者提供了宝贵的实验资源,有助于改进和验证面部表情识别算法。通过对面部运动单元的精确编码,该数据集支持了表情的细致分析,对于理解人类非言语交流的本质具有重要意义。

解决学术问题

SAMM Long Videos数据集解决了当前面部表情研究中缺乏长期视频数据集的问题。传统的面部表情数据集往往局限于短时间内的表情捕捉,而SAMM Long Videos则提供了更自然、更长时间的视频片段,使得研究者能够更全面地观察和分析微表情和宏观表情。此外,该数据集的详尽注释为表情的自动识别和定位提供了精确的基准,有助于提高算法的准确性和鲁棒性。

实际应用

SAMM Long Videos数据集在情感计算、行为心理学、安全监控和人际交流等领域具有广泛的应用前景。通过该数据集训练的模型可以用于识别和预测人类的情感状态,从而在智能人机交互、心理健康评估和安全性分析等领域发挥重要作用。例如,在安全监控系统中,通过分析个体的面部表情,可以及时发现异常行为,提高安全防范的效率。

数据集最近研究

最新研究方向

SAMM Long Videos 数据集的推出,标志着在面部微表情和宏表情识别与定位领域的一项重要进展。该数据集扩展了 SAMM 数据集,包含了更长的视频片段,涵盖了 343 个宏表情和 159 个微表情,并以 FACScoding 方式对详细的 Action Units (AUs) 进行了标注。这一数据集的出现,为研究者提供了宝贵的数据资源,有助于提高面部表情识别系统的准确性和鲁棒性。SAMM Long Videos 数据集与已有的 CAS(ME)2 数据集进行了比较,展示了其更高的分辨率、帧率和更丰富的表情标注。此外,使用 OpenFace 进行预处理和 AU 检测,并通过自定义算法实现了面部运动检测,进一步提高了数据集的质量和可用性。未来,SAMM Long Videos 数据集有望在情感计算、人类行为学、计算机视觉和机器学习等领域发挥重要作用。

相关研究论文

- 1SAMM Long Videos: A Spontaneous Facial Micro- and Macro-Expressions Dataset曼彻斯特都会大学计算机与数学系 · 2020年

以上内容由AI搜集并总结生成