UzLiB - Uzbek Linguistic Benchmark

收藏github2025-03-29 更新2025-03-30 收录

下载链接:

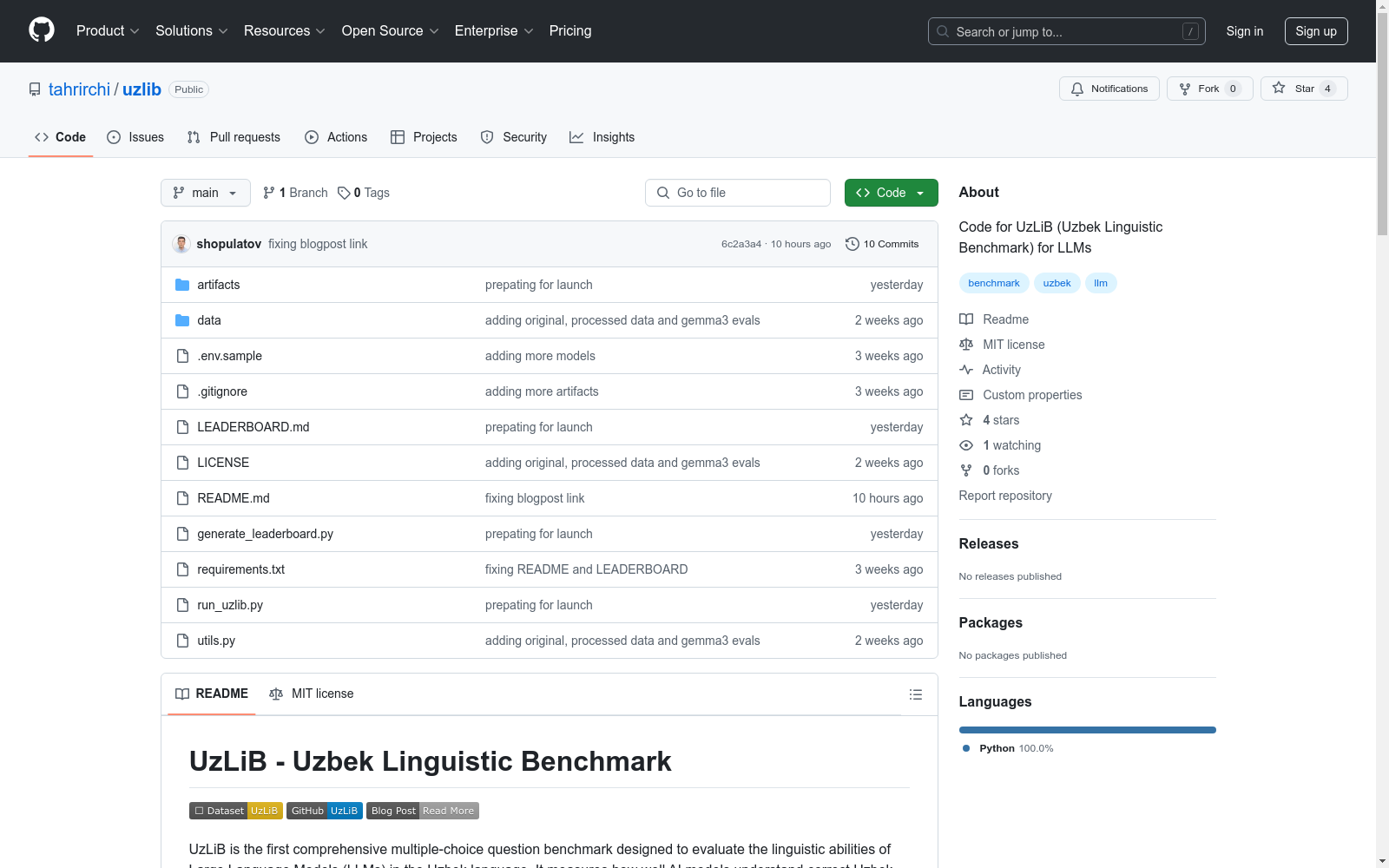

https://github.com/tahrirchi/uzlib

下载链接

链接失效反馈资源简介:

UzLiB是第一个全面的多项选择题基准,旨在评估大型语言模型在乌兹别克语中的语言能力。它衡量AI模型对乌兹别克语正确形式、用法和细微差别的理解程度。

创建时间:

2025-03-04

原始信息汇总

UzLiB - 乌兹别克语语言学基准数据集概述

数据集简介

- 名称:UzLiB (Uzbek Linguistic Benchmark)

- 类型:多项选择题基准测试

- 语言:乌兹别克语

- 目的:评估大型语言模型(LLMs)在乌兹别克语中的语言理解能力

数据来源

- 来自以下专注于乌兹别克语语言学的Telegram频道:

- Orif Tolib

- Тўғри ёзамиз — мутахассис блоги

- Tahrir.uz📝

- Tahrirchi | Tilmoch

数据处理

- 每个问题都经过人工验证和标准化

- 数据集包括转换为拉丁字母和答案选项的随机化

- 提供原始(未标准化)和处理后的版本

评估方法

- 使用一致的提示模板和标准生成参数(

temperature=1.0,top-p=0.95) - 提供评估脚本和模型输出以确保透明度

使用指南

安装要求

- Python 3.8+

- 相关LLM服务的API密钥

- 访问要评估的模型

安装步骤

- 克隆仓库

- 安装依赖项

- 设置环境变量

运行基准测试

- 使用命令

python run_uzlib.py --model_name MODEL_NAME评估特定模型

本地评估

- 使用vLLM对兼容的开源模型进行本地评估

- 需要安装vLLM并启动OpenAI兼容服务器

扩展基准测试

- 欢迎贡献新模型评估

- 需要在

utils.py中添加模型配置

引用

bibtex @misc{Shopulatov2025UzLiB, title={{UzLiB: A Benchmark for Evaluating LLMs on Uzbek Linguistics}}, author={Abror Shopulatov}, year={2025}, howpublished={url{https://huggingface.co/datasets/tahrirchi/uzlib}}, note={Accessed: YYYY-MM-DD} }

联系方式

- 邮箱:a.shopulatov@tilmoch.ai

AI搜集汇总

数据集介绍

构建方式

在乌兹别克语语言学领域,UzLiB数据集的构建采用了严谨的多源采集与标准化处理流程。研究团队从专注于乌兹别克语言学的四个主流Telegram频道精选原始测试题,通过人工校验确保题目质量,并统一转换为拉丁字母书写体系。所有题目选项均经过随机排序处理,最终形成包含原始版本与标准化版本的双重数据架构,存储于规范化目录结构中。

特点

作为首个针对乌兹别克语的多项选择式语言学基准测试集,UzLiB具备显著的学术价值与实践意义。该数据集精准捕捉乌兹别克语的形态特征、用法规范及语义细微差异,其特色在于完整保留原始语料的同时提供标准化版本,支持对大型语言模型语言理解能力的多维度评估。数据编排采用科学化的分类存储方式,便于研究者进行不同颗粒度的分析比较。

使用方法

该数据集的使用遵循模块化评估框架设计,研究者可通过配置Python环境快速部署测试系统。核心评估脚本run_uzlib.py支持灵活调用不同模型接口,配合vLLM本地推理引擎可实现高效批量测试。环境变量模板与标准生成参数预设显著降低使用门槛,而自动生成的排行榜系统则为模型性能比较提供直观参考。进阶用户可通过扩展utils.py配置文件集成新模型,实现基准测试体系的持续演进。

背景与挑战

背景概述

UzLiB(Uzbek Linguistic Benchmark)作为首个针对乌兹别克语的多项选择题基准测试数据集,由Abror Shopulatov等研究人员于2025年创建,旨在系统评估大语言模型(LLMs)在乌兹别克语中的语言学能力。该数据集通过精心设计的题目,考察模型对乌兹别克语正确形式、用法及语言细微差别的理解能力,填补了该语种在自然语言处理领域基准测试的空白。数据来源基于Telegram平台上多个专注于乌兹别克语言学的知名频道,经过人工验证与标准化处理,确保了数据的权威性与一致性。UzLiB的建立为乌兹别克语的语言模型评估提供了重要工具,推动了低资源语言在人工智能领域的研究进展。

当前挑战

UzLiB面临的挑战主要体现在两个方面:在领域问题层面,乌兹别克语作为低资源语言,其复杂的形态结构和有限的标注数据对模型的语言理解能力提出了更高要求,如何准确捕捉语言细微差别成为核心难题;在构建过程中,数据采集需平衡网络文本的多样性与语言学规范性,原始题目需经过脚本转换(西里尔文转拉丁文)、答案选项随机化等复杂处理,且每个环节均依赖人工校验,导致构建成本显著增加。此外,基准测试需适配不同架构的LLMs,统一的评估框架设计也面临技术挑战。

常用场景

经典使用场景

在自然语言处理领域,UzLiB数据集作为首个针对乌兹别克语的多项选择问答基准,主要用于评估大型语言模型(LLMs)在该语言上的语言学理解能力。研究人员通过该数据集可以系统地测试模型对乌兹别克语语法、词汇用法及语言细微差别的掌握程度,为模型优化提供量化依据。

解决学术问题

UzLiB有效解决了低资源语言评估工具匮乏的学术难题,填补了乌兹别克语在语言学基准测试领域的空白。其标准化测试框架为跨模型性能比较建立了统一尺度,尤其针对形态复杂的突厥语系语言特性,揭示了现有模型在非拉丁字母转换、语境理解等方面的共性缺陷,推动了小语种NLP技术的发展。

衍生相关工作

基于UzLiB的评估方法论,后续研究衍生出TurkicLingua跨突厥语族基准测试框架。开源社区构建了配套的乌兹别克语微调数据集UzCorpus,而论文《Low-Resource LLM Evaluation Paradigms》则系统阐述了该基准在小语种模型评估中的迁移应用模式。

以上内容由AI搜集并总结生成