Reddit Comment and Thread Datas

收藏github2018-07-05 更新2024-05-31 收录

下载链接:

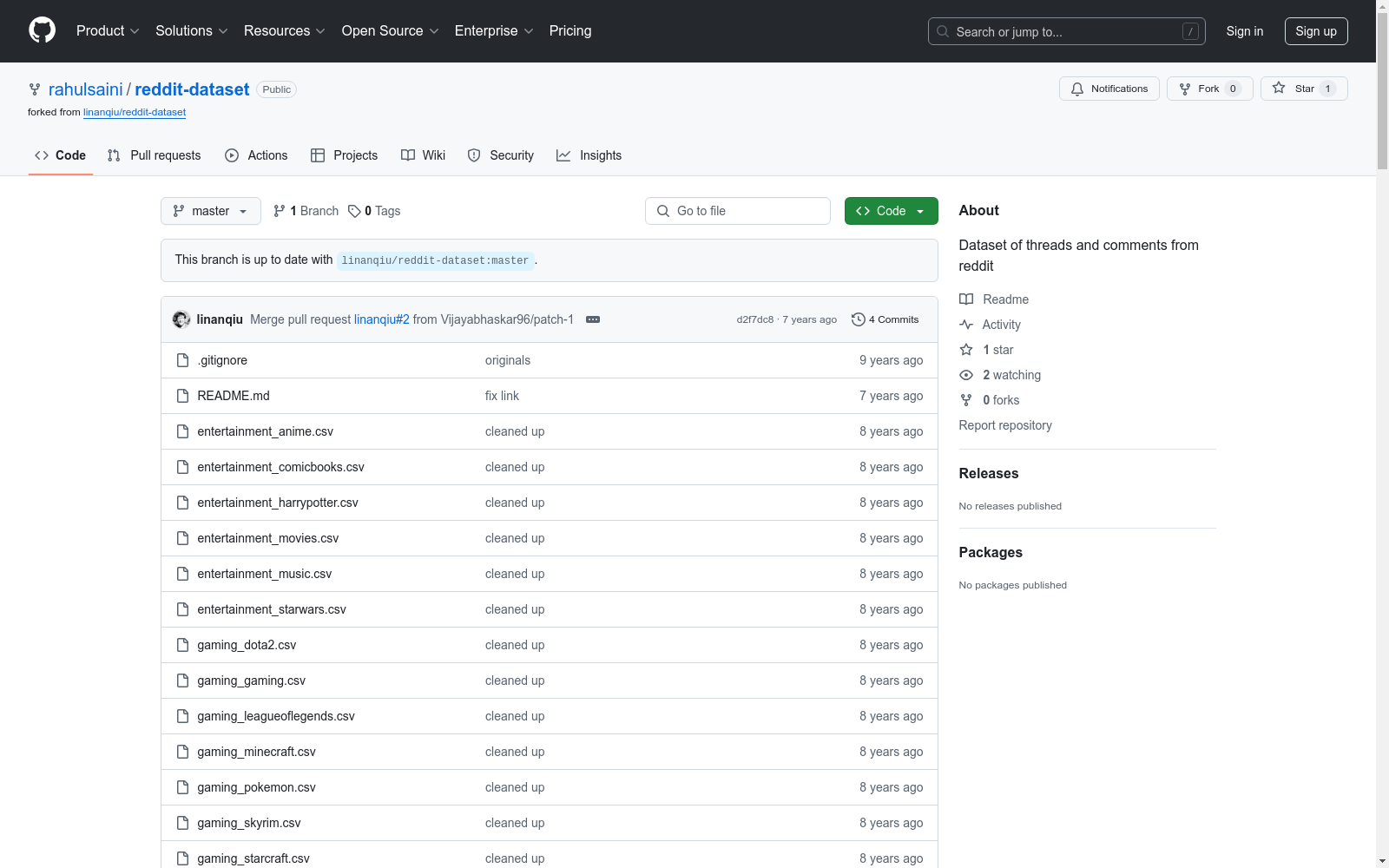

https://github.com/rahulsaini/reddit-dataset

下载链接

链接失效反馈资源简介:

约260,000条Reddit论坛的帖子和评论数据集,适用于NLP项目研究。数据包括文本、ID、所属子论坛、时间戳、作者信息、点赞数、点踩数等详细信息。

创建时间:

2018-07-05

原始信息汇总

数据集概述

数据集名称

Reddit Comment and Thread Datas

数据集大小

约260,000条评论/帖子

数据集用途

适用于自然语言处理(NLP)项目

数据集结构

文件命名规则

.csv文件命名格式为 <metareddit>_<subreddit>.csv

数据字段描述

通用字段

text: 评论/帖子的文本内容id: 评论/帖子的唯一IDsubreddit: 评论/帖子所属的子论坛meta: 评论/帖子所属的元论坛time: 评论/帖子的UNIX时间戳author: 评论/帖子的作者用户名ups: 评论/帖子获得的支持票数downs: 评论/帖子获得的反对票数authorlinkkarma: 作者的链接积分authorkarma: 作者的积分authorisgold: 作者是否为黄金用户(1为是,0为否)

帖子特定字段

title: 帖子的标题url: 帖子的URLauthorcommentkarma: 作者的评论积分

评论特定字段

无额外特定字段

数据集文件

帖子数据

- 文件名:

threads.csv - 包含字段:

text,title,url,id,subreddit,meta,time,author,ups,downs,authorlinkkarma,authorcommentkarma,authorisgold

评论数据

- 文件名:

comments.csv - 包含字段:

text,id,subreddit,meta,time,author,ups,downs,authorlinkkarma,authorcommentkarma,authorisgold

数据预处理

所有文本已转换为小写,并使用TreebankTokenizer进行分词,然后以空格连接,导致标点符号与单词分离。

AI搜集汇总

数据集介绍

构建方式

Reddit Comment and Thread Datas数据集通过从Reddit平台抓取约260,000个评论和线程构建而成。该数据集的构建采用了omega-red工具,对评论和线程的内容进行了抓取,并以.csv格式存储。在构建过程中,数据集保留了评论和线程的文本内容、唯一标识符、所属子版块、时间戳、作者信息、投票数以及作者的社区贡献度等详细信息。

特点

该数据集的主要特点在于其内容的多样性以及丰富的元信息。它包含了来自不同子版块的评论和线程,不仅涵盖了文本内容,还包含了投票数、作者链接和评论的karma值、用户是否为黄金会员等社交特征。这些特征使得该数据集在自然语言处理项目中尤其有用,如情感分析、用户行为分析等。此外,所有文本均经过规范化处理,方便后续的数据分析和模型训练。

使用方法

使用该数据集时,用户可以直接从提供的外部链接下载评论和线程的.csv文件。文件中包含了不同的列,如文本内容、唯一标识符、子版块、时间戳等,用户可以根据自己的需求选择相应的列进行分析。此外,数据集还提供了带有标点的原始文本,以供需要原始格式文本的用户使用。在应用前,用户需要确保遵守MIT许可证的规定,合法使用数据集。

背景与挑战

背景概述

Reddit Comment and Thread Datas数据集是在2016年由Linan Qiu创建,该数据集汇集了大约26万个来自Reddit的评论和线程。Reddit作为一个广泛使用的社交新闻网站,其用户生成的内容对于自然语言处理(NLP)领域的研究具有极高的价值。该数据集不仅包含了评论的文本内容,还涵盖了如评论的唯一标识符、所属子版块、时间戳、作者信息、投票数等丰富的元数据信息,为情感分析、用户行为研究、内容推荐等研究提供了基础数据。

当前挑战

尽管Reddit Comment and Thread Datas数据集为NLP领域的研究提供了丰富的资源,但也面临着一些挑战。首先,由于数据来源于社交媒体,其中的语言使用可能包含大量的非正式和口语化表达,这对语言模型的准确性和鲁棒性提出了挑战。其次,数据集构建过程中,如何确保数据的多样性和代表性,以及如何处理可能存在的数据偏差问题,也是研究者和数据科学家必须考虑的。此外,用户隐私的保护和数据使用合规性问题,在构建和使用此类数据集时也显得尤为重要。

常用场景

经典使用场景

Reddit Comment and Thread Datas数据集,作为自然语言处理领域的重要资源,其经典使用场景主要集中于文本挖掘和情感分析。该数据集提供了海量的 Reddit 评论区文本,使得研究者能够深入探索社交网络中的用户行为和情感倾向,进而为构建更为精准的文本分类和情感预测模型提供了坚实基础。

衍生相关工作

基于Reddit Comment and Thread Datas数据集,已经衍生出一系列经典工作,包括但不限于社交媒体情绪分析、用户行为预测模型构建以及网络社群结构分析等。这些研究进一步拓展了该数据集的应用范围,为网络科学和自然语言处理领域的发展做出了贡献。

数据集最近研究

最新研究方向

Reddit Comment and Thread Datas数据集作为自然语言处理领域的重要资源,近期研究方向集中于情感分析、用户行为预测以及社交媒体影响力评估等方面。该数据集涵盖了约260,000个线程/评论,为研究人员提供了深入了解用户在线互动模式的机会。在情感分析方面,学者们正致力于通过深度学习技术更精确地识别用户情绪,以便于舆情监控和个性化推荐。用户行为预测研究则试图从评论和线程中提取特征,预测用户未来的互动行为,这对于社交媒体平台的内容推荐和用户留存策略至关重要。此外,评估用户在社交媒体中的影响力,即通过用户的karma值和gold状态等指标,分析用户在网络社区中的角色和地位,也是当前研究的热点。这些研究对于提升社交媒体平台用户体验,增强网络内容的质量和相关性具有重要的实际意义。

以上内容由AI搜集并总结生成