【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

Emilia

收藏arXiv2024-07-07 更新2024-07-12 收录

下载链接:

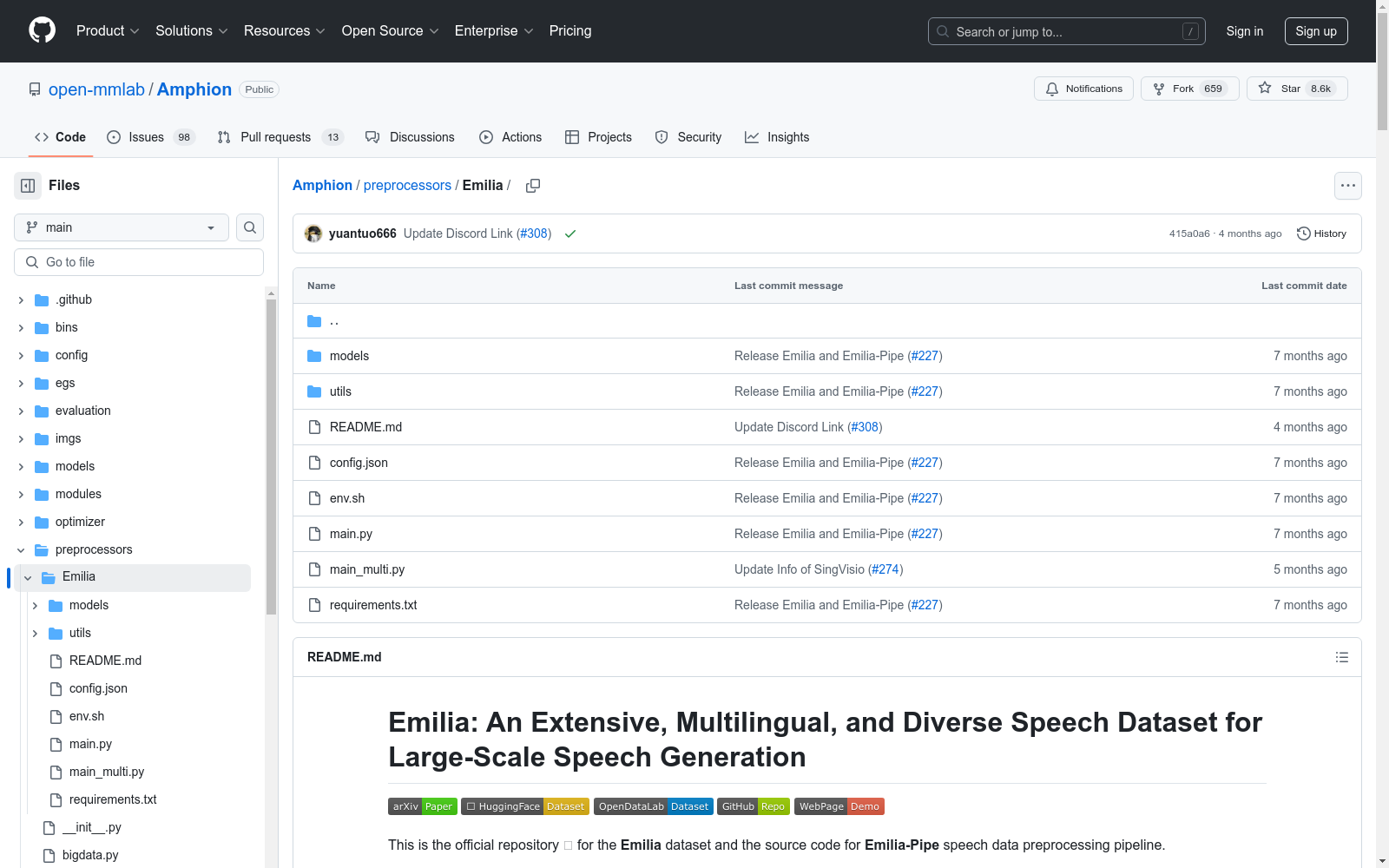

https://github.com/open-mmlab/Amphion/tree/main/preprocessors/Emilia

下载链接

链接失效反馈官方服务:

资源简介:

Emilia数据集由香港中文大学(深圳)等机构创建,是一个大规模、多语言、多样化的语音生成数据集,包含超过101,654小时的语音数据,涵盖英语、中文、德语、法语、日语和韩语。数据集主要由野外语音数据构成,具有多种说话风格,通过Emilia-Pipe预处理管道进行标准化、源分离、说话人分类、细粒度分段、自动语音识别和过滤等步骤创建。该数据集旨在推动语音生成模型向更自然、更人性化的方向发展,适用于多语言文本到语音(TTS)模型的训练。

The Emilia dataset, created by institutions including The Chinese University of Hong Kong, Shenzhen, is a large-scale, multilingual and diverse speech generation dataset containing over 101,654 hours of speech data covering English, Mandarin, German, French, Japanese and Korean. The dataset primarily consists of in-the-wild speech data with diverse speaking styles, and was constructed via the Emilia-Pipe preprocessing pipeline which includes standardization, source separation, speaker classification, fine-grained segmentation, automatic speech recognition and filtering steps. This dataset aims to advance speech generation models toward more natural and human-like directions, and is suitable for training multilingual text-to-speech (TTS) models.

提供机构:

香港中文大学(深圳), 中国科学院声学研究所语音与智能信息处理实验室, 中国科学院大学, 上海人工智能实验室

创建时间:

2024-07-07

搜集汇总

数据集介绍

构建方式

Emilia数据集的构建始于收集超过101k小时的六种语言的语音数据,涵盖了英语、中文、德语、法语、日语和韩语。这些数据来源于多种视频平台和播客,涵盖了谈话节目、访谈、辩论、体育评论和有声读物等多种内容类别,以确保数据集能够捕捉到广泛的实际人类说话风格。Emilia数据集的构建采用了Emilia-Pipe预处理流程,该流程包括标准化、源分离、说话人分割、基于语音活动检测的细粒度分割、自动语音识别和过滤六个步骤。这些步骤旨在将原始的野外语音数据转换为高质量的训练数据,并为其添加语音生成所需的注释。Emilia-Pipe能够高效地将原始语音数据转换为适合模型训练的数据,每分钟可以处理约2.50小时的原始语音数据。

特点

Emilia数据集的特点主要体现在其广泛性、多语言性和多样性上。它包含了超过101k小时的语音数据,覆盖了六种语言,是迄今为止最大的学术语音生成数据集。Emilia数据集主要包含自发的语音,涵盖了广泛的说话风格,这对于训练高质量、自发和人性化的语音生成模型至关重要。此外,Emilia数据集还具备动态性,可以通过添加用户指定的源音频来轻松扩展其总时长和语言覆盖范围。Emilia-Pipe预处理流程的开放源代码特性使得数据集能够被广泛的研究人员使用,从而推动大规模语音生成研究的发展。

使用方法

Emilia数据集的使用方法包括以下步骤:首先,使用Emilia-Pipe预处理流程对原始语音数据进行处理,将其转换为适合模型训练的数据,并为其添加语音生成所需的注释。然后,使用这些数据训练语音生成模型,如文本到语音(TTS)模型。Emilia数据集提供了多种语言的数据,可以用于训练多语言TTS模型。此外,Emilia数据集还提供了测试集,可以用于评估模型在生成自发和人性化语音方面的性能。研究人员可以使用Emilia数据集进行大规模的语音生成研究,并利用其开放源代码的特性进行进一步的开发和改进。

背景与挑战

背景概述

随着语音生成模型在利用大规模训练数据方面的显著进展,当前研究社区在生成高度自然和类似人类语音方面仍面临挑战。主要原因之一是缺乏大规模、多样化和自然语音数据。为了解决这一问题,He等人提出了Emilia数据集,这是第一个基于野外语音数据的多元语音生成数据集。Emilia数据集由超过101,000小时的六种语言的语音数据组成,具有多样化的语音和不同的说话风格。为了促进Emilia的扩展,研究人员还设计了一个名为Emilia-Pipe的开源预处理流程,用于将野外语音数据转换为高质量的语音生成训练数据。Emilia-Pipe可以在几分钟内处理一小时的原始语音数据,使研究社区能够协作进行大规模语音生成研究。实验结果表明,Emilia数据集在生成高质量、自然和类似人类的语音方面是有效的。

当前挑战

Emilia数据集和相关研究面临的主要挑战包括:1) 缺乏大规模、多样化和自然语音数据,导致生成的语音无法与真实世界中的自然人类语音相媲美;2) 直接使用野外语音数据不可行,因为这些数据存在长度和质量的差异、频繁的背景噪音、音乐、混响、单个样本中存在多个说话者以及缺乏必要的标注(如文本转录)。Emilia-Pipe预处理流程的引入解决了这些问题,但如何在保持数据质量和多样性的同时进一步扩大数据集规模,以及如何提高预处理流程的效率,仍然是当前研究的重要挑战。

常用场景

经典使用场景

Emilia数据集广泛应用于大规模语音生成研究,尤其适合于训练能够生成自然、真实语音的模型。它涵盖了六种语言的丰富语音样本,包括英语、中文、德语、法语、日语和韩语,为多语言语音合成提供了宝贵的资源。此外,Emilia数据集还包含了多种说话风格,如谈话、采访、辩论、体育评论和有声读物等,使得训练出的模型能够适应不同的语境和场景。

解决学术问题

Emilia数据集解决了当前语音生成模型在生成自然、真实语音方面存在的局限性。传统的语音数据集大多来源于有声读物,其语音风格较为正式,缺乏真实生活中的自然性和多样性。Emilia数据集从野外语音数据中提取,包含了大量自然、真实的语音样本,为语音生成模型提供了更为丰富的训练数据。此外,Emilia-Pipe预处理管道能够有效地将野外语音数据转换为高质量的训练数据,并添加语音生成所需的注释,进一步提高了数据集的质量和可用性。

衍生相关工作

Emilia数据集的发布推动了语音生成领域的研究进展,衍生出了一系列相关的研究工作。例如,基于Emilia数据集,研究人员可以探索如何训练更加高效的语音生成模型,如何提高语音生成模型在不同语言和说话风格下的性能,以及如何将Emilia数据集应用于语音识别、语音转换等任务中。此外,Emilia-Pipe预处理管道的发布也为语音数据预处理领域的研究提供了新的思路和方法。

以上内容由遇见数据集搜集并总结生成