OmniGEC

收藏arXiv2025-09-18 更新2025-09-20 收录

下载链接:

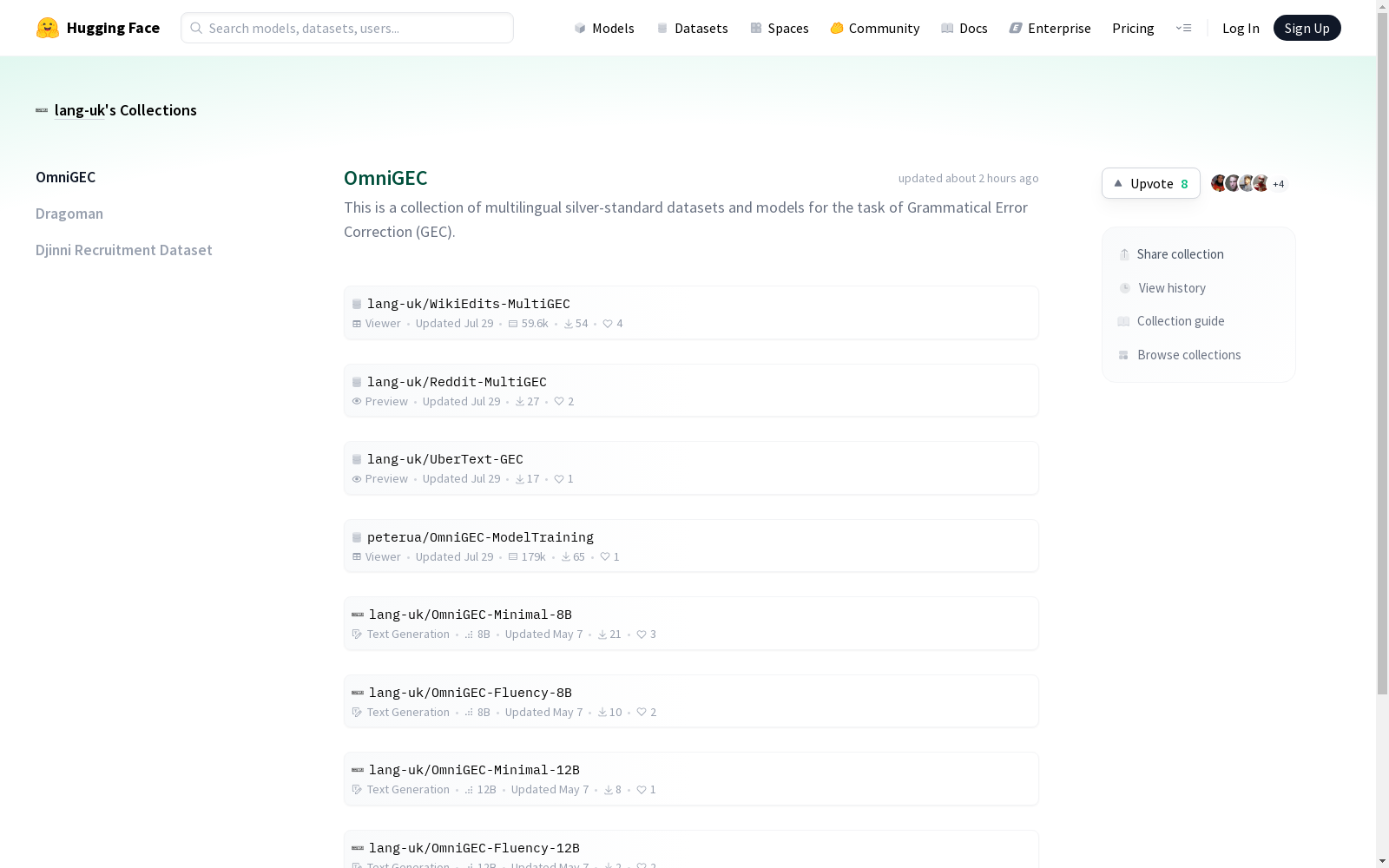

https://huggingface.co/collections/lang-uk/omnigec-68095391ebef195ed6c0a5f3

下载链接

链接失效反馈资源简介:

OmniGEC是一个用于语法错误纠正(GEC)的多语言银标准数据集,覆盖了11种语言:捷克语、英语、爱沙尼亚语、德语、希腊语、冰岛语、意大利语、拉脱维亚语、斯洛文尼亚语、瑞典语和乌克兰语。这些数据集有助于开发多语言GEC解决方案,并有助于弥合将英语GEC解决方案适应多语言GEC的数据差距。数据集的文本来自三个来源:11种目标语言的维基百科编辑、11种目标语言的Reddit子版块和仅乌克兰的UberText 2.0社交媒体语料库。维基百科编辑是从人工纠正中派生出来的,而Reddit和UberText 2.0数据是使用GPT-4o-mini模型自动纠正的。数据集中的校正质量既通过自动方式也通过手动方式进行评估。最后,我们对两个开源大型语言模型——Aya-Expanse (8B)和Gemma-3(12B)——进行了微调,并在多语言OmniGEC语料库上取得了段落级多语言GEC的最新(SOTA)成果。数据集收集和表现最佳的模型可在Hugging Face上获得。

OmniGEC is a multilingual silver-standard dataset for grammatical error correction (GEC), covering 11 languages: Czech, English, Estonian, German, Greek, Icelandic, Italian, Latvian, Slovenian, Swedish, and Ukrainian. This dataset supports the development of multilingual GEC solutions and helps bridge the data gap when adapting English-centric GEC systems to multilingual GEC scenarios. The texts in the dataset originate from three sources: 1) Wikipedia edits of the 11 target languages, 2) Reddit subreddits of the 11 target languages, and 3) the UberText 2.0 social media corpus exclusive to Ukrainian. Wikipedia edits are derived from human corrections, while Reddit and UberText 2.0 data were automatically corrected using the GPT-4o-mini model. The quality of corrections in the dataset is evaluated through both automatic and manual methods. Finally, we fine-tuned two open-source large language models: Aya-Expanse (8B) and Gemma-3 (12B), and achieved state-of-the-art (SOTA) results on paragraph-level multilingual GEC using the OmniGEC multilingual corpus. The dataset collection and the best-performing model are available on Hugging Face.

提供机构:

Ukrainian Catholic University, Softserve Lviv, Ukraine

创建时间:

2025-09-18

AI搜集汇总

数据集介绍

构建方式

OmniGEC数据集通过多源文本整合与智能校正技术构建,涵盖十一种语言。其文本源自维基百科人工编辑记录、Reddit平台子论坛及乌克兰社交媒体语料UberText 2.0。维基百科部分采用API提取六个月内的新人任务校对类编辑,Reddit与UberText部分则通过GPT-4o-mini模型进行自动化三阶段校正:首先生成多语言指令模板,接着生成多样修正候选,最终聚合为统一修正结果。数据经过长度筛选、内容审核及格式清理,确保质量与一致性。

特点

该数据集以多语言覆盖与银标准标注为核心特点,包含捷克语、英语、爱沙尼亚语等十一种语言,弥补了非英语语法校正资源短缺的问题。其子语料规模差异显著:维基百科部分平均每语言1.6千样本,Reddit部分达13百万词符,乌克兰语社交媒体部分独占22百万词符。数据兼具人工修正的真实性与合成修正的高产量,且通过自动指标(如ERRANT、GLEU)与人工评分(1-5级)进行质量验证,展现了对复杂语法错误的广泛覆盖与跨语言一致性。

使用方法

OmniGEC适用于训练与评估多语言语法纠错模型,尤其支持段落级纠错任务。使用者可通过Hugging Face平台获取数据,按语言或语料子集划分进行实验。典型应用包括微调大语言模型(如Aya-Expanse或Gemma-3),采用低秩适应(LoRA)技术提升跨语言性能。评估时需结合MultiGEC-2025共享任务的GLEU指标框架,并可利用其多参考修正输出进行消融研究,以探索数据质量与数量对模型性能的影响。

背景与挑战

背景概述

OmniGEC数据集由乌克兰天主教大学与Grammarly研究团队于2025年联合发布,致力于解决多语言语法纠错(GEC)任务中低资源语言数据匮乏的核心问题。该数据集覆盖捷克语、英语、乌克兰语等11种语言,融合维基百科人工编辑与Reddit、UberText 2.0语料的自动纠正数据,通过GPT-4o-mini模型生成银级标注。其创新性在于首次系统性地整合多源跨语言文本,为非英语语法纠错模型训练提供了大规模基准,显著推动了教育技术与自然语言处理领域的多语言适应性研究。

当前挑战

多语言语法纠错面临双重挑战:领域层面需克服低资源语言语法结构复杂性导致的模型泛化困难,以及英语中心化方法在跨语言迁移中的偏差问题;构建过程中,维基百科编辑存在非语法类信息更新与领域特异性干扰,自动生成的Reddit数据需应对内容安全过滤与过度纠错风险,而跨语言提示工程与多修正聚合策略亦对标注一致性提出更高要求。

常用场景

经典使用场景

在自然语言处理领域,OmniGEC数据集被广泛用于多语言语法纠错模型的训练与评估,尤其适用于跨语言迁移学习研究。该数据集通过整合维基百科人工编辑数据与社交媒体自动标注数据,为研究者提供了丰富的错误-修正对照样本,支持模型在真实文本场景下进行语法规范性学习。

解决学术问题

OmniGEC有效缓解了非英语语言语法纠错研究中高质量标注数据匮乏的问题,为低资源语言如乌克兰语、爱沙尼亚语等提供了大规模银标数据。其通过GPT-4o-mini生成的合成修正数据,显著提升了跨语言语法纠错模型的泛化能力,并在MultiGEC-2025评测中推动段落级纠错性能达到新标杆。

衍生相关工作

基于OmniGEC衍生的经典工作包括:采用LoRA微调技术的Aya-Expanse与Gemma-3多语言纠错模型,其在MultiGEC-2025任务中刷新了段落级纠错性能记录;后续研究进一步探索了多语言偏好优化(DPO)方法,并构建了面向乌克兰语的专用语法纠错系统Spivavtor。

以上内容由AI搜集并总结生成