bigai-nlco/LooGLE

收藏Hugging Face2025-02-06 更新2024-06-25 收录

下载链接:

https://hf-mirror.com/datasets/bigai-nlco/LooGLE

下载链接

链接失效反馈资源简介:

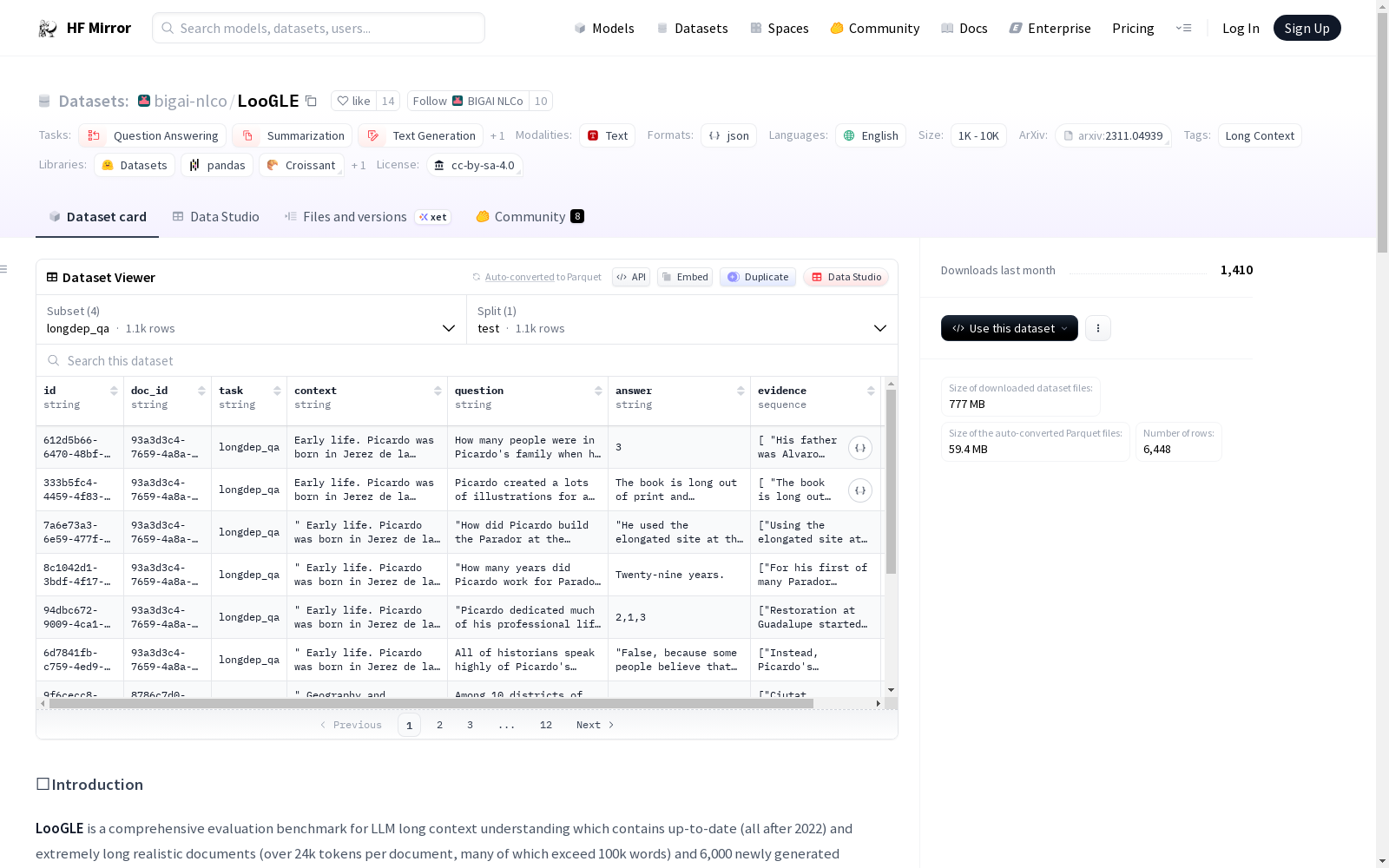

LooGLE是一个用于评估大语言模型(LLM)长上下文理解能力的综合基准。它包含最新的(2022年后)且极长的现实文档(每个文档超过24k个token,许多超过100k字)以及6000个新生成的问题,涵盖多个领域和类别。数据集设计了7个主要任务来评估LLM对短依赖和长依赖内容的理解能力,特别是长依赖任务需要理解跨多个证据片段的内容。数据集还提供了基于语义相似度、GPT4作为判断和人工评估的自动指标,以获取更全面和一般性的结果。

LooGLE是一个用于评估大语言模型(LLM)长上下文理解能力的综合基准。它包含最新的(2022年后)且极长的现实文档(每个文档超过24k个token,许多超过100k字)以及6000个新生成的问题,涵盖多个领域和类别。数据集设计了7个主要任务来评估LLM对短依赖和长依赖内容的理解能力,特别是长依赖任务需要理解跨多个证据片段的内容。数据集还提供了基于语义相似度、GPT4作为判断和人工评估的自动指标,以获取更全面和一般性的结果。

提供机构:

bigai-nlco

原始信息汇总

数据集概述

基本信息

- 语言: 英语和中文

- 许可证: CC-BY-SA-4.0

- 任务类别: 问答、摘要、文本生成、填空

- 标签: 长上下文

数据集详情

- 配置名称: shortdep_qa

- 特征:

input: 字符串类型title: 字符串类型qa_pairs: 字符串类型output: 字符串类型

- 分割:

test: 105个样本,10629114字节

- 下载大小: 5740706字节

- 数据集大小: 10629114字节

数据文件

- 配置名称: shortdep_qa

- 数据文件:

split: testpath: shortdep_qa/test-*

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,长文本理解能力是评估大语言模型性能的关键维度。LooGLE数据集的构建采用了精心设计的策略,其文档均源自2022年后的现实世界长文本,平均长度超过24,000个标记,部分文档甚至超越十万词汇。该数据集通过人工标注与自动化流程相结合的方式,生成了涵盖七个主要任务的六千个问题,特别注重短依赖与长依赖任务的平衡。长依赖任务被定义为需要模型理解分散在全文各处、跨度广泛的多个证据片段之间的相互关联,具体包括理解与推理、计算、时间线重排、多重信息检索以及摘要生成五类,从而系统性地构建了评估框架。

特点

LooGLE数据集的核心特征在于其内容的时效性与任务的多样性。所有文档均具有极强的现实性且为最新资料,确保了评估环境与当前信息世界同步。数据集通过短依赖与长依赖任务的精细划分,全面检验模型在不同信息关联强度下的理解能力。其评估体系亦颇具特色,不仅依赖基于语义相似度的自动指标,还融入了GPT-4作为评判者以及人工评估,旨在提供多维度、更普适的性能参考。这些特点共同使LooGLE成为一个系统而全面的长上下文理解基准。

使用方法

研究人员可通过Hugging Face平台便捷地获取LooGLE数据集以进行模型评估。使用该数据集时,需利用`datasets`库加载指定的配置,如`shortdep_qa`、`longdep_qa`等,并统一在测试集分割上进行操作。数据均被标准化为包含上下文、问题、答案、证据及元数据等关键字段的JSON格式,确保了评估流程的一致性。对于长依赖问答数据,额外增加的`type`键有助于区分不同的任务子类。用户可依据此标准化结构,将数据输入待测模型,并综合运用数据集提供的多种评估方案来衡量模型在长上下文理解方面的实际表现。

背景与挑战

背景概述

随着大语言模型在自然语言处理领域的广泛应用,其长上下文理解能力逐渐成为评估模型性能的关键维度。LooGLE数据集由北京通用人工智能研究院(BIGAI)的研究团队于2023年创建,旨在系统评估大语言模型在超长文本(超过24,000个标记)中的理解与推理能力。该数据集涵盖了问答、摘要、文本生成等多种任务,特别设计了短依赖与长依赖任务,以检验模型对局部信息与跨文档全局依赖关系的处理效果。LooGLE的构建基于2022年后的最新现实文档,涉及多领域内容,为长上下文模型的研究提供了标准化、全面的评估基准,推动了模型向“真实长上下文理解”方向的发展。

当前挑战

LooGLE数据集致力于解决大语言模型在长上下文理解中的核心挑战,包括模型对跨文档广泛分布证据的关联推理、时序信息重组、多信息检索及复杂计算等任务的性能评估。在构建过程中,研究团队面临文档长度极端化带来的标注复杂性,需确保问题与证据在超长文本中的精确对应;同时,设计涵盖多样化领域与任务类型的平衡性数据集,避免偏差影响评估的普适性。此外,评估体系需整合自动语义相似度度量、GPT-4作为评判者及人工评估等多重方法,以保障结果的可信度与全面性。

常用场景

经典使用场景

在自然语言处理领域,长文本理解一直是模型能力评估的关键挑战。LooGLE数据集通过提供超过24k令牌的极长现实文档,为评估大语言模型的长上下文理解能力提供了经典场景。该数据集精心设计了包括理解与推理、计算、时间线重排、多信息检索及摘要生成在内的七项任务,全面覆盖了短依赖与长依赖内容的理解需求,成为衡量模型在复杂文档中提取和整合信息能力的标准测试平台。

解决学术问题

LooGLE数据集有效解决了长上下文语言模型评估中缺乏系统性基准的学术问题。传统评估往往局限于短文本或合成数据,难以反映模型在真实长文档中的表现。该数据集通过引入基于语义相似度的自动度量、GPT-4作为评判以及人工评估的多维评估框架,为模型在跨文档广泛证据依赖任务中的性能提供了可靠度量。这不仅推动了长上下文理解技术的发展,还为模型优化方向提供了实证依据。

衍生相关工作

围绕LooGLE数据集,学术界衍生了一系列关注长上下文理解的经典研究工作。这些工作主要集中于改进Transformer架构的位置编码机制、优化注意力计算效率以及探索外部记忆增强方法。例如,基于Flash Attention和位置插值技术的模型优化,旨在突破传统模型在长序列处理中的计算瓶颈。同时,该数据集也促进了针对长依赖任务的微调策略研究,推动了模型向“真实长上下文理解”目标的演进。

以上内容由遇见数据集搜集并总结生成