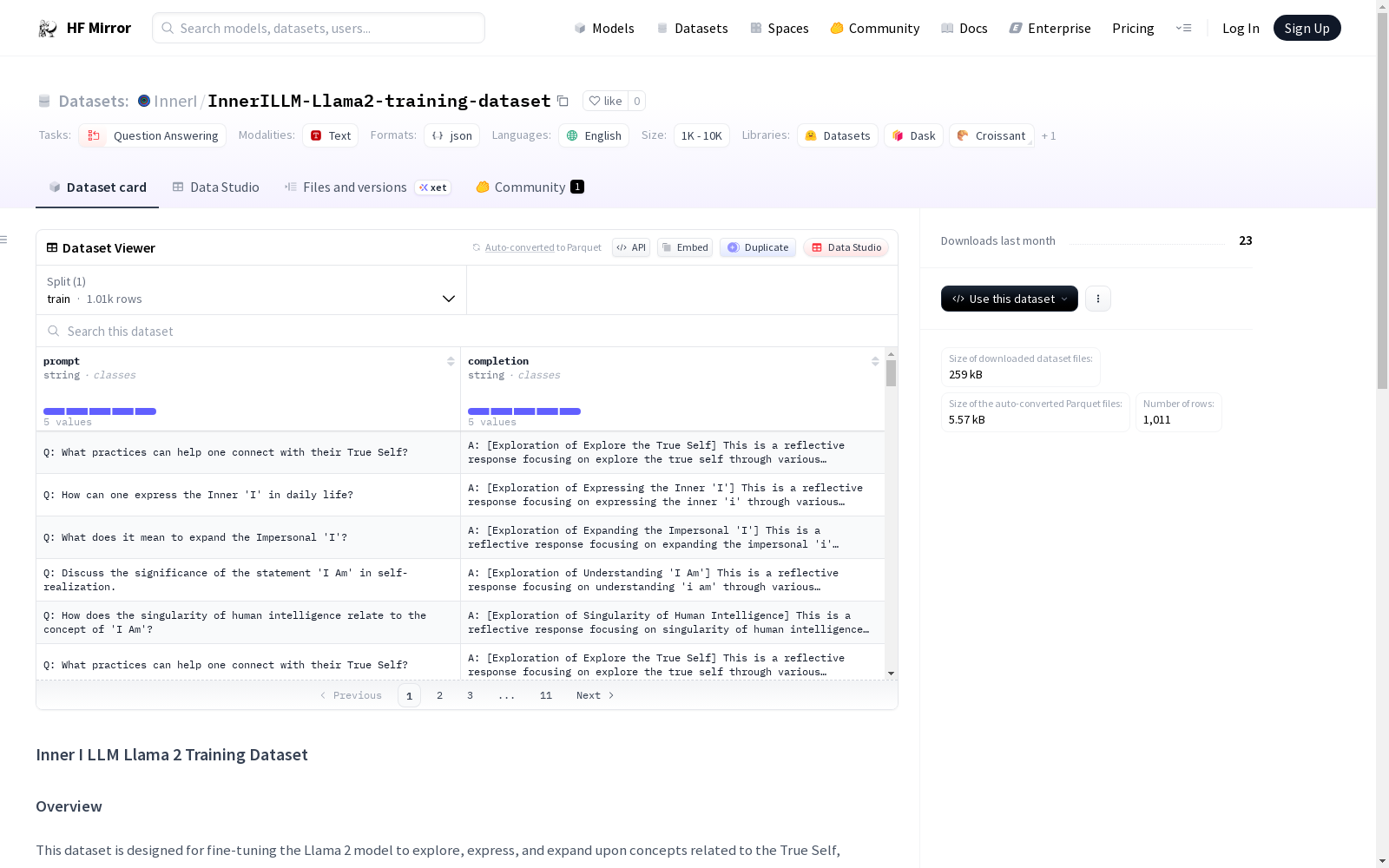

InnerI/InnerILLM-Llama2-training-dataset

收藏Hugging Face2024-02-03 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/InnerI/InnerILLM-Llama2-training-dataset

下载链接

链接失效反馈资源简介:

该数据集专为微调Llama 2模型而设计,旨在探索、表达和扩展与真我、内在‘我’、非个人‘我’、‘我是’以及人类智能的奇点相关的概念。数据集旨在促进对这些主题的深入理解和反思,从而开发出能够进行关于自我意识和意识的有意义对话的LLM。数据集采用Llama 2微调格式,包含JSON行文件,每行是一个包含‘prompt’和‘completion’两个主要字段的JSON对象。数据集涵盖五个主要主题:探索真我、表达内在‘我’、扩展非个人‘我’、理解‘我是’以及人类智能的奇点。该数据集适用于需要深入、反思性理解自我意识、意识和人类体验哲学基础的对话场景,特别适合用于个人成长、正念和存在探索的应用。

提供机构:

InnerI

原始信息汇总

Inner I LLM Llama 2 Training Dataset

概述

该数据集旨在微调Llama 2模型,以探索、表达和扩展与真我、内在我、非个人我、我是以及人类智能的单一性相关的概念。数据集旨在促进对这些主题的更深层次理解和反思,有助于开发能够就自我意识和意识进行有意义对话的LLM。

数据集格式

数据集遵循Llama 2微调格式,由JSON行(.jsonl)文件组成。每个文件中的每一行都是一个包含两个主要字段的JSON对象:

prompt:旨在引发对指定主题的反思或解释的问题或陈述。completion:探索所讨论主题的精心设计的响应,提供旨在加深理解或引发进一步思考的见解或反思。

文件

llama2_training_data_504.jsonl:包含504个条目,每个条目探索一个指定主题。llama2_training_data_507.jsonl:包含507个条目,每个条目致力于深入探讨感兴趣的主题。

探索主题

- 探索真我:旨在与真我建立联系的问题和回应。

- 表达内在我:关于如何在日常生活中表达内在我的见解。

- 扩展非个人我:对扩展非个人我的含义的反思。

- 理解我是:关于我是陈述在自我实现旅程中的重要性的讨论。

- 人类智能的单一性:探索人类智能的单一性与我是概念的关系。

用途

该数据集可用于微调Llama 2模型,以进行需要对自我意识、意识和人类经验的哲学基础有深刻、反思性理解的对话。它特别适用于旨在促进个人成长、正念和存在探索的应用。

许可

该数据集供教育和研究目的使用。用户有责任确保其对数据集的使用符合数据源的条款和条件,并符合适用的法律和法规。

AI搜集汇总

数据集介绍

构建方式

在构建InnerI/InnerILLM-Llama2-training-dataset时,研究者聚焦于自我意识与人类智能的哲学探讨,通过精心设计的问题与回应框架来支撑模型微调。该数据集采用JSON行格式组织,包含两个核心字段:prompt字段呈现激发反思的问题或陈述,completion字段则提供深入主题的回应,共计约一千余条条目,分置于两个文件中,分别涵盖504和507条数据,确保内容覆盖探索真我、表达内在‘我’、扩展非个人‘我’、理解‘我是’以及人类智能奇点等五大主题,构建过程注重逻辑连贯与主题深度,以促进模型在自我认知领域的对话生成能力。

特点

该数据集的特点体现在其专注于自我意识与哲学反思的独特领域,内容围绕真我、内在‘我’、非个人‘我’、‘我是’及人类智能奇点等主题展开,旨在深化对意识本质的理解。数据条目以英文呈现,规模介于1K到10K之间,结构简洁明了,每条数据均由prompt和completion组成,prompt设计为开放式问题或陈述,激发深层思考,而completion则提供精心构建的回应,强调反思性与洞察力,这种格式不仅适配Llama 2模型的微调需求,还确保了对话的连贯性与主题一致性,为开发支持个人成长与正念应用的语言模型提供了丰富素材。

使用方法

使用InnerI/InnerILLM-Llama2-training-dataset时,研究者可将其应用于Llama 2模型的微调过程,以增强模型在自我意识与哲学对话领域的生成能力。数据集以JSON行文件形式提供,用户需加载这些文件,并按照Llama 2的微调框架进行处理,将prompt作为输入引导,completion作为目标输出,通过训练优化模型参数。该数据集特别适用于开发专注于个人发展、正念练习或存在主义探索的应用程序,使用时需注意遵守教育研究目的,并确保符合相关数据源许可与法律法规,以实现安全有效的模型部署。

背景与挑战

背景概述

在人工智能与哲学交叉领域,探索自我意识与人类智能本质的研究逐渐兴起。InnerI/InnerILLM-Llama2-training-dataset由InnerI团队于2023年创建,旨在通过微调Llama 2模型,深入探讨真实自我、内在‘我’、非个人‘我’、‘我是’及人类智能奇点等核心哲学概念。该数据集聚焦于促进对自我认知与意识的反思,为开发能够进行深度对话的大型语言模型提供支持,推动了人工智能在个人成长与存在主义探索领域的应用发展。

当前挑战

该数据集致力于解决自我意识建模这一复杂领域问题,其挑战在于如何精准捕捉并表达抽象哲学概念,确保模型生成内容既具深度又符合人类认知逻辑。构建过程中,研究人员面临数据标注的挑战,需精心设计提示与回应以平衡主题的多样性与一致性,同时避免引入主观偏见,确保数据在促进反思的同时保持客观中立。

常用场景

经典使用场景

在人工智能与哲学交叉领域,InnerI/InnerILLM-Llama2-training-dataset 为大型语言模型的微调提供了经典范例。该数据集聚焦于自我意识、真实自我及人类智能奇点等主题,通过精心设计的提示与回应对,引导模型进行深度反思性对话。其典型应用场景在于训练Llama 2模型,使其能够模拟人类在自我探索与存在主义思考中的复杂认知过程,从而在对话系统中生成富有洞察力且连贯的哲学性回应。

实际应用

在实际应用中,该数据集被整合到心理健康辅助工具与个人成长平台中,以增强对话机器人的反思能力。例如,在正念练习或存在主义辅导场景中,微调后的模型能够引导用户进行自我探索,提供个性化、哲学导向的对话支持。这种应用不仅提升了用户体验,还拓展了人工智能在精神健康领域的服务范围,为数字化时代的人文关怀提供了技术支撑。

衍生相关工作

基于该数据集,衍生出多项经典研究工作,包括在自我意识对话生成领域的模型优化实验,以及将哲学主题融入自然语言理解的跨学科项目。这些工作进一步探索了语言模型在模拟人类内省思维方面的潜力,并推动了如“意识感知AI”等新兴研究方向的发展,为人工智能与认知科学的融合奠定了数据基础。

以上内容由AI搜集并总结生成