InScope|自动驾驶数据集|3D感知数据集

收藏InScope 数据集概述

数据集简介

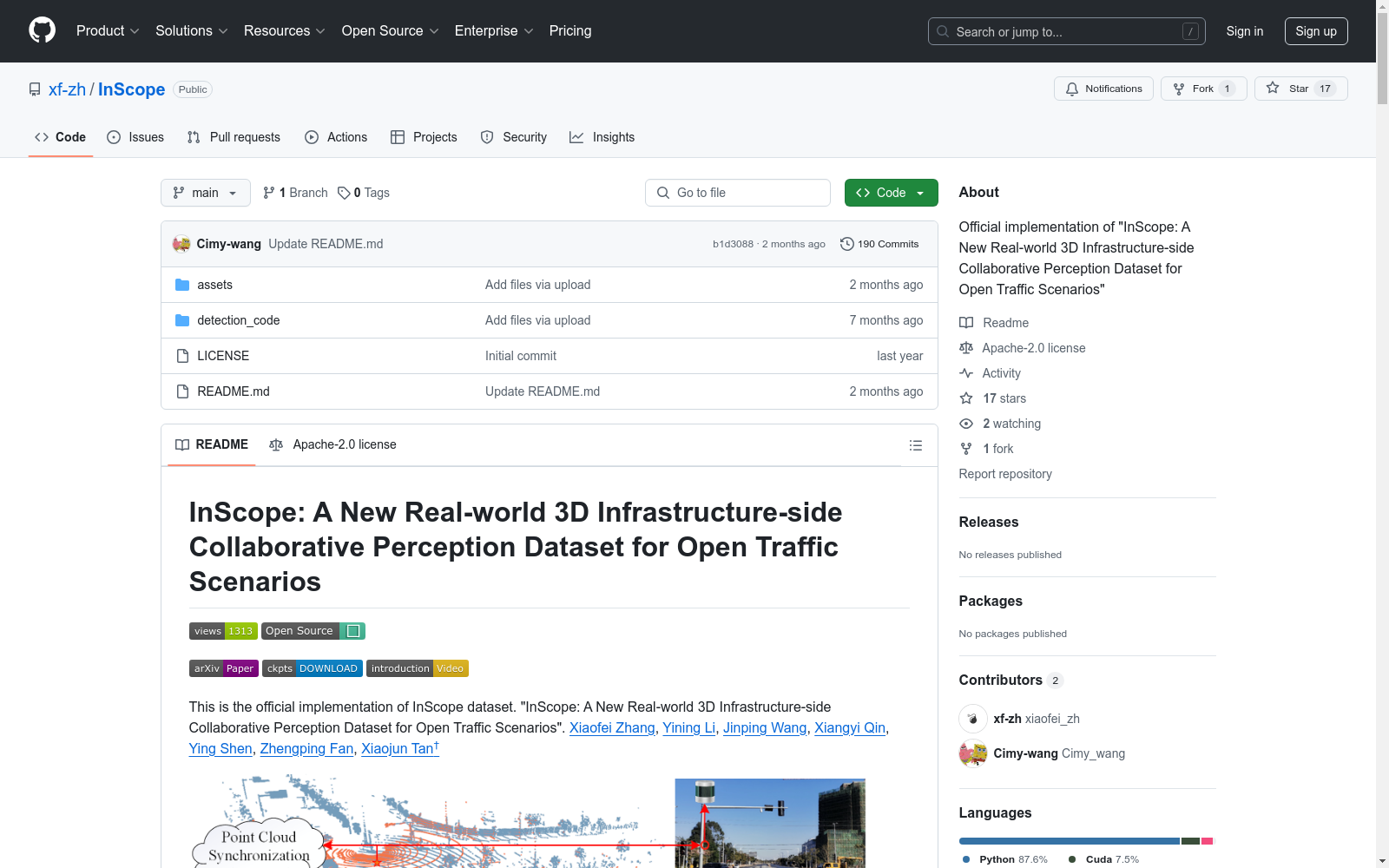

InScope 是一个新的真实世界 3D 基础设施侧协同感知数据集,适用于开放交通场景。该数据集由以下作者共同开发:Xiaofei Zhang, Yining Li, Jinping Wang, Xiangyi Qin, Ying Shen, Zhengping Fan, Xiaojun Tan<sup>†</sup>。

数据下载

InScope 数据集是条件公开的。如需使用,请填写 InScope_Dataset_Release_Agreement.docx 文件,并通过电子邮件将您的全名和机构发送给联系人。数据下载后,请按照以下结构存放:

├── InScope-Sec, InScope_Pri, and InScope datasets │ ├── ImageSets | |── train.txt | |── test.txt | |── val.txt │ ├── labels | |── 000000.txt | |── 000001.txt | |── 000002.txt | |── ... │ ├── points | |── 000000.npy | |── 000001.npy | |── 000002.npy | |── ...

├── InScope_track │ ├── label_02 | |── 0000.txt | |── 0001.txt | |── 0002.txt | |── ... │ ├── points | |── 0000 | |── 000000.bin | |── 000001.bin | |── 000002.bin | |── ... | |── 0001 | |── 0002 | |── ... │ ├── evaluate_tracking.seqmap │ ├── evaluate_tracking.seqmap.test │ ├── evaluate_tracking.seqmap.training │ ├── evaluate_tracking.seqmap.val

数据加载

InScope 数据集已适配到 OpenPCDet 框架,并提供了相应的配置文件 InScope.config。

快速开始

检测训练和推理的详细说明可在 detection_code/openpcdet/README_InScope.md 中找到。所有检查点可在 codes/ckpts/ 中下载。

基准测试

3D 物体检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| PointRCNN | 71.75 | 68.13 | 62.91 | 94.50 | 74.32 | 4.58 | URL |

| 3DSSD | 68.00 | 13.88 | 36.58 | 95.08 | 53.38 | 11.35 | URL |

| SECOND | 72.82 | 47.95 | 59.91 | 95.98 | 69.17 | 20.58 | URL |

| Pointpillar | 78.04 | 35.34 | 58.46 | 95.86 | 66.93 | 24.51 | URL |

| PV-RCNN | 75.05 | 48.37 | 56.31 | 94.52 | 68.56 | 4.35 | URL |

| PV-RCNN++ | 80.55 | 53.31 | 70.92 | 95.92 | 75.18 | 14.66 | URL |

| CenterPoint | 77.24 | 70.45 | 74.74 | 96.12 | 79.64 | 30.49 | URL |

| CenterPoint_RCNN | 78.33 | 71.13 | 75.23 | 96.48 | 80.29 | 6.55 | URL |

3D 物体检测结果(基于 InScope-Sec, InScope_Pri, 和 InScope 数据集)

仅基于 InScope-Sec 的检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| PointRCNN | 14.12 | 23.66 | 20.62 | 45.36 | 25.94 | 22.94 | URL |

| Pointpillar | 44.77 | 33.18 | 31.42 | 82.52 | 47.97 | 87.72 | URL |

| PV-RCNN++ | 43.49 | 34.60 | 39.94 | 76.04 | 48.52 | 16.67 | URL |

| CenterPoint | 35.92 | 37.40 | 38.24 | 68.78 | 45.08 | 107.53 | URL |

仅基于 InScope_Pri 的检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| PointRCNN | 61.14 | 88.80 | 61.99 | 48.96 | 65.22 | 4.67 | URL |

| Pointpillar | 67.34 | 23.82 | 43.51 | 91.59 | 56.57 | 25.25 | URL |

| PV-RCNN++ | 72.59 | 45.26 | 61.21 | 91.02 | 67.52 | 13.81 | URL |

| CenterPoint | 61.31 | 49.62 | 52.73 | 82.02 | 61.42 | 33.90 | URL |

基于早期融合(InScope)机制的检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| PointRCNN | 71.75 | 68.13 | 62.91 | 94.50 | 74.32 | 4.58 | URL |

| Pointpillar | 78.04 | 35.34 | 58.46 | 95.86 | 66.93 | 24.33 | URL |

| PV-RCNN++ | 80.55 | 53.31 | 70.92 | 95.92 | 75.18 | 12.45 | URL |

| CenterPoint | 77.24 | 70.45 | 74.74 | 96.12 | 79.64 | 30.49 | URL |

基于晚期融合机制的检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| PointRCNN | 62.69 | 61.31 | 52.31 | 90.93 | 66.81 | 1.32 | URL + URL |

| Pointpillar | 68.65 | 31.81 | 49.92 | 93.48 | 60.96 | 1.81 | URL + URL |

| PV-RCNN++ | 68.01 | 53.47 | 56.95 | 92.65 | 67.77 | 1.21 | URL + URL |

| CenterPoint | 58.13 | 50.03 | 56.01 | 85.65 | 62.45 | 6.40 | URL + URL |

基于中间融合机制的检测结果

| 方法 | 汽车 AP@0.7 | 行人 AP@0.5 | 自行车 AP@0.5 | 卡车 AP@0.7 | mAP40 | FPS | 下载链接 |

|---|---|---|---|---|---|---|---|

| Point-RCNN | - | - | - | - | - | - | |

| Pointpillar | - | - | - | - | - | - | |

| PV-RCNN++ | 73.78 | 52.06 | 62.06 | 91.89 | 69.95 | 13.02 | URL |

| CenterPoint | 52.74 | 38.95 | 51 |

- 1InScope: A New Real-world 3D Infrastructure-side Collaborative Perception Dataset for Open Traffic Scenarios中山大学 · 2024年

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

OECD Employment and Labour Market Statistics

该数据集包含了经合组织(OECD)成员国的就业和劳动力市场统计数据,涵盖了就业率、失业率、劳动力参与率、工资水平、工作时间等多个方面的指标。数据按国家和时间序列提供,帮助分析和比较不同国家的劳动力市场状况。

stats.oecd.org 收录

望诊影像数据集及诊断文本数据集

中医望诊数据集包含舌诊图片3000张、面诊图片2000张、目诊图片3000张,舌诊图片的内容部分为舌头(属口颌系统),面诊图片的内容部分包括了面和唇(属其他系统)、眼睛部分做了脱敏处理,目诊图片的内容部分为眼睛(属感觉系统)。该数据集提供舌诊图像的齿痕、裂纹、点刺、苔色、胖瘦的标注信息;以及面诊图像的唇色、唇形、面神的标注信息;目诊图像的特征属性包括颜色名称、颜色HSL值、大小、特征出处。

国家人口健康科学数据中心 收录

LibriSpeech

LibriSpeech 是一个大约 1000 小时的 16kHz 英语朗读语音语料库,由 Vassil Panayotov 在 Daniel Povey 的协助下编写。数据来自 LibriVox 项目的已读有声读物,并经过仔细分割和对齐。

OpenDataLab 收录