CLEVA

收藏github2023-08-01 更新2025-02-07 收录

下载链接:

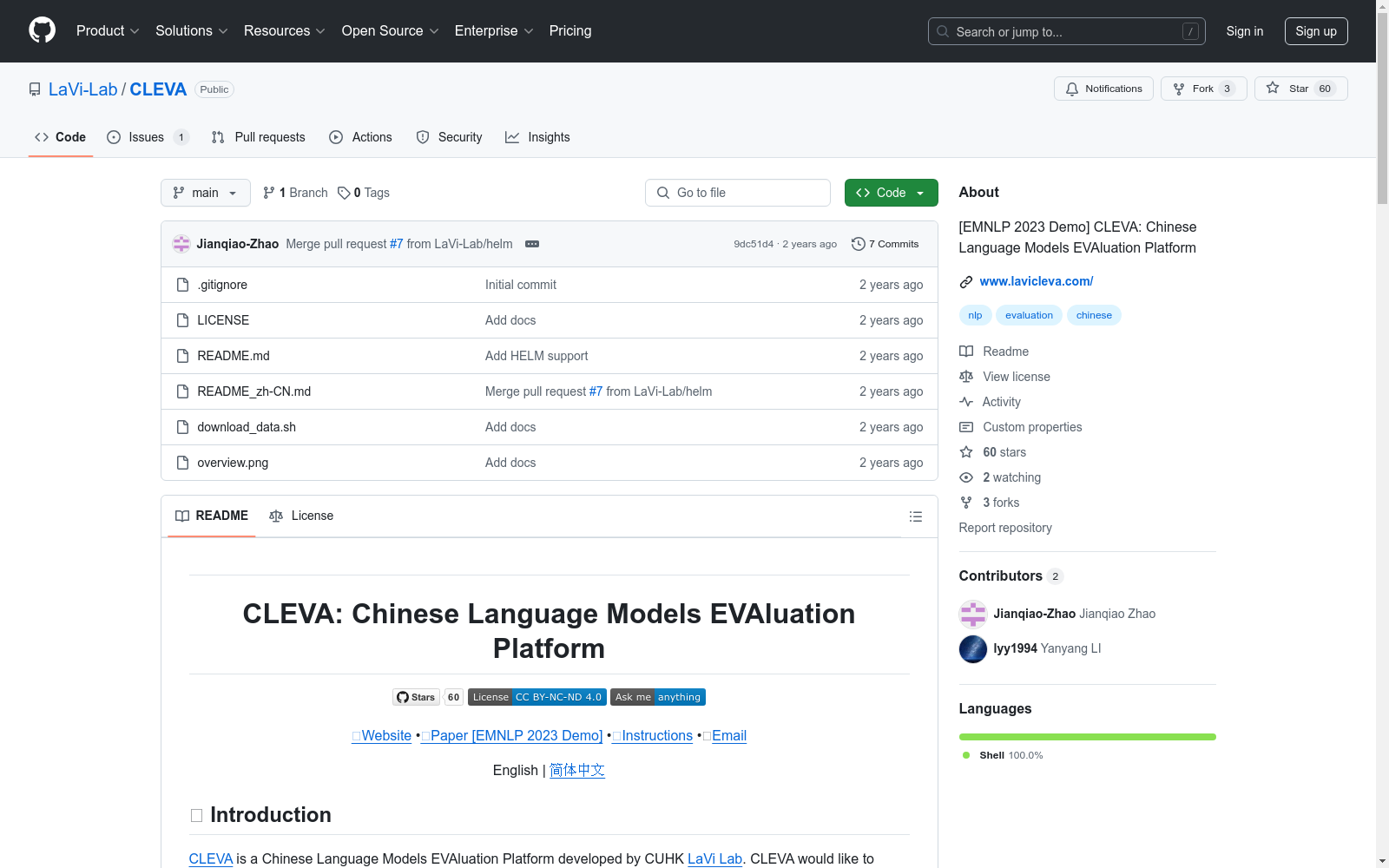

https://github.com/LaVi-Lab/CLEVA

下载链接

链接失效反馈资源简介:

CLEVA数据集作为中文多任务评估的基准,包含37万个测试样本。其中约33.98%是新生成的,解决了数据泄露相关的问题。该数据集涵盖11项应用评估任务和20项能力评估任务,所有数据均采用一致的预处理和标准化的中文提示模板。

The CLEVA dataset serves as a benchmark for multi-task Chinese evaluation, containing 370,000 test samples. Approximately 33.98% of these are newly generated, addressing the issue of data leakage. The dataset encompasses 11 application evaluation tasks and 20 capability evaluation tasks, with all data processed using a consistent pre-processing and standardized Chinese prompt template.

提供机构:

香港中文大学等

创建时间:

2023-08-01

原始信息汇总

CLEVA: 中文语言模型评估平台

数据集概述

- 名称: CLEVA (Chinese Language Models EVAluation Platform)

- 开发团队: 香港中文大学LaVi Lab与上海人工智能实验室合作开发

- 论文: EMNLP 2023 Demo

- 许可证: CC BY-NC-ND 4.0

- 最新动态: 2024-12-06发布C²LEVA双语基准测试

核心特性

-

中文基准测试

- 包含31项任务(11项应用评估+20项能力评估)

- 总计370K中文测试样本(33.98%为新收集数据)

- 有效缓解数据污染问题

-

标准化评估方法

- 统一的数据预处理流程

- 使用一致的中文提示模板集

-

可信排行榜

- 采用新测试数据进行评估

- 定期组织模型评估

- 历史评估数据开放下载

技术实现

- 集成平台: 已整合至HELM评估框架

- 评估参数:

task: 31项任务中的任一项subtask: 任务子类别prompt_id: 提示模板索引version: 数据集版本(当前仅v1)data_augmentation: 数据增强策略(cleva/cleva_robustness/cleva_fairness)

数据获取

-

下载方式: sh bash download_data.sh

-

默认版本: v1

-

输出内容: 包含各任务数据的版本目录

引用规范

bib @misc{li2023cleva, title={CLEVA: Chinese Language Models EVAluation Platform}, author={Yanyang Li and Jianqiao Zhao and Duo Zheng and Zi-Yuan Hu and Zhi Chen and Xiaohui Su and Yongfeng Huang and Shijia Huang and Dahua Lin and Michael R. Lyu and Liwei Wang}, year={2023}, eprint={2308.04813}, archivePrefix={arXiv}, primaryClass={cs.CL} }

注意事项

- 在线评估需联系: clevaplat@gmail.com

- 本地评估推荐使用HELM框架

- 完整参数说明参见HELM文档

AI搜集汇总

数据集介绍

构建方式

CLEVA数据集的构建依托于香港中文大学LaVi实验室与上海人工智能实验室的紧密合作。该数据集通过整合31项任务(包括11项应用评估和20项能力评估任务),共收集了37万条中文测试样本,其中33.98%为新收集数据,有效缓解了数据污染问题。此外,CLEVA采用标准化的基于提示的评估方法,对所有数据进行统一预处理,并使用一致的中文提示模板进行评估。

特点

CLEVA数据集的特点在于其全面性和创新性。它不仅涵盖了广泛的中文语言模型评估任务,还通过引入大量新数据,显著降低了数据污染的风险。数据集中的提示模板经过精心设计,确保了评估的一致性和可重复性。此外,CLEVA还提供了一个可信赖的排行榜,定期更新评估结果,为用户提供了权威的参考。

使用方法

CLEVA数据集的使用方法灵活多样,用户可以通过HELM平台进行本地评估。具体操作包括安装Python环境、配置依赖项,并通过命令行运行评估任务。用户可以选择特定任务、子任务和提示模板,自定义评估参数。此外,CLEVA还支持数据下载,用户可将其集成到自己的代码中进行进一步分析。对于在线评估需求,用户需联系CLEVA团队进行认证,并参考相关文档进行API开发。

背景与挑战

背景概述

CLEVA(Chinese Language Models EVAluation Platform)是由香港中文大学LaVi实验室与上海人工智能实验室合作开发的中文语言模型评估平台,旨在为中文自然语言处理领域提供一个全面的评估基准。该平台于2023年推出,并在EMNLP 2023上作为系统演示发布。CLEVA的核心研究问题在于如何系统性地评估中文语言模型的多维度能力,涵盖31项任务,包括应用评估和能力评估,共包含37万条中文测试样本,其中33.98%为新收集数据,有效缓解了数据污染问题。CLEVA的标准化提示词评估方法和可信赖的排行榜为中文语言模型的研究与开发提供了重要支持,推动了中文自然语言处理领域的发展。

当前挑战

CLEVA在构建过程中面临多重挑战。首先,中文语言模型的评估需要覆盖多样化的任务和场景,这对数据集的广度和深度提出了极高要求。CLEVA通过设计31项任务和收集大量新数据来解决这一问题,但数据收集与标注的成本和复杂性仍然较高。其次,数据污染问题在语言模型评估中尤为突出,CLEVA通过引入33.98%的新数据来缓解这一问题,但如何持续更新数据以保持评估的时效性仍是一个长期挑战。此外,标准化评估方法的制定也面临技术难题,尤其是在提示词设计和评估指标的统一性方面,需要平衡灵活性与一致性。最后,CLEVA与HELM的集成虽然提升了平台的可用性,但在跨平台兼容性和本地化评估的优化上仍需进一步探索。

常用场景

经典使用场景

CLEVA数据集在中文语言模型评估领域具有广泛的应用,尤其是在多任务评估和模型性能对比方面。通过其包含的31个任务和370K个测试样本,研究人员能够全面评估模型在中文语言理解、生成、翻译等任务上的表现。其标准化的提示模板和统一的数据预处理流程,确保了评估结果的一致性和可比性。

解决学术问题

CLEVA数据集解决了中文语言模型评估中的数据污染问题,通过引入大量新收集的数据,减少了模型在训练过程中可能接触到的测试数据。此外,其标准化的评估方法为学术界提供了一个可靠的基准,帮助研究人员更准确地衡量模型在中文任务上的能力,推动了中文自然语言处理领域的发展。

衍生相关工作

CLEVA数据集的发布催生了一系列相关研究,尤其是在中文语言模型的鲁棒性和公平性评估方面。许多研究基于CLEVA的数据和评估框架,提出了新的模型优化方法和评估指标。例如,一些工作利用CLEVA的提示模板和数据增强策略,探索了模型在不同语言任务中的泛化能力,进一步推动了中文自然语言处理领域的前沿研究。

以上内容由AI搜集并总结生成