CSEMOTIONS

收藏github2025-08-04 更新2025-08-06 收录

下载链接:

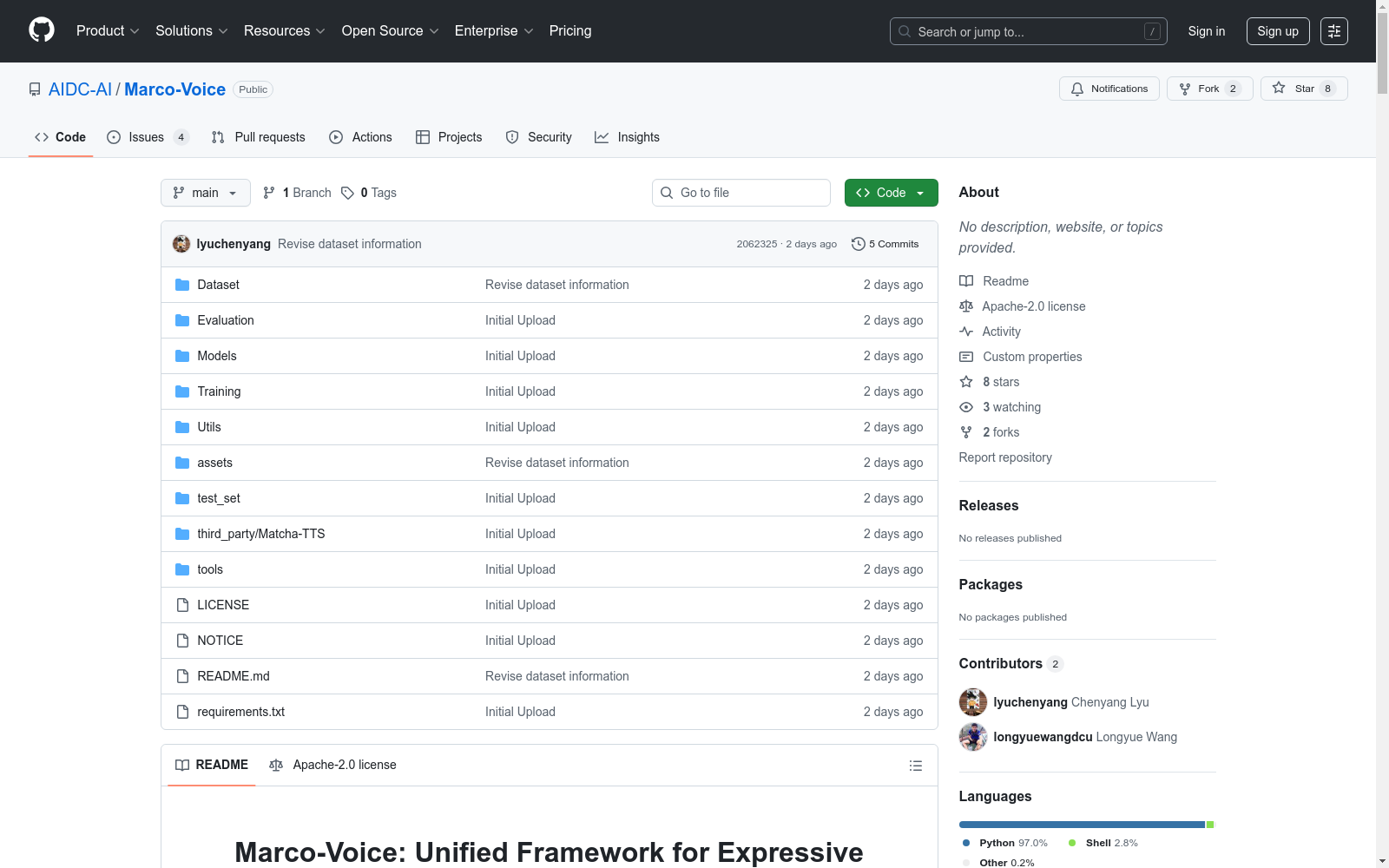

https://github.com/AIDC-AI/Marco-Voice

下载链接

链接失效反馈官方服务:

资源简介:

我们构建了CSEMOTIONS,一个高质量的情感语音数据集,包含大约10小时的普通话语音,来自六位专业母语者(三男三女),所有参与者都有丰富的配音经验。数据集涵盖七种不同的情感类别。所有录音均在专业录音室进行,以确保高音频质量和一致的情感表达。

We have constructed CSEMOTIONS, a high-quality emotional speech dataset containing approximately 10 hours of Mandarin speech from six professional native speakers (three males and three females), all of whom have extensive voice dubbing experience. The dataset covers seven distinct emotion categories. All recordings were conducted in professional recording studios to ensure high audio quality and consistent emotional expression.

创建时间:

2025-07-22

原始信息汇总

Marco-Voice数据集概述

数据集基本信息

- 名称: Marco-Voice

- 类型: 语音合成与语音克隆数据集

- 语言: 主要支持中文(普通话),部分支持英文

- 许可证: Apache License 2.0

核心数据集CSEMOTIONS

基本规格

| 属性 | 规格 |

|---|---|

| 时长 | ~10小时 |

| 说话人 | 10位专业人士(5男,5女) |

| 情感类别 | 中性、快乐、愤怒、悲伤、惊讶、戏谑、恐惧 |

| 采样率 | 48kHz/16bits |

| 录音环境 | 专业录音棚 |

| 评估提示句 | 每种情感100句(中英文) |

情感分布

| 情感标签 | 时长 | 句子数量 |

|---|---|---|

| 悲伤 | 1.73h | 546 |

| 愤怒 | 1.43h | 769 |

| 快乐 | 1.51h | 603 |

| 惊讶 | 1.25h | 508 |

| 恐惧 | 1.92h | 623 |

| 戏谑 | 1.23h | 621 |

| 中性 | 1.14h | 490 |

| 总计 | 10.24h | 4160 |

集成公开数据集

| 数据集 | 时长 | 说话人数量 | 语言 | 情感类型 |

|---|---|---|---|---|

| ESD | 29h | 20 | 中/英文 | 5种 |

| LibriTTS | 585+h | 2,456 | 英文 | 中性 |

| AISHELL-3 | 85h | 218 | 中文 | 中性 |

评估指标

客观评估

-

情感分类准确率(ECA)

- 工具: emotion2vec模型

- 方法: 比较合成语音与真实语音的情感标签一致性

-

词错误率(WER)

- 英文ASR: Whisper-large-v3

- 中文ASR: Paraformer-zh

- 支持语言: 主要中英文

-

说话人相似度(SIM)

- 主要工具: SpeechBrain

- 方法: 计算余弦相似度

-

语音质量(DNS-MOS)

- 工具: DNSMOS

- 范围: 0-5分

主观评估(人工评测)

- 评估维度: 语音清晰度、节奏速度、自然度、整体满意度

- 评分尺度: 1-5分(说话人相似度0-1分)

基准性能

语音克隆评估

| 指标 | Marco-Voice得分 |

|---|---|

| 语音清晰度 | 4.545 |

| 节奏速度 | 4.290 |

| 自然度 | 4.205 |

| 整体满意度 | 4.430 |

| 说话人相似度 | 0.8275 |

情感语音生成评估

| 指标 | Marco-Voice得分 |

|---|---|

| 情感表达 | 4.225 |

| 语音清晰度 | 4.545 |

音频样本

提供7种情感类型的语音样本,包含3位不同说话人演示:

- 中性、快乐、悲伤、愤怒、恐惧、惊讶、戏谑

引用格式

bibtex @article{tian2024marcovoice, title={Marco-Voice Technical Report}, author={Tian, Fengping and Lyu, Chenyang and Ni, Xuanfan and Sun, Haoqin and Li, Qingjuan and Qian, Zhiqiang and Li, Haijun and Wang, Longyue and Xu, Zhao and Luo, Weihua and Zhang, Kaifu}, year={2025}, note={Technical Report}, }

搜集汇总

数据集介绍

构建方式

CSEMOTIONS数据集的构建过程体现了对高质量情感语音数据的系统性采集与标注。该数据集由六位具有专业配音经验的母语人士录制,涵盖七种情感类别(中性、快乐、愤怒、悲伤、惊讶、戏谑、恐惧),在专业录音棚环境中完成10小时48kHz/16bit精度的普通话语音采集。数据构建采用严格的说话人-情感解耦策略,通过设计100条跨情感类别的标准化评估文本,确保每个情感类别的语句数量均衡(总计4160句),并采用旋转情感嵌入方法实现细粒度情感标注。

使用方法

使用该数据集需遵循模块化的数据处理流程。通过提供的Python脚本(prepare_data.py)将原始音频与文本转换为标准化的utt2spk、wav.scp等Kaldi格式文件。训练时可采用两种模式:基础模式通过run_training.sh实现语音克隆与离散情感控制,高级模式(run_training_emosphere.sh)支持连续情感空间建模。评估阶段需调用专用工具链,包括emotion2vec模型计算情感分类准确率(ECA)、SpeechBrain测量说话人相似度(SIM),以及Whisper/Paraformer模型进行多语言WER检测。数据集的JSON接口允许直接指定情感标签和语言ID进行端到端合成。

背景与挑战

背景概述

CSEMOTIONS数据集由Marco-Voice研究团队于2024年构建,旨在推动情感语音合成领域的研究。该数据集包含约10小时的专业录音,涵盖七种情感类别(中性、快乐、愤怒、悲伤、惊讶、戏谑、恐惧),由六位具有丰富配音经验的普通话母语者在专业录音室录制完成。作为Marco-Voice多模态语音合成系统的核心训练资源,该数据集通过高保真的情感标注和跨语言评估框架,显著提升了合成语音的情感表达真实度和说话人身份保持能力,为语音合成领域的情感解耦研究和可控生成技术提供了重要基准。

当前挑战

在情感语音合成领域,CSEMOTIONS数据集主要解决三大核心挑战:一是传统语音合成系统难以实现情感特征与说话人特征的解耦控制;二是跨语言情感迁移中存在的韵律失真问题;三是细粒度情感强度连续调控的技术瓶颈。数据构建过程中面临专业标注成本高昂、情感类别边界模糊等难题,需通过声学特征分析与心理学评估相结合的方式确保标注一致性。此外,数据规模受限导致模型在罕见情感(如恐惧)上的泛化能力不足,需设计基于对比学习的数据增强策略来弥补。

常用场景

经典使用场景

在语音合成与情感计算领域,CSEMOTIONS数据集因其专业级的多情感 Mandarin 语音样本而成为基准测试的首选资源。该数据集最典型的应用场景是训练端到端的神经语音合成系统,特别是需要同时控制音色克隆与情感表达的复杂任务。研究者通过其精细标注的七类情感状态(如愤怒、戏谑等),能够构建具有细粒度情感调节能力的TTS模型,这在影视配音自动生成、虚拟偶像语音定制等场景中展现出独特价值。

解决学术问题

该数据集有效解决了情感语音合成中的两大核心难题:其一,通过专业演员录制的跨情感平行语料,缓解了传统方法中情感特征与说话人特征纠缠的问题;其二,10小时高精度标注的 Mandarin 数据填补了中文多情感语音资源的空白,为跨语言对比研究提供了实验基础。其采用的旋转情感嵌入方法更推动了 disentangled representation learning 在语音领域的发展,使独立控制音色与情感成为可能。

实际应用

在实际产业应用中,CSEMOTIONS支撑的Marco-Voice系统已应用于智能客服情感交互模块,通过动态调整语音情感强度提升用户满意度。教育科技公司则利用其戏谑(Playfulness)类样本开发儿童语言学习助手,而影视后期领域借助精准的愤怒/恐惧样本实现配音自动化。该数据集48kHz的广播级音质更使其成为车载语音系统情感化升级的关键训练数据。

数据集最近研究

最新研究方向

在情感语音合成领域,CSEMOTIONS数据集的最新研究聚焦于多模态情感表达的精细化建模与跨语言迁移学习。该数据集作为高质量普通话情感语音资源,正推动基于对比学习的说话人-情感解耦技术发展,使系统能独立控制音色特征与情感强度。当前前沿探索包括旋转情感嵌入空间的几何优化、低维情感向量的连续调控,以及与预训练语言模型的跨模态对齐。这些技术突破显著提升了合成语音在客服机器人、虚拟偶像等场景中的表现力,为构建更具人性化的人机交互系统提供了关键数据支撑。

以上内容由遇见数据集搜集并总结生成