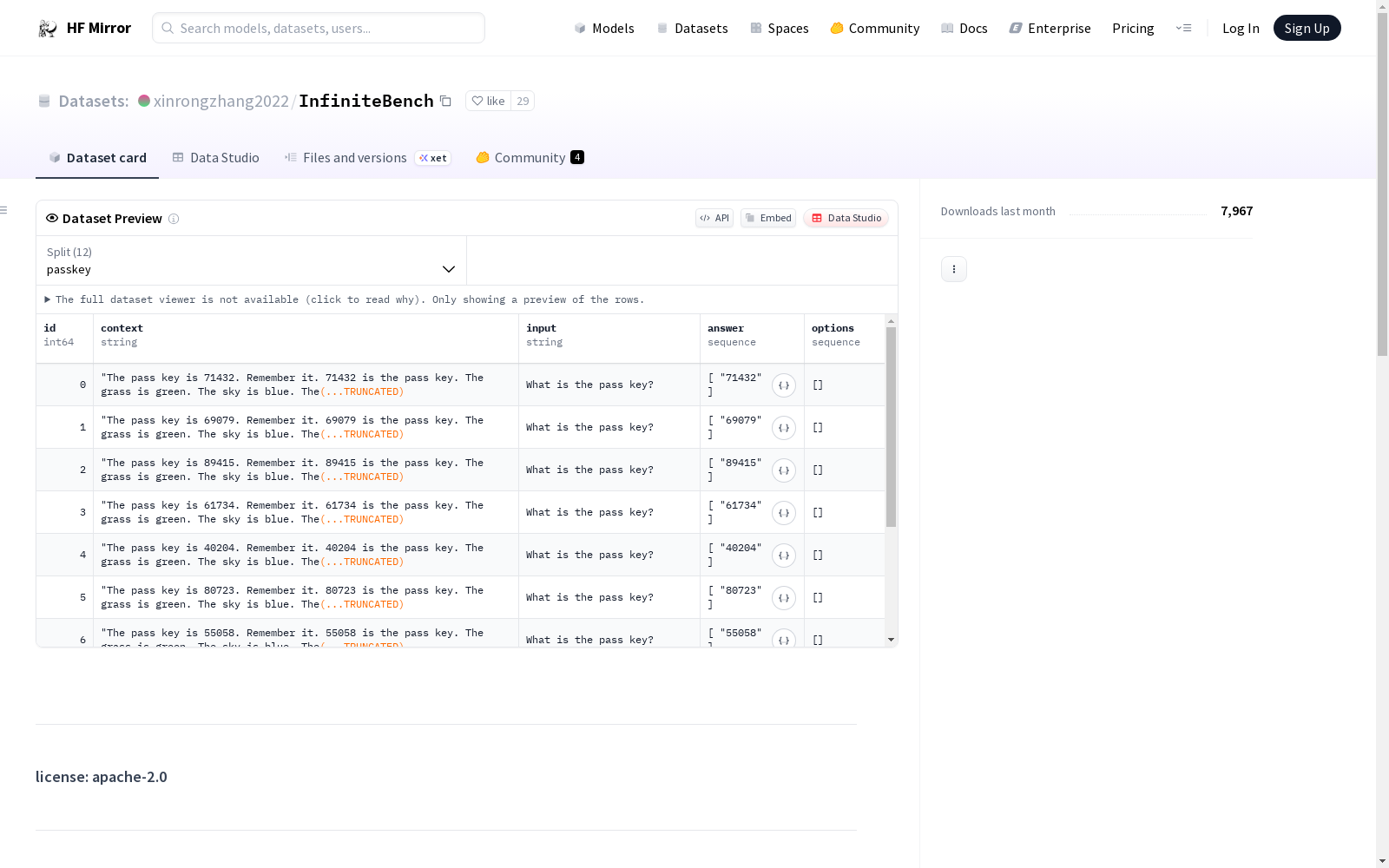

xinrongzhang2022/InfiniteBench

收藏Hugging Face2024-06-02 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/xinrongzhang2022/InfiniteBench

下载链接

链接失效反馈资源简介:

---

configs:

- config_name: default

data_files:

- split: passkey

path: "passkey.jsonl"

- split: kv_retrieval

path: "kv_retrieval.jsonl"

- split: number_string

path: "number_string.jsonl"

- split: code_run

path: "code_run.jsonl"

- split: code_debug

path: "code_debug.jsonl"

- split: math_find

path: "math_find.jsonl"

- split: math_calc

path: "math_calc.jsonl"

- split: longdialogue_qa_eng

path: "longdialogue_qa_eng.jsonl"

- split: longbook_qa_eng

path: "longbook_qa_eng.jsonl"

- split: longbook_sum_eng

path: "longbook_sum_eng.jsonl"

- split: longbook_choice_eng

path: "longbook_choice_eng.jsonl"

- split: longbook_qa_chn

path: "longbook_qa_chn.jsonl"

---

---

license: apache-2.0

---

---

## Citation

Please cite us if you use $\infty$Bench.

```bibtex

@misc{zhang2024inftybench,

title={$\infty$Bench: Extending Long Context Evaluation Beyond 100K Tokens},

author={Xinrong Zhang and Yingfa Chen and Shengding Hu and Zihang Xu and Junhao Chen and Moo Khai Hao and Xu Han and Zhen Leng Thai and Shuo Wang and Zhiyuan Liu and Maosong Sun},

year={2024},

eprint={2402.13718},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

This dataset includes multiple configuration files, each corresponding to different types of data files such as passkey, kv_retrieval, number_string, etc. These data files cover a variety of tasks ranging from simple key-value retrieval to complex mathematical calculations and long text question answering. The purpose of the dataset is to evaluate the performance of models in handling long contexts (beyond 100K tokens).

提供机构:

xinrongzhang2022

原始信息汇总

数据集概述

数据文件配置

- 配置名称: default

- 数据文件列表:

- split: passkey

- 路径: passkey.jsonl

- split: kv_retrieval

- 路径: kv_retrieval.jsonl

- split: number_string

- 路径: number_string.jsonl

- split: code_run

- 路径: code_run.jsonl

- split: code_debug

- 路径: code_debug.jsonl

- split: math_find

- 路径: math_find.jsonl

- split: math_calc

- 路径: math_calc.jsonl

- split: longdialogue_qa_eng

- 路径: longdialogue_qa_eng.jsonl

- split: longbook_qa_eng

- 路径: longbook_qa_eng.jsonl

- split: longbook_sum_eng

- 路径: longbook_sum_eng.jsonl

- split: longbook_choice_eng

- 路径: longbook_choice_eng.jsonl

- split: longbook_qa_chn

- 路径: longbook_qa_chn.jsonl

- split: passkey

搜集汇总

数据集介绍

构建方式

该数据集的构建采取了模块化设计,涵盖多种任务类型,如passkey、kv_retrieval、number_string等,每种任务类型均对应不同的数据文件。这些文件包含了用于训练和评估大型语言模型处理超长文本上下文能力的合成和现实任务数据,任务涉及英语和中文两种语言,旨在要求模型理解长依赖关系,而非简单地从上下文中检索有限的段落。

使用方法

使用该数据集时,用户首先需要定义特征模式,然后利用提供的load_dataset函数加载数据集。加载过程中,用户可以根据需要指定特征模式,以确保数据集的结构与模型的输入要求相匹配。通过适当的数据处理和模型训练流程,研究者可以在InfiniteBench数据集上评估和改进其模型的性能。

背景与挑战

背景概述

在当前自然语言处理领域,大型语言模型(LLM)的长文本处理能力日益受到重视。InfiniteBench数据集,由张鑫荣等人于2024年提出,旨在填补长文本语境评估标准的空白。该数据集的核心研究问题是提升LLM对超过10万 tokens长度的文本处理和推理能力。InfiniteBench包含了英语和中文的多样领域任务,其数据平均长度超过100K tokens,旨在推动长依赖关系的理解和评估。该数据集的发布,对促进LLM的长文本处理技术的发展具有显著影响力和推动作用。

当前挑战

InfiniteBench数据集在构建和应用过程中面临的挑战主要包括:如何准确评估LLM在处理超长文本时的性能,以及如何设计出能够真正考验模型长文本理解和推理能力的任务。此外,数据集的构建也面临了合成任务与实际任务之间的平衡问题,确保数据的质量和多样性,以及如何处理大规模数据集的效率和资源消耗问题。实验结果表明,即使是针对长文本处理优化的LLM,在处理100K+ tokens的文本时仍需显著改进。

常用场景

经典使用场景

在深入探讨大型语言模型处理超长文本能力的研究领域,InfiniteBench数据集以其独特的长文本上下文设计,成为评估模型性能的重要工具。该数据集最经典的使用场景在于,研究者能够利用其提供的超过10万token的长文本上下文,对模型在长距离依赖理解、复杂推理任务上的表现进行深入分析,从而推动大型语言模型在文本理解、生成与交互等领域的应用发展。

解决学术问题

InfiniteBench数据集解决了学术界在长文本处理能力评估方面的迫切需求。在此之前,公共评测基准多集中于1万token左右的文本,这限制了对于模型处理更长文本能力的评估。InfiniteBench的出现,填补了这一空白,为研究长文本上下文中模型的性能瓶颈提供了标准化的测试平台,对于推动长文本处理技术的发展具有重大意义。

实际应用

在实用层面,InfiniteBench数据集的应用广泛。它不仅可以帮助改进文档理解、智能体构建等场景下的语言模型,还可以为信息检索、问答系统、文本摘要等任务提供性能优化的参考。通过该数据集,开发者和研究者可以针对性地优化模型,以满足实际应用中对长文本处理的高标准要求。

数据集最近研究

最新研究方向

在自然语言处理领域,随着大型语言模型(LLM)的不断发展,处理超长文本语境的能力成为评估模型性能的关键指标。针对目前公开基准测试在文本长度上的局限性,xinrongzhang2022/InfiniteBench数据集的提出,填补了长文本语境评估的空白。该数据集包含平均长度超过100K tokens的合成和现实任务,覆盖英语和中文不同领域,旨在测试模型对长依赖关系的理解能力。近期研究利用该数据集对现有长文本语境LLM进行了评估,指出当前模型在处理100K+ tokens长度的文本时仍需显著改进。此外,相关研究还揭示了LLM处理长文本语境时的行为特征,为模型优化提供了重要参考。

以上内容由遇见数据集搜集并总结生成