VStyle

收藏github2025-09-15 更新2025-09-16 收录

下载链接:

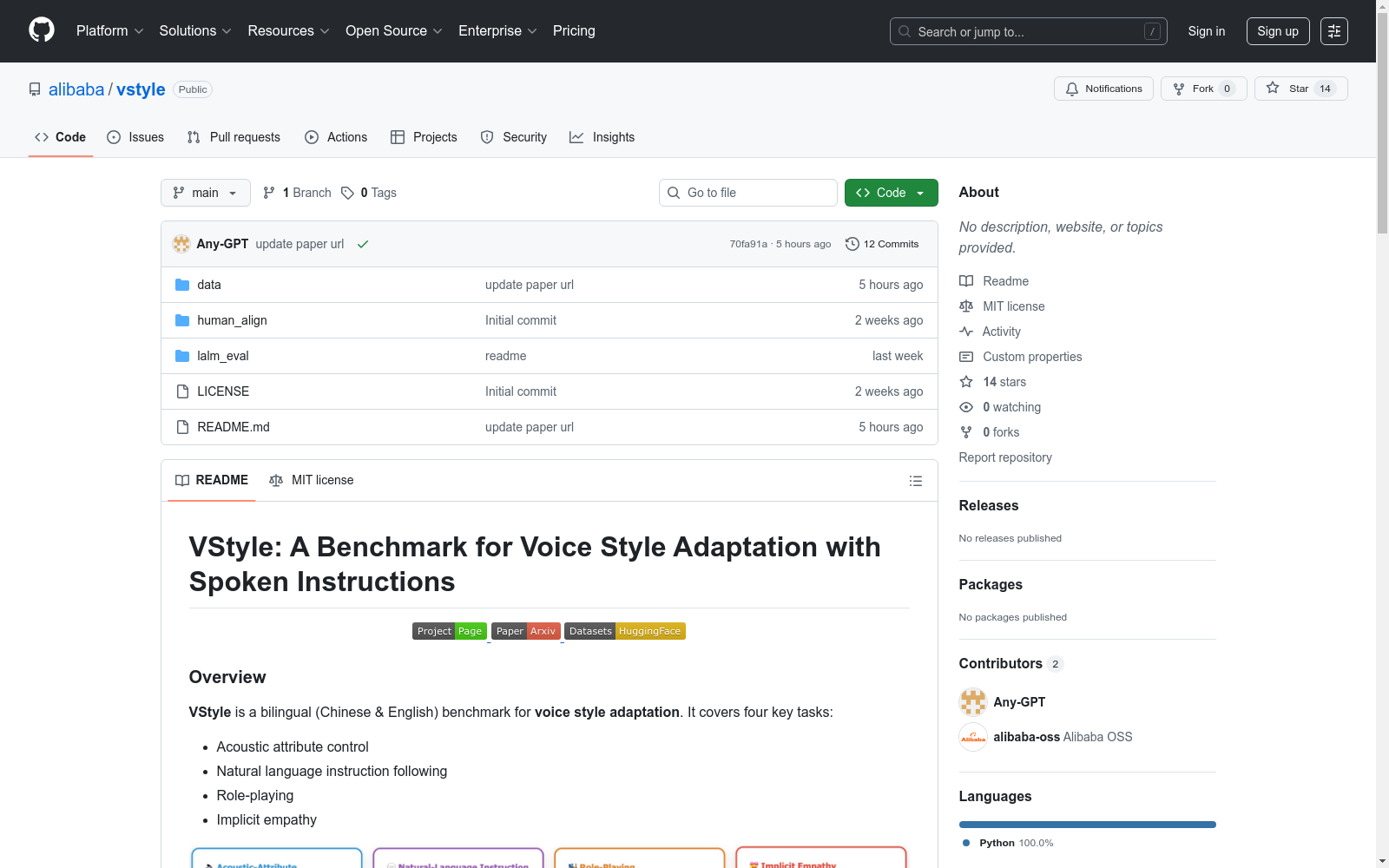

https://github.com/alibaba/vstyle

下载链接

链接失效反馈资源简介:

VStyle是一个双语(中文和英文)语音风格适应基准数据集,涵盖四个关键任务:声学属性控制、自然语言指令跟随、角色扮演和隐式共情。它引入了LALM-as-a-Judge框架,从文本忠实度、风格遵循度和自然度三个维度评估模型输出

VStyle is a bilingual (Chinese and English) benchmark dataset for speech style adaptation, which covers four core tasks: acoustic attribute control, natural language instruction following, role-playing, and implicit empathy. It introduces the LALM-as-a-Judge framework to evaluate model outputs from three dimensions: textual faithfulness, style adherence, and naturalness.

创建时间:

2025-09-02

原始信息汇总

VStyle: 语音风格适应基准数据集

概述

VStyle是一个面向语音风格适应任务的双语(中文和英文)基准数据集,涵盖四个关键任务类型:

- 声学属性控制

- 自然语言指令跟随

- 角色扮演

- 隐式共情

评估框架

采用LALM-as-a-Judge自动化评估框架,从三个维度对模型输出进行评估:

- 文本忠实度(是否表达正确内容)

- 风格遵循度(是否符合目标风格)

- 自然度(是否流畅自然)

数据集内容

- 包含双语语音样本

- 覆盖多种语音风格适应场景

- 提供标准化评估元数据

模型评估结果

评估了多个开源和商业语音语言模型,包括:

- 专有系统:GPT-4o Audio、GPT-4o-Mini Audio、Doubao

- 开源模型:Step-Audio、Kimi-Audio、Baichuan-Audio、Qwen-2.5 Omni

评估工具

提供基于Gemini API的自动化评估工具,支持:

- 音频样本自动处理

- 多维度评分生成

- 综合分析报告输出

数据获取

数据集可通过HuggingFace获取:https://huggingface.co/datasets/zhanjun/VStyle

模型推理结果

其他模型的推理结果参考:https://huggingface.co/datasets/zhanjun/VStyle-responses

人类标注验证

提供人类标注与自动化评估的相关性分析验证,确保评估结果的可靠性

许可证

本项目采用MIT许可证

AI搜集汇总

数据集介绍

构建方式

在语音合成领域,VStyle数据集采用双语(中文与英文)并行构建策略,覆盖声学属性控制、自然语言指令跟随、角色扮演及隐式共情四大核心任务。其数据来源融合多模态语料,通过专业标注团队对语音样本进行精细化风格标注,并引入自动化流水线确保标注一致性与可复现性。

特点

VStyle的突出特点在于其多维评估体系LALM-as-a-Judge,从文本忠实度、风格契合度及自然度三个维度量化语音生成质量。该数据集兼具双语兼容性与任务多样性,支持对开源及商业语音模型的细粒度能力对比,其评估结果与人类标注呈现高相关性,显著提升了自动化评估的可靠性。

使用方法

用户可通过Hugging Face平台获取数据集,并利用集成的Gemini API评估工具进行自动化质量分析。运行示例命令即可生成多维度评分报告,亦可通过下载预计算结果进行人类-模型相关性验证。研究者还可提交自身模型的评估结果至指定邮箱,参与公开排行榜的迭代更新。

背景与挑战

背景概述

语音风格自适应作为语音合成领域的前沿研究方向,旨在实现语音输出在保持语义准确性的同时,具备多样化的情感表达和风格特征。VStyle数据集由阿里巴巴团队与复旦大学研究人员于2024年联合创建,专注于通过自然语言指令实现语音风格的精准控制。该数据集涵盖中英双语环境,包含声学属性控制、角色扮演、指令跟随和隐性共情四大核心任务,为构建具有高度表现力的语音生成系统提供了重要基准。其创新的LALM-as-a-Judge评估框架通过文本忠实度、风格遵循度和自然度三个维度,建立了自动化评估的新标准,显著推动了语音合成技术向更具表现力和人性化的方向发展。

当前挑战

在语音风格自适应领域,模型需要同时解决语义准确性与风格表现力之间的平衡难题,特别是在跨语言环境下保持风格一致性面临巨大挑战。VStyle数据集构建过程中,研究人员需要克服多模态数据对齐的复杂性,确保语音样本与文本指令的精确匹配。数据收集面临标注一致性问题,不同语言和文化背景下的风格表达存在显著差异,这要求标注体系具备跨文化适应性。评估环节的挑战在于建立可靠的自动化评估指标,传统方法难以准确捕捉语音输出的细微风格变化,而人工评估又存在成本高、可重复性差等局限,这促使研究者开发创新的LALM-as-a-Judge框架来应对这些挑战。

常用场景

经典使用场景

在语音合成研究领域,VStyle数据集为声音风格自适应任务提供了标准化评估框架。该数据集通过包含声学属性控制、自然语言指令跟随、角色扮演和隐性共情四大核心任务,构建了多维度评测体系。研究者可借助其双语平行语料和自动化评估工具,系统分析语音模型在保持内容忠实度与风格一致性方面的表现,为声音风格迁移技术的迭代优化提供实证基础。

解决学术问题

VStyle有效解决了语音合成领域长期存在的风格评估标准化难题。传统方法依赖主观人工评价,难以实现大规模可复现的评测。该数据集引入LALM-as-a-Judge框架,通过文本忠实度、风格遵循度和自然度三维度量化评估,为声音风格自适应研究提供了客观可靠的度量标准。其构建的跨语言评测体系显著提升了不同语音生成模型性能对比的科学性,推动了语音合成技术向更具表现力和可控性的方向发展。

衍生相关工作

该数据集催生了多项语音合成领域的创新研究,包括基于指令学习的风格控制方法、跨语言声音风格迁移技术以及自动化评估体系构建。相关研究团队借鉴其评测框架,开发了Step-Audio、Kimi-Audio等端到端语音语言模型。微软、谷歌等企业研究团队进一步扩展了其评估维度,开发出支持多模态输入的语音生成系统。这些衍生工作共同推动了语音合成技术从单纯的内容生成向精细化风格控制的范式转变。

以上内容由AI搜集并总结生成